Pontos importantes a reter: a Lei da IA estabelece os primeiros regulamentos do mundo que classificam a inteligência artificial de acordo com quatro níveis de risco, desde a proibição total até às obrigações mínimas. Este quadro jurídico harmonizado assegura a inovação e protege os direitos na Europa. Tal como o RGPD, aplica-se a qualquer entidade, europeia ou não, que opere no mercado da UE, com sanções dissuasivas a seguir.

A entrada em vigor da lei ia está a provocar-te arrepios quanto ao futuro dos teus projectos inovadores na Europa? Não te preocupes, não vemos este regulamento como um obstáculo intransponível, mas como

O Ato IA decifrado: as regras do jogo para a Europa

O que é exatamente a Lei IA?

A Lei da IA marca um ponto de viragem histórico: é a primeira legislação abrangente no mundo concebida para fornecer um quadro para a inteligência artificial. Este regulamento da União Europeia impõe regras rigorosas e claras tanto aos criadores como aos utilizadores.

Esquece a ideia de uma proibição maciça. Em vez disso, o texto visa garantir uma utilização segura e ética da tecnologia. Tudo depende de uma palavra-chave: confiança.

A ambição é clara: repetir o golpe de mestre do RGPD em 2018 e impor uma norma global.

Os principais objectivos da lei

A prioridade absoluta continua a ser a segurança dos nossos cidadãos. Temos de proteger os nossos direitos fundamentais e blindar a democracia contra os possíveis abusos destas tecnologias poderosas.

A Europa também quer criar um mercado único para aplicações “legais, seguras e fiáveis”. O objetivo? Criar um quadro jurídico estável e seguro para estimular o investimento e a inovação no velho continente.

O objetivo não é travar a IA, mas sim orientá-la. Trata-se de garantir que os seres humanos permanecem no lugar do condutor e que a tecnologia serve os nossos valores.

Quem é visado? O âmbito de aplicação do regulamento

O âmbito de aplicação da lei é amplo: diz respeito a qualquer entidade que coloque um sistema de IA no mercado da UE ou cuja utilização tenha impacto em pessoas localizadas na UE.

Cuidado com o alcance extraterritorial. Não importa se a tua empresa está sediada nos EUA ou na China. Se o teu produto de IA estiver a funcionar na Europa, tens de cumprir a Lei da IA. Este é um ponto importante que muitas pessoas subestimam.

Uma definição clara de um “sistema de IA

Oficialmente, é um sistema de máquinas que funciona com autonomia variável. Gera

Esta formulação é deliberadamente ampla para abranger as tecnologias actuais e futuras. Abrange os diferentes tipos de inteligência artificial que surgem todos os dias.

A abordagem baseada no risco: uma pirâmide de 4 níveis

O princípio: quanto maior o risco, mais rigorosas as regras

A Europa opta por uma abordagem pragmática e baseada no risco, recusando-se a regulamentar cegamente. O objetivo é simples: não impor as mesmas restrições a todos os algoritmos.

A lógica é óbvia: um filtro anti-spam não representa o mesmo dano potencial que um software de diagnóstico médico defeituoso. Por conseguinte, a regulamentação é estritamente proporcional ao perigo real para a saúde, a segurança ou os nossos direitos fundamentais.

As quatro categorias de risco em resumo

O texto distingue quatro níveis muito específicos: risco inaceitável, risco elevado, risco limitado e risco mínimo.

Este quadro recapitulativo funciona como uma bússola para te ajudar a manteres-te no bom caminho. Permite-te identificar imediatamente a categoria do teu IA e as obrigações daí resultantes, poupando-te muitas dores de cabeça legais dispendiosas.

| Nível de risco | Descrição | Exemplos concretos | Obrigação principal |

|---|---|---|---|

| Risco inaceitável | Ameaça direta aos direitos individuais e à segurança | Classificação social pelos governos, manipulação subliminar do comportamento, reconhecimento facial em tempo real (com excepções rigorosas). | Proibição total |

| Risco elevado | Impacto significativo na segurança ou nos direitos fundamentais | Recrutamento (triagem de CV), diagnóstico médico, concessão de crédito, sistemas judiciais e policiais. | Cumprimento rigoroso (avaliação, documentação, controlo humano) antes da comercialização. |

| Risco limitado | Risco de engano ou falta de transparência para o utilizador | Chatbots, sistemas que geram deepfakes, assistentes de voz. | Obrigação de transparência (os utilizadores devem saber que estão a interagir com uma IA). |

| Risco mínimo | Pouco ou nenhum risco para os direitos ou a segurança | Filtros de spam, jogos de vídeo, sistemas de recomendação simples. | Não tem obrigação legal (incentiva códigos de conduta voluntários). |

Porque é que esta classificação é a pedra angular do texto

Este método permite atacar com força onde é realmente necessário. Evita sufocar a inovação técnica em ferramentas inofensivas com uma burocracia cega e contraproducente.

A proporcionalidade continua a ser a chave para levar a indústria a aceitar a pílula. É o compromisso vital entre proteger ferozmente os cidadãos europeus e manter um crescimento económico dinâmico.

Para além dos riscos, um desejo de harmonização

Sem este texto, cada país teria elaborado as suas próprias leis no seu próprio canto. Para as empresas, fazer malabarismos com vinte e sete regulamentos contraditórios teria sido um verdadeiro pesadelo administrativo e financeiro.

A Lei AI impõe agora um conjunto único de regras para todos os Estados-Membros. Estar em conformidade em Paris significa estar em conformidade em Berlim, uma vantagem colossal para tornar o mercado interno mais fluido.

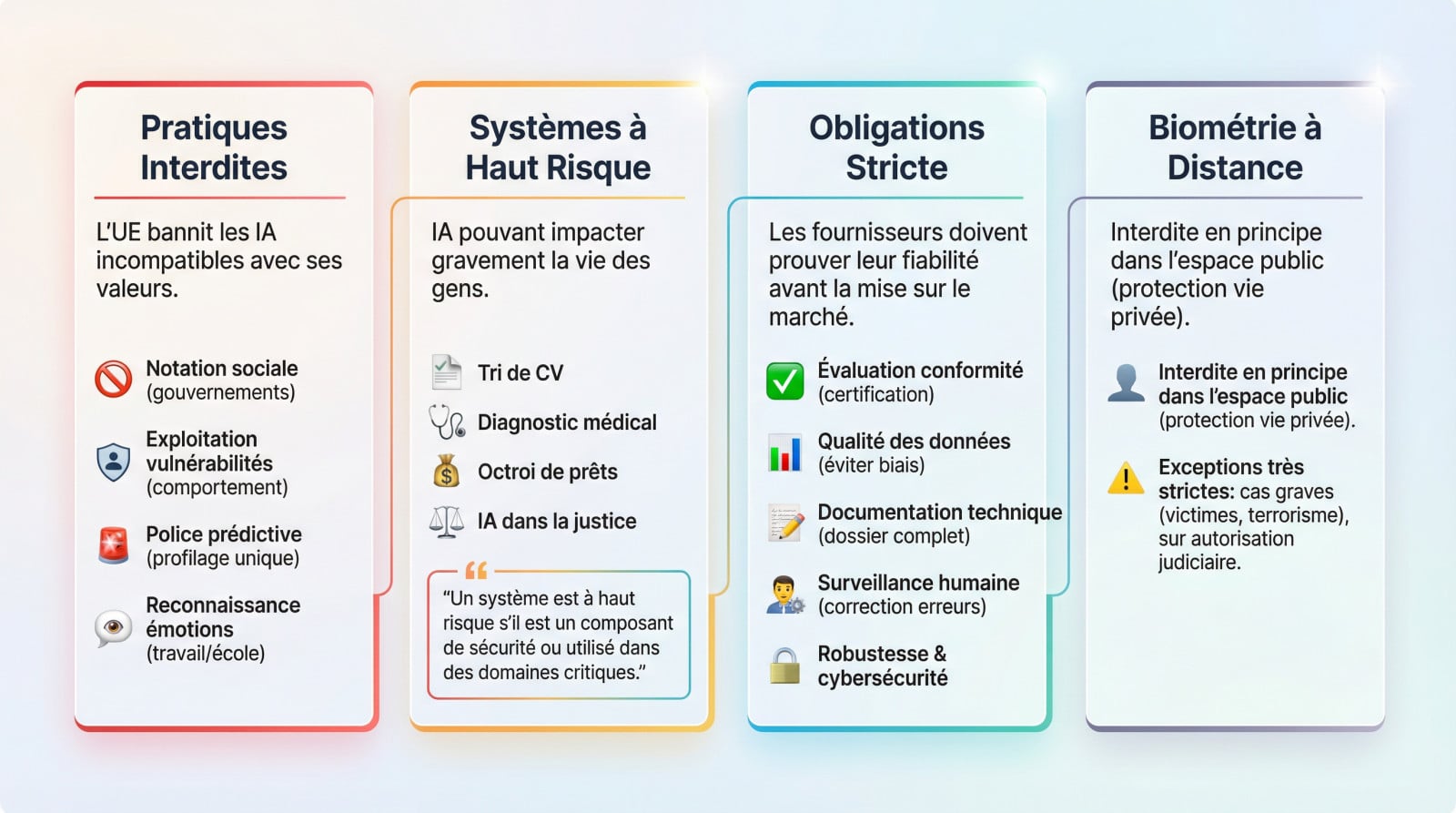

Linha vermelha: práticas proibidas e sistemas de alto risco

Depois de termos analisado a paisagem global, vamos fazer um zoom no topo da pirâmide legislativa. É aqui que se escondem as linhas vermelhas absolutas e as restrições que fazem tremer os departamentos jurídicos.

O que a Europa proíbe

A Lei da Aviação Civil não se esquiva a este ponto: certas aplicações violam os nossos valores fundamentais. Por conseguinte, são estritamente proibidas em solo europeu. Não há negociação possível.

Eis a lista negra que todos os programadores têm de saber de cor para evitar o muro:

- Sistemas de classificação social pelos governos, uma prática observada na China.

- IA que manipula as vulnerabilidades ligadas à idade ou à deficiência para modificar o comportamento.

- Sistemas de policiamento preditivo baseados unicamente no perfil de um indivíduo.

- Reconhecimento de emoções utilizado no local de trabalho ou nas escolas.

O que é um “sistema de alto risco”?

Os sistemas de alto risco são definidos pela sua capacidade de ter um impacto sério nas nossas vidas. Não é a tecnologia que coloca o problema, mas o seu domínio de aplicação preciso.

Pensa no software de triagem de CV, nas ferramentas de diagnóstico médico, nos algoritmos de empréstimos bancários ou na IA no sistema judicial. Os erros são proibidos.

Um sistema é de alto risco se for um componente de segurança de um produto ou se for utilizado em áreas críticas enumeradas por lei.

Obrigações pesadas para sistemas sensíveis

Os fornecedores não têm o direito de cometer erros e têm de provar a fiabilidade da sua ferramenta antes de esta ser colocada no mercado. Trata-se de uma enorme barreira à entrada no mercado.

Existe uma lista longa e técnica de tarefas a cumprir para obter a luz verde:

- Avaliação da conformidade: Certificação do sistema pelas autoridades competentes.

- Qualidade dos dados: Treina a IA em conjuntos de dados impecáveis para evitar qualquer enviesamento.

- Documentação técnica: Mantém um diário de bordo completo que explique o funcionamento interno do sistema.

- Supervisão humana: Garantir uma supervisão humana capaz de intervir e corrigir os desvios.

- Robustez e cibersegurança: garantir que o sistema é resistente a ataques e se mantém fiável.

Identificação biométrica: um caso exemplar

A Europa está a atacar em força: a identificação biométrica à distância e em tempo real em espaços públicos é proibida por defeito. Trata-se de uma grande vitória para a proteção da privacidade. Os teus rostos não são dados gratuitos. O Big Brother não vai desaparecer.

No entanto, a porta permanece entreaberta mediante excepções muito rigorosas, validadas por um juiz. Estas incluem a busca de vítimas ou ameaças terroristas iminentes. Por vezes, a segurança está em primeiro lugar.

IA generativa e GPAI: um quadro feito à medida

Tem-se falado muito de aplicações fixes, mas o verdadeiro assunto é o motor debaixo do capot. O AI Act não se esqueceu disso e dedica um capítulo inteiro às tecnologias maciças que alimentam as nossas ferramentas quotidianas.

Modelos de IA para fins gerais (GPAI) em destaque

Os GPAI (General-Purpose AI models) não são apenas software, são monstros de poder. Possuem uma versatilidade rara, capazes de realizar uma imensa variedade de tarefas sem terem sido programados para uma única função precisa.

Já os conheces – os cérebros por detrás do ChatGPT e do Midjourney. Tecnologias como o Google Gemini inserem-se perfeitamente nesta categoria. A Europa decidiu que estes modelos não podem continuar a funcionar em total liberdade.

Transparência, a nova regra de ouro

Acabaram-se as caixas negras impenetráveis. A principal obrigação que recai sobre os fornecedores de IAM é a transparência radical, sob a forma de uma exigência de documentação técnica concreta para provar a sua boa fé.

Em termos concretos, é isto que têm agora para pôr em cima da mesa:

- Fornecer documentação técnica precisa que especifique as capacidades e limitações reais do modelo.

- Apresenta um resumo dos conteúdos utilizados na formação, sem esconder nada.

- Implementa uma política rigorosa para cumprir a legislação europeia em matéria de direitos de autor.

- Marca claramente o conteúdo gerado (texto, imagens, vídeo) para indicar que é artificial.

Respeito pelos direitos de autor, um ponto não negociável

É aqui que as coisas se complicam. O AI Act exige que os criadores de GPAI provem que cumpriram a legislação sobre direitos de autor ao recolherem os seus dados de formação em grande escala.

Não se trata de uma mera formalidade administrativa. Têm de poder apresentar um resumo pormenorizado das fontes protegidas que ingeriram. Para os criadores e editores, trata-se de uma pequena revolução que volta a pôr as coisas em ordem.

O caso especial dos GPAI de “risco sistémico

Alguns modelos são demasiado grandes para serem ignorados. O termo “risco sistémico” é utilizado quando o poder computacional acumulado para formação excede um limiar crítico, ameaçando potencialmente a segurança pública ou os direitos fundamentais.

Para estes gigantes, a fasquia é mais elevada. Têm de efetuar avaliações aprofundadas dos modelos, gerir ativamente os riscos, comunicar qualquer incidente grave à Comissão e garantir um nível inatacável de cibersegurança.

Governação e calendário: quem dirige e para quando?

A legislação está muito bem no papel, mas quem é que a vai fazer cumprir e quando é que se vai pôr em prática? Chegou o momento de falarmos de pormenores: governação e calendário de implementação.

O “Gabinete da IA”: o novo cão de guarda da Europa

Podes ainda não ter ouvido falar dele, mas o Gabinete Europeu de IA está a tornar-se rapidamente uma força a ter em conta. Situado no coração da Comissão Europeia, esta nova estrutura funciona como um verdadeiro maestro regulamentar.

A sua missão está longe de ser simbólica. Este serviço controla diretamente a aplicação das regras relativas aos modelos de uso geral (GPAI), coordena as autoridades nacionais e contribui ativamente para o desenvolvimento de normas técnicas.

Fornecedores, responsáveis pela implementação: quem faz o quê?

Não confundas os papéis – pode ser um erro dispendioso. O fornecedor é o arquiteto: a entidade que desenvolve o sistema ou o coloca no mercado. Por conseguinte, é sobre os seus ombros que recai a maior parte das obrigações de conformidade.

Do outro lado está o implantador. Trata-se da empresa ou da autoridade pública que utiliza um sistema de IA, nomeadamente um sistema de alto risco, num contexto profissional. A sua responsabilidade? Garantir um controlo humano adequado e uma utilização em conformidade com as instruções.

Calendário de aplicação: implantação progressiva

Achas que tens tempo? Pensa de novo. Embora a lei não entre em vigor de repente, a sua aplicação segue um calendário preciso e faseado. O objetivo é dar aos jogadores uma janela de oportunidade para se adaptarem, mas essa janela está a fechar-se rapidamente.

Tem em mente estes prazos: as primeiras proibições entram em vigor em 2024 e no início de 2025. Depois, as regras estritas para os IPSM aplicar-se-ão em meados de 2025. Por último, a maior parte do trabalho, relativo aos sistemas de alto risco, entrará plenamente em vigor entre 2026 e 2027.

E quanto às sanções?

Bruxelas não está a jogar a sério. O regulamento dota as entidades reguladoras de sanções financeiras maciças para punir o incumprimento. Estamos a falar de montantes capazes de desestabilizar uma estrutura financeiramente sólida.

A lógica faz lembrar a do RGPD, mas é mais enérgica. As coimas podem atingir 7% do volume de negócios mundial ou 35 milhões de euros. Trata-se de uma medida dissuasora formidável que ninguém deve ignorar.

Lei IA e RGPD: a dupla vencedora para a conformidade

Por fim, vamos abordar uma questão que muitas empresas estão a colocar a si próprias: como é que este novo texto se enquadra no famoso RGPD? Spoiler: eles foram feitos para trabalharem juntos.

Não, a Lei IA não substitui o RGPD

É frequente ouvirmos esta confusão, mas vamos esclarecer desde já: a Lei da Informática e o RGPD (Regulamento Geral de Proteção de Dados) são dois diplomas legais complementares. Uma não exclui a outra, isso é um facto.

Na verdade, é muito simples: o RGPD protege os dados pessoais dos indivíduos, enquanto a Lei da IA regula a segurança e a fiabilidade dos produtos e serviços de IA.

Se um sistema de IA tratar dados pessoais, terá de cumprir os dois regulamentos. O cumprimento de um não o isenta do cumprimento do outro.

Como a Lei IA reforça os requisitos do RGPD

Estás a ver a ligação? O trabalho de documentação exigido pela Lei IA para sistemas de alto risco é uma ajuda valiosa para o cumprimento do RGPD. Não estamos a começar do zero.

Em termos práticos, a documentação sobre a qualidade dos dados e os testes de enviesamento pode ser diretamente integrada na Avaliação de Impacto sobre a Proteção de Dados (AIPD), que é obrigatória ao abrigo do RGPD.

Caixas de areia regulamentares” para uma inovação sem riscos

Aqui tens uma oportunidade a não perder. As “sandboxes” regulamentares são ambientes controlados criados pelas autoridades para a realização de testes sem o receio imediato de sanções. Esta é uma das boas ideias do texto.

O seu objetivo é claro: permitir que as empresas, especialmente as PME e as empresas em fase de arranque, testem a sua IA inovadora sob a supervisão das autoridades, para garantir a sua conformidade antes de um lançamento oficial.

Preparar a conformidade: um duplo papel obrigatório

Não cometas o erro de compartimentar as tuas equipas. As empresas precisam agora de pensar na sua estratégia de conformidade a partir de dois ângulos: proteção de dados (RGPD) e fiabilidade do sistema (Lei IA).

Para aplicações práticas, isto significa que o design do teu próximo chatbot de IA conversacional terá de incorporar estas duas dimensões desde o início.

A Lei da Informática marca um ponto de viragem decisivo: a Europa não procura travar a inovação, mas sim oferecer-lhe um quadro de confiança sólido. Para as empresas, a conformidade está a tornar-se uma verdadeira vantagem competitiva. Então, estás pronto para enfrentar o desafio? É melhor começares a planear agora, porque, dada a dimensão das multas, a fatura pode ser elevada.

FAQ

O que é exatamente a Lei da IA?

Simplificando, é a primeira lei global do mundo a regular a inteligência artificial. Liderado pela União Europeia, este regulamento não pretende proibir a tecnologia, mas sim estabelecer regras básicas claras. A ideia é classificar a IA de acordo com o seu grau de perigosidade: quanto maior for o risco para os cidadãos, maiores serão as restrições. É um pouco como o “código da estrada” para os algoritmos, para garantir a nossa segurança e os nossos direitos.

Quando é que esta lei entra efetivamente em vigor?

Não se trata de um “big bang” imediato, mas sim de uma aplicação gradual para dar a todos tempo para se adaptarem. As práticas totalmente proibidas (as linhas vermelhas) serão banidas a partir de 2024. As regras relativas à IA generativa (como os modelos subjacentes ao ChatGPT) entram em vigor em 2025. Por último, a maior parte das regras relativas aos sistemas de alto risco serão plenamente aplicáveis por volta de 2026 ou 2027.

Quais são os níveis de risco definidos pela lei IA?

A Europa optou por uma abordagem piramidal muito pragmática. Existem quatro níveis principais: risco inaceitável (sistemas proibidos, como a classificação social), risco elevado (estritamente regulamentado, por exemplo, no domínio da saúde ou da justiça), risco limitado (que exige apenas transparência, como no caso dos chatbots) e, por último, risco mínimo (sem restrições, como no caso dos filtros de spam ou dos jogos de vídeo).

Quem esteve por detrás da adoção da Lei AI?

Trata-se de uma iniciativa da União Europeia. O texto foi debatido e adotado pelas instituições europeias (Parlamento e Conselho) para que possa ser aplicado uniformemente nos 27 Estados-Membros. Um pequeno mas importante pormenor: graças ao seu âmbito de aplicação extraterritorial, não importa se a empresa é americana ou chinesa, é a UE que impõe as suas regras a partir do momento em que o sistema é utilizado em solo europeu.

O que é que se entende por “deployeur” no texto?

Tem cuidado com as nuances! O “implantador” não é a pessoa que codifica a IA (esse é o fornecedor), mas a entidade que a utiliza num contexto profissional. Se a tua empresa instala um software de IA para classificar currículos, é considerada um “implantador”. Como tal, tem responsabilidades específicas, como garantir que um humano vigia as decisões da máquina.

O que significa a palavra “Agir” neste contexto?

É simplesmente o termo jurídico inglês para uma “lei”. Em bom francês, fala-se de “Règlement sur l’Intelligence Artificielle”, mas a designação “AI Act” manteve-se na linguagem comum, mesmo aqui em França. É mais curto e soa um pouco mais moderno, é certo.

Quais são as sanções aplicáveis em caso de violação das regras?

A Europa leva a sério a questão do cumprimento. Como vimos com o RGPD, as sanções foram concebidas para serem dissuasivas. A Lei da IA prevê multas administrativas muito pesadas que podem representar uma percentagem significativa do volume de negócios global da empresa infratora. Por isso, é melhor levares as coisas a sério agora.