Belangrijke punten om te onthouden: de IA Act stelt ’s werelds eerste regelgeving vast die kunstmatige intelligentie classificeert volgens vier risiconiveaus, van een absoluut verbod tot minimale verplichtingen. Dit geharmoniseerde wettelijke kader

Geeft de inwerkingtreding van de ia-wet je koud zweet over de toekomst van je innovatieve projecten in Europa? Maak je geen zorgen, wij zien deze verordening niet als een onoverkomelijk obstakel, maar als de nieuwe instructies voor het bouwen van ethische en duurzame kunstmatige intelligentie. Hier ontdek je hoe je kunt jongleren met de verschillende risiconiveaus en de zware boetes kunt vermijden zonder je technische behendigheid op te offeren.

De IA Act ontcijferd: de spelregels voor Europa

Wat houdt de IA Act concreet in?

De AI-wet markeert een historisch keerpunt: het is de allereerste allesomvattende wetgeving ter wereld die is ontworpen om een kader te bieden voor kunstmatige intelligentie. Deze verordening van de Europese Unie legt zowel ontwikkelaars als gebruikers strenge en duidelijke regels op.

Vergeet het idee van een massaal verbod. In plaats daarvan wil de tekst een veilig en ethisch gebruik van technologie garanderen. Het draait allemaal om één sleutelwoord: vertrouwen.

De ambitie is duidelijk: de meesterzet van de RGPD in 2018 herhalen en een wereldwijde norm opleggen.

De belangrijkste doelstellingen achter de wet

De absolute prioriteit blijft de veiligheid van onze burgers. We moeten onze fundamentele rechten beschermen en de democratie wapenen tegen mogelijk misbruik van deze krachtige technologieën.

Europa wil ook een interne markt creëren voor “legale, veilige en betrouwbare” toepassingen. Het idee? Een stabiel, geruststellend wettelijk kader bieden om investeringen en innovatie op het oude continent te stimuleren.

Het doel is niet om AI af te remmen, maar om het te begeleiden. Het gaat erom dat de mens aan het stuur blijft en dat de technologie onze waarden dient.

Wie is het doelwit? De reikwijdte van de verordening

De wet heeft een breed toepassingsgebied: het betreft elke entiteit die een AI-systeem op de EU-markt brengt of waarvan het gebruik gevolgen heeft voor mensen die zich in de EU bevinden.

Pas op voor extraterritoriale reikwijdte. Het maakt niet uit of je bedrijf gevestigd is in de VS of China. Als je AI-product in Europa draait, moet je voldoen aan de IA Act. Dit is een belangrijk punt dat veel mensen onderschatten.

Een duidelijke definitie van een “AI-systeem

Officieel is het een machinesysteem dat met variabele autonomie werkt. Het genereert voorspellingen, inhoud of beslissingen die echte of virtuele omgevingen direct beïnvloeden. Een definitie op maat van de toekomst.

Deze formulering is opzettelijk breed om huidige en toekomstige technologieën te omvatten. Het omvat de verschillende soorten kunstmatige intelligentie die elke dag ontstaan.

De risicogebaseerde benadering: een piramide met 4 niveaus

Het principe: hoe groter het risico, hoe strenger de regels

Europa kiest voor een pragmatische, risicogebaseerde aanpak en weigert blindelings te reguleren. Het doel is eenvoudig: niet alle algoritmen dezelfde beperkingen opleggen.

De logica is duidelijk: een spamfilter veroorzaakt niet dezelfde potentiële schade als gebrekkige medische diagnosesoftware. Regelgeving is daarom strikt proportioneel aan het werkelijke gevaar voor gezondheid, veiligheid of onze fundamentele rechten.

De vier risicocategorieën in één oogopslag

De tekst onderscheidt vier zeer specifieke niveaus: onaanvaardbaar risico, hoog risico, beperkt risico en minimaal risico.

Deze overzichtstabel werkt als een kompas om je op het juiste spoor te houden. Het stelt je in staat om onmiddellijk de categorie van je AI en de daaruit voortvloeiende verplichtingen te identificeren, wat je een hoop dure juridische hoofdpijn bespaart.

| Risiconiveau | Beschrijving | Concrete voorbeelden | Belangrijkste verplichting |

|---|---|---|---|

| Onaanvaardbaar risico | Directe bedreiging voor individuele rechten en veiligheid | Sociale beoordeling door overheden, subliminale gedragsmanipulatie, realtime gezichtsherkenning (met strikte uitzonderingen). | Volledig verbod |

| Hoog risico | Significante impact op veiligheid of grondrechten | Werving (CV sorteren), medische diagnose, kredietverlening, justitie en politie. | Strikte naleving (beoordeling, documentatie, menselijke controle) voordat het product op de markt wordt gebracht. |

| Beperkt risico | Risico op misleiding of gebrek aan transparantie voor de gebruiker | Chatbots, systemen die deepfakes genereren, spraakassistenten. | Verplichting tot transparantie (gebruikers moeten weten dat ze interactie hebben met een AI). |

| Minimaal risico | Weinig of geen risico voor rechten of beveiliging | Spamfilters, videospelletjes, eenvoudige aanbevelingssystemen. | Geen wettelijke verplichting (vrijwillige gedragscodes worden aangemoedigd). |

Waarom deze classificatie de hoeksteen van de tekst is

Deze methode maakt het mogelijk om hard toe te slaan waar het echt nodig is. Het voorkomt dat technische innovatie op onschadelijke hulpmiddelen wordt gesmoord in blinde en contraproductieve bureaucratie.

Proportionaliteit blijft de sleutel om de industrie de pil te laten accepteren. Het is het cruciale compromis tussen het fel beschermen van Europese burgers en het behouden van dynamische economische groei.

Naast de risico’s, een verlangen naar harmonisatie

Zonder deze tekst zou elk land zijn eigen wetten in zijn eigen hoekje in elkaar hebben geflanst. Voor bedrijven zou het jongleren met zevenentwintig tegenstrijdige regels een ware administratieve en financiële nachtmerrie zijn geweest.

De IA Act legt nu één set regels op voor alle lidstaten. Compliant zijn in Parijs betekent compliant zijn in Berlijn, een enorm voordeel voor het soepeler laten verlopen van de interne markt.

Rode lijn: verboden praktijken en systemen met een hoog risico

Nu we het wereldwijde landschap hebben bekeken, zoomen we in op de top van de wetgevingspiramide. Dit is waar de absolute rode lijnen en beperkingen verborgen liggen die juridische afdelingen doen beven.

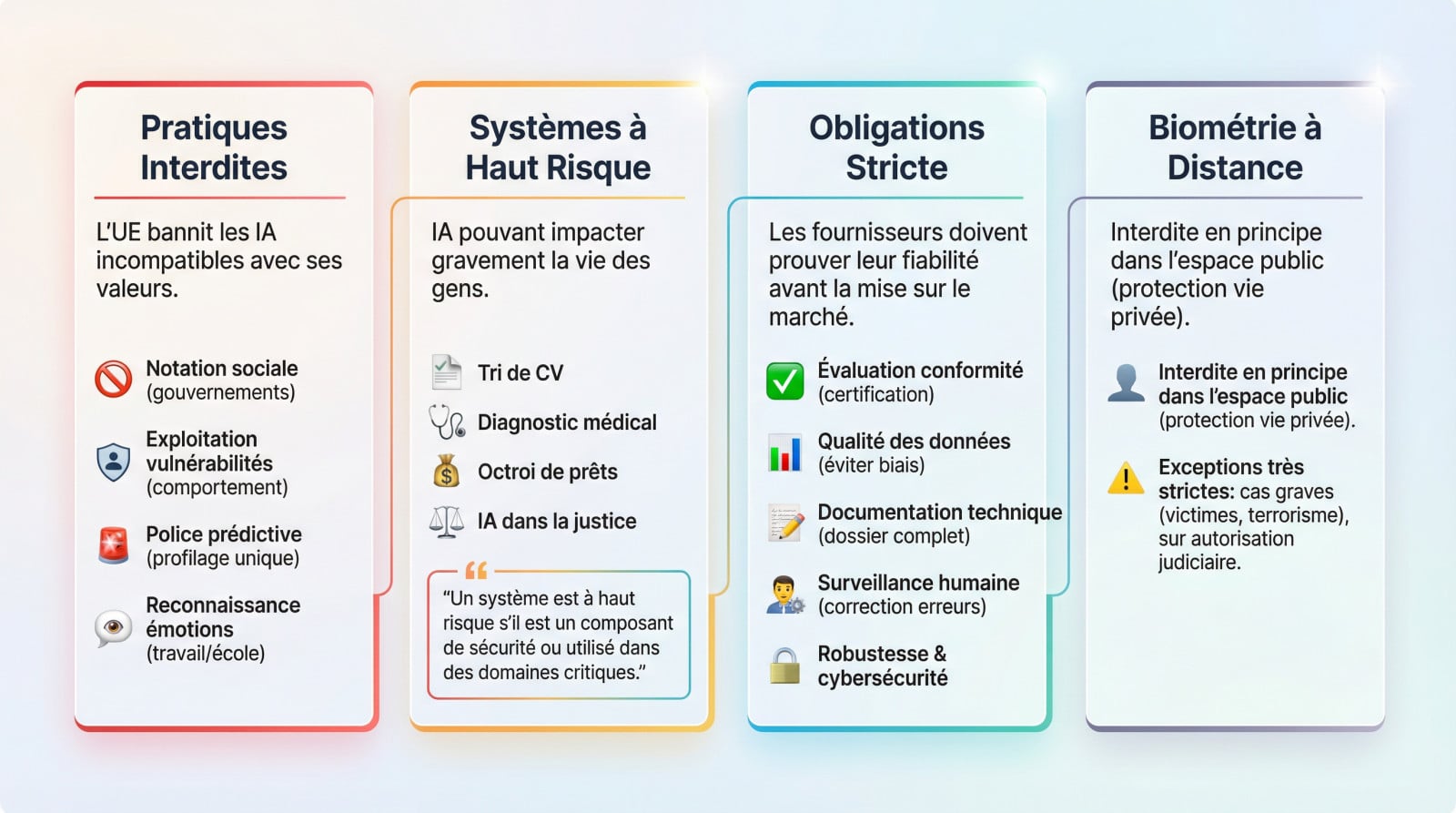

Wat Europa regelrecht verbiedt

De IA Act snijdt op dit punt geen hout: bepaalde toepassingen zijn in strijd met onze fundamentele waarden. Daarom zijn ze strikt verboden op Europese bodem. Geen onderhandeling mogelijk.

Hier is de zwarte lijst die elke ontwikkelaar uit zijn hoofd moet kennen om de muur te vermijden:

- Sociale puntensystemen door overheden, een praktijk die in China wordt toegepast.

- AI die kwetsbaarheden in verband met leeftijd of handicap manipuleert om gedrag aan te passen.

- Voorspellende politiesystemen die alleen gebaseerd zijn op de profilering van een individu.

- Emotieherkenning gebruikt op het werk of in scholen.

Wat is een “risicovol systeem”?

Systemen met een hoog risico worden gedefinieerd door hun vermogen om ons leven ernstig te beïnvloeden. Het is niet de technologie die het probleem vormt, maar het precieze toepassingsgebied.

Denk aan software voor het sorteren van cv’s, medische diagnosetools, algoritmen voor bankleningen of AI in het rechtssysteem. Fouten zijn verboden.

Een systeem is een hoog risico als het een veiligheidscomponent van een product is of als het wordt gebruikt in kritieke gebieden die wettelijk zijn vastgelegd.

Zware verplichtingen voor gevoelige systemen

Leveranciers hebben het recht niet om fouten te maken en moeten de betrouwbaarheid van hun gereedschap bewijzen voordat het op de markt wordt gebracht. Het is een enorme drempel.

Er is een lange en technische lijst van taken die moeten worden uitgevoerd om groen licht te krijgen:

- Conformiteitsbeoordeling: het systeem laten certificeren door de bevoegde instanties.

- Datakwaliteit: Train de AI op onberispelijke datasets om vertekening te voorkomen.

- Technische documentatie: Houd een uitgebreid logboek bij waarin de interne werking van het systeem wordt uitgelegd.

- Menselijk toezicht: Garandeer menselijk toezicht dat kan ingrijpen en afwijkingen kan corrigeren.

- Robuustheid en cyberveiligheid: Ervoor zorgen dat het systeem bestand is tegen aanvallen en betrouwbaar blijft.

Biometrische identificatie: een schoolvoorbeeld

Europa slaat hard toe: biometrische identificatie op afstand in realtime in openbare ruimtes wordt standaard verboden. Dit is een belangrijke overwinning voor de bescherming van privacy. Je gezichten zijn geen gratis gegevens. Big Brother zal niet verdwijnen.

De deur blijft echter op een kier staan door middel van zeer strikte uitzonderingen, bekrachtigd door een rechter. Dit zijn bijvoorbeeld huiszoekingen naar slachtoffers of dreigende terroristische dreigingen. Veiligheid komt soms op de eerste plaats.

Generatieve AI en GPAI: een raamwerk op maat

Er is veel gesproken over coole apps, maar het echte onderwerp is de motor onder de motorkap. De AI Act is dit niet vergeten en wijdt een heel hoofdstuk aan de enorme technologieën die onze alledaagse tools aandrijven.

AI-modellen voor algemene doeleinden (GPAI) in de schijnwerpers

GPAI’s (General-Purpose AI-modellen) zijn niet zomaar software, het zijn monsters van kracht. Ze hebben een zeldzame veelzijdigheid, ze kunnen een immense variëteit aan taken uitvoeren zonder te zijn geprogrammeerd voor een enkele precieze functie.

Je kent ze al – het brein achter ChatGPT en Midjourney. Technologieën zoals Google Gemini vallen precies in deze categorie. Europa heeft besloten dat deze modellen niet langer in volledige vrijheid mogen opereren.

Transparantie, de nieuwe gouden regel

Geen ondoordringbare zwarte dozen meer. De belangrijkste verplichting voor IAM-aanbieders is radicale transparantie, in de vorm van een vereiste voor concrete technische documentatie om hun goede trouw te bewijzen.

Concreet is dit wat ze nu op tafel moeten leggen:

- Zorg voor nauwkeurige technische documentatie over de werkelijke mogelijkheden en beperkingen van het model.

- Geef een samenvatting van de inhoud die voor de training wordt gebruikt, zonder iets te verbergen.

- Implementeer een strikt beleid om te voldoen aan de Europese auteursrechtwetgeving.

- Geef duidelijk aan dat gegenereerde inhoud (tekst, afbeeldingen, video) kunstmatig is.

Respect voor auteursrecht, een punt waarover niet onderhandeld kan worden

Dit is vaak waar het lastig wordt. De AI-wet eist van GPAI-ontwikkelaars dat ze bewijzen dat ze zich aan de auteursrechtwetgeving hebben gehouden bij het op grote schaal verzamelen van hun trainingsgegevens.

Dit is niet slechts een administratieve formaliteit. Ze moeten een gedetailleerd overzicht kunnen laten zien van de beschermde bronnen die ze hebben opgenomen. Voor makers en uitgevers is dit een kleine revolutie die weer orde op zaken stelt.

Het speciale geval van GPAI’s voor “systeemrisico’s

Sommige modellen zijn te groot om te negeren. De term “systeemrisico” wordt gebruikt wanneer de cumulatieve rekenkracht voor training een kritieke drempel overschrijdt, waardoor de openbare veiligheid of fundamentele rechten in gevaar kunnen komen.

Voor deze giganten ligt de lat hoger. Ze moeten diepgaande modelbeoordelingen uitvoeren, risico’s actief beheren, elk ernstig incident aan de Commissie melden en een onaantastbaar niveau van cyberbeveiliging garanderen.

Bestuur en tijdschema: wie stuurt en voor wanneer?

Wetgeving is allemaal goed en wel op papier, maar wie gaat die daadwerkelijk handhaven en wanneer komt het rubber van de weg? Nu is het tijd om over specifieke zaken te praten: bestuur en het tijdschema voor de uitrol.

Het “AI-bureau”: de nieuwe waakhond van Europa

Misschien heb je er nog niet van gehoord, maar het Europees AI-bureau is hard op weg om een kracht te worden om rekening mee te houden. Deze nieuwe structuur bevindt zich in het hart van de Europese Commissie en fungeert als een echte dirigent op het gebied van regelgeving.

Haar missie is verre van symbolisch. Dit bureau houdt direct toezicht op de toepassing van de regels voor algemene modellen (GPAI), coördineert de nationale autoriteiten en draagt actief bij aan de ontwikkeling van technische normen.

Leveranciers, ontplooiers: wie doet wat?

Verwar de rollen niet – dat kan een kostbare vergissing zijn. De leverancier is de architect: de entiteit die het systeem ontwikkelt of op de markt brengt. Daarom rust het merendeel van de nalevingsverplichtingen op zijn schouders.

Aan de andere kant staat de gebruiker. Dit is het bedrijf of de overheid die een AI-systeem, vooral een systeem met een hoog risico, gebruikt in een professionele context. Hun verantwoordelijkheid? Het garanderen van voldoende menselijk toezicht en gebruik in overeenstemming met de instructies.

Tijdschema voor implementatie: geleidelijke invoering

Denk je dat je tijd hebt? Denk nog maar eens na. Hoewel de wet niet plotseling van kracht wordt, volgt de invoering ervan een nauwkeurig, gefaseerd tijdschema. Het doel is om spelers de kans te geven zich aan te passen, maar die kans gaat snel voorbij.

Houd deze deadlines in gedachten: de eerste verboden worden van kracht in 2024 en begin 2025. Vervolgens worden de strenge regels voor IPSM’s medio 2025 van kracht. Tot slot zal het grootste deel van het werk, met betrekking tot systemen met een hoog risico, volledig van kracht zijn tussen 2026 en 2027.

Hoe zit het met straffen?

Brussel speelt niet op zeker. De verordening wapent toezichthouders met enorme financiële boetes om niet-naleving te bestraffen. We hebben het hier over bedragen die een financieel solide structuur kunnen destabiliseren.

De logica doet denken aan die van de RGPD, maar is krachtiger. Boetes kunnen oplopen tot 7% van de wereldwijde omzet of €35 miljoen. Dit is een formidabel afschrikmiddel dat niemand mag negeren.

IA Act en RGPD: het winnende duo voor naleving

Laten we tot slot ingaan op een vraag die veel bedrijven zich stellen: hoe past deze nieuwe tekst in de beroemde RGPD? Spoiler: ze zijn bedoeld om samen te werken.

Nee, de wet IA vervangt de RGPD niet.

We horen deze verwarring vaak, maar laten we het meteen rechtzetten: de Wet IA en de RGPD (Algemene Verordening Gegevensbescherming) zijn twee complementaire stukken wetgeving. De ene verdringt de andere niet, dat is een feit.

Het is eigenlijk heel eenvoudig: de GDPR beschermt de persoonlijke gegevens van individuen, terwijl de AI-wet de veiligheid en betrouwbaarheid van AI-producten en -diensten regelt.

Als een AI-systeem persoonsgegevens verwerkt, moet het aan beide verordeningen voldoen. Naleving van de ene stelt het niet vrij van naleving van de andere.

Hoe de Wet IA de vereisten van de RGPD versterkt

Zie je de link? Het documentatiewerk dat de IA Act vereist voor systemen met een hoog risico is een waardevol hulpmiddel voor naleving van de RGPD. We beginnen niet bij nul.

Praktisch gezien kan de documentatie over gegevenskwaliteit en bias-tests direct worden gebruikt voor de Data Protection Impact Assessment (DPIA), die verplicht is onder de RGPD.

Regelgevende zandbakken” voor risicoloze innovatie

Dit is een kans die je niet mag missen.

Het doel is duidelijk: bedrijven, vooral KMO’s en start-ups, in staat stellen om hun innovatieve AI te testen onder toezicht van de autoriteiten, om ervoor te zorgen dat ze voldoen aan de voorschriften voordat ze officieel worden gelanceerd.

Voorbereiding op naleving: een verplichte tweeledige rol

Maak niet de fout om je teams in hokjes in te delen. Bedrijven moeten nu vanuit twee invalshoeken nadenken over hun compliance-strategie: gegevensbescherming (RGPD) en betrouwbaarheid van systemen (IA Act).

Voor praktische toepassingen betekent dit dat het ontwerp van je volgende conversationele AI-chatbot deze twee dimensies vanaf het begin moet omvatten.

De IA Act markeert een beslissend keerpunt: Europa wil innovatie niet afremmen, maar een solide vertrouwenskader bieden. Voor bedrijven wordt compliance een echt concurrentievoordeel. Dus, bent u klaar om de uitdaging aan te gaan? Begin maar vast met vooruitdenken, want gezien de hoogte van de boetes kan de rekening hoog oplopen.

FAQ

Wat is de AI-wet precies?

Simpel gezegd is het ’s werelds eerste allesomvattende wet om kunstmatige intelligentie te reguleren. Onder leiding van de Europese Unie is deze verordening niet bedoeld om de technologie te verbieden, maar om duidelijke basisregels op te stellen. Het idee is om AI te classificeren naar hoe gevaarlijk het is: hoe groter het risico voor burgers, hoe groter de beperkingen. Het is een beetje zoals de ‘verkeersregels’ voor algoritmen om onze veiligheid en rechten te garanderen.

Wanneer treedt deze wet in werking?

Dit is geen onmiddellijke ‘big bang’, maar eerder een geleidelijke implementatie om iedereen de tijd te geven om zich aan te passen. Volledig verboden praktijken (de rode regels) worden vanaf 2024 verboden. De regels met betrekking tot generatieve AI (zoals de modellen achter ChatGPT) komen in 2025. Tot slot zal het grootste deel van de regels met betrekking tot risicovolle systemen rond 2026 of 2027 volledig van toepassing zijn.

Wat zijn de risiconiveaus zoals gedefinieerd door de IA Act?

Europa heeft gekozen voor een zeer pragmatische piramidebenadering. Er zijn vier hoofdniveaus: onaanvaardbaar risico (verboden systemen, zoals social rating), hoog risico (strikt gereguleerd, bijvoorbeeld voor gezondheid of justitie), beperkt risico (waarvoor alleen transparantie nodig is, zoals voor chatbots) en tot slot minimaal risico (geen beperkingen, voor spamfilters of videospelletjes).

Wie zat er achter de goedkeuring van de IA Act?

Dit is een initiatief van de Europese Unie. De tekst werd besproken en aangenomen door de Europese instellingen (Parlement en Raad) zodat hij uniform kan worden toegepast in alle 27 lidstaten. Een klein maar belangrijk detail: dankzij het extraterritoriale toepassingsgebied maakt het niet uit of het bedrijf Amerikaans of Chinees is, het is de EU die haar regels oplegt zodra het systeem op Europese bodem wordt gebruikt.

Wat wordt bedoeld met “deployeur” in de tekst?

Wees voorzichtig met de nuance! De “gebruiker” is niet de persoon die de AI codeert (dat is de leverancier), maar de entiteit die het gebruikt in een professionele context. Als je bedrijf AI-software installeert om cv’s te sorteren, wordt het beschouwd als een “gebruiker”. Als zodanig heeft het specifieke verantwoordelijkheden, zoals ervoor zorgen dat een mens de beslissingen van de machine in de gaten houdt.

Wat betekent het woord “Act” in deze context?

Het is gewoon de Engelse juridische term voor een ‘wet’. In goed Frans spreken we van “Règlement sur l’Intelligence Artificielle”, maar de naam “AI-wet” is in het spraakgebruik blijven hangen, zelfs hier in Frankrijk. Het is korter en klinkt wat moderner, toegegeven.

Wat zijn de straffen voor het overtreden van de regels?

Europa neemt naleving serieus. Zoals we bij de RGPD hebben gezien, zijn de sancties zo ontworpen dat ze afschrikkend werken. De AI Act voorziet in zeer zware administratieve boetes die kunnen oplopen tot een aanzienlijk percentage van de wereldwijde omzet van het bedrijf in overtreding. Het is dus het beste om nu serieus aan de slag te gaan.