Puntos clave que debes recordar: la Ley de AI establece la primera normativa del mundo que clasifica la inteligencia artificial según cuatro niveles de riesgo, desde la prohibición absoluta hasta las obligaciones mínimas. Este marco jurídico armonizado garantiza la innovación y protege los derechos en Europa. Al igual que el RGPD, se aplica a cualquier entidad, europea o no, que opere en el mercado de la UE, con sanciones disuasorias posteriores.

¿La entrada en vigor de la ley ia te hace sudar frío sobre el futuro de tus proyectos innovadores en Europa? No te preocupes, no vemos esta normativa como un obstáculo insalvable, sino como las nuevas instrucciones para construir una inteligencia artificial ética y sostenible. Aquí descubrirás cómo hacer malabarismos con los distintos niveles de riesgo y evitar las fuertes sanciones sin sacrificar tu agilidad técnica.

La Ley IA descifrada: las reglas del juego para Europa

¿Qué es exactamente la Ley IA?

La Ley de IA marca un punto de inflexión histórico: es la primera legislación global del mundo diseñada para proporcionar un marco a la inteligencia artificial. Esta normativa de la Unión Europea impone normas estrictas y claras tanto a los desarrolladores como a los usuarios.

Olvida la idea de una prohibición masiva. En su lugar, el texto pretende garantizar el uso seguro y ético de la tecnología. Todo depende de una palabra clave: confianza.

La ambición es clara: repetir el golpe maestro del RGPD en 2018 e imponer una norma mundial.

Los principales objetivos de la ley

La prioridad absoluta sigue siendo la seguridad de nuestros ciudadanos. Tenemos que proteger nuestros derechos fundamentales y blindar la democracia contra los posibles abusos de estas poderosas tecnologías.

Europa también quiere construir un mercado único de aplicaciones «legales, seguras y fiables». ¿La idea? Proporcionar un marco jurídico estable y tranquilizador para estimular la inversión y la innovación en el viejo continente.

No se trata de poner freno a la IA, sino de guiarla. Se trata de garantizar que los seres humanos sigan al volante y que la tecnología esté al servicio de nuestros valores.

¿A quién va dirigido? Ámbito de aplicación de la normativa

El ámbito de aplicación de la ley es amplio: afecta a cualquier entidad que comercialice un sistema de IA en la UE o cuyo uso afecte a personas situadas en la UE.

Cuidado con el alcance extraterritorial. No importa si tu empresa tiene su sede en EE.UU. o en China. Si tu producto de IA funciona en Europa, tienes que cumplir la Ley de IA. Este es un punto importante que mucha gente subestima.

Una definición clara de «sistema de IA

Oficialmente, es un sistema de máquinas que funciona con autonomía variable. Genera predicciones, contenidos o decisiones que influyen directamente en entornos reales o virtuales. Una definición hecha a medida para el futuro.

Esta redacción es deliberadamente amplia para abarcar las tecnologías actuales y futuras. Abarca los distintos tipos de inteligencia artificial que surgen cada día.

El enfoque basado en el riesgo: una pirámide de 4 niveles

El principio: cuanto mayor es el riesgo, más estrictas son las normas

Europa opta por un enfoque pragmático, basado en el riesgo, negándose a regular a ciegas. El objetivo es sencillo: no imponer las mismas restricciones a todos los algoritmos.

La lógica es obvia: un filtro antispam no supone el mismo daño potencial que un software de diagnóstico médico defectuoso. Por tanto, la regulación es estrictamente proporcional al peligro real para la salud, la seguridad o nuestros derechos fundamentales.

Las cuatro categorías de riesgo de un vistazo

El texto distingue cuatro niveles muy concretos: riesgo inaceptable, riesgo elevado, riesgo limitado y riesgo mínimo.

Esta tabla resumen actúa como una brújula para ayudarte a mantener el rumbo. Te permite identificar inmediatamente la categoría de tu IA y las obligaciones resultantes, ahorrándote muchos y costosos quebraderos de cabeza legales.

| Nivel de riesgo | Descripción | Ejemplos concretos | Obligación principal |

|---|---|---|---|

| Riesgo inaceptable | Amenaza directa a los derechos individuales y a la seguridad | Calificación social por los gobiernos, manipulación subliminal del comportamiento, reconocimiento facial en tiempo real (con estrictas excepciones). | Prohibición total |

| Riesgo elevado | Impacto significativo en la seguridad o los derechos fundamentales | Contratación (selección de CV), diagnóstico médico, concesión de créditos, sistemas judicial y policial. | Cumplimiento estricto (evaluación, documentación, control humano) antes de la comercialización. |

| Riesgo limitado | Riesgo de engaño o falta de transparencia para el usuario | Chatbots, sistemas que generan deepfakes, asistentes de voz. | Obligación de transparencia (los usuarios deben saber que están interactuando con una IA). |

| Riesgo mínimo | Poco o ningún riesgo para los derechos o la seguridad | Filtros de spam, videojuegos, sistemas de recomendación sencillos. | Sin obligación legal (se fomentan los códigos de conducta voluntarios). |

Por qué esta clasificación es la piedra angular del texto

Este método permite golpear fuerte donde realmente se necesita. Evita ahogar la innovación técnica en herramientas inofensivas con una burocracia ciega y contraproducente.

La proporcionalidad sigue siendo la clave para conseguir que la industria acepte la píldora. Es el compromiso vital entre proteger ferozmente a los ciudadanos europeos y mantener un crecimiento económico dinámico.

Más allá de los riesgos, un deseo de armonización

Sin este texto, cada país habría improvisado sus propias leyes en su propio rincón. Para las empresas, hacer malabarismos con veintisiete normativas contradictorias habría sido una auténtica pesadilla administrativa y financiera.

La Ley IA impone ahora un único conjunto de normas para todos los Estados miembros. Ser conforme en París significa ser conforme en Berlín, una ventaja colosal para hacer más fluido el mercado interior.

Línea roja: prácticas prohibidas y sistemas de alto riesgo

Una vez examinado el panorama global, acerquémonos a la cúspide de la pirámide legislativa. Aquí es donde se ocultan las líneas rojas absolutas y las limitaciones que hacen temblar a los departamentos jurídicos.

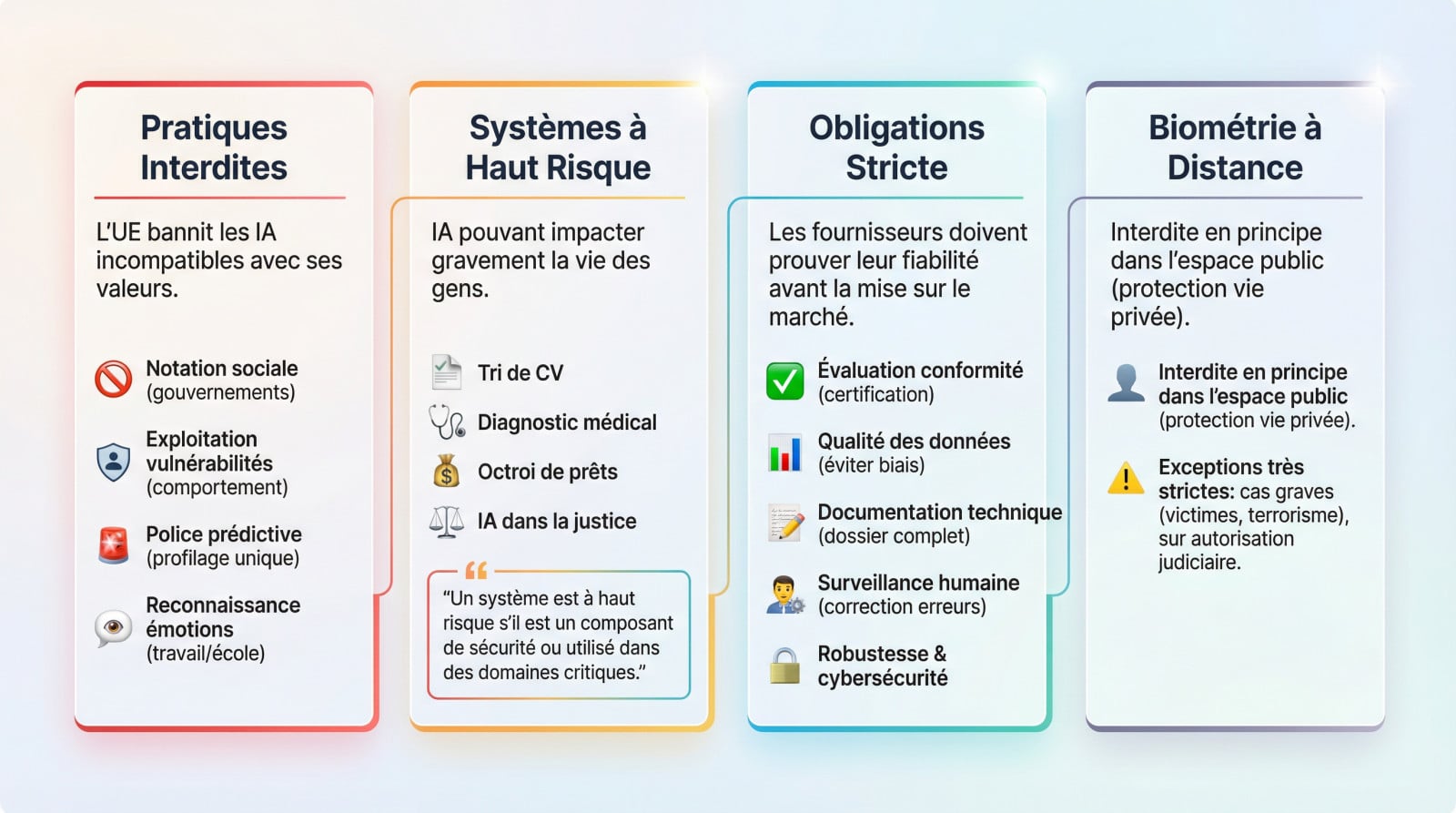

Lo que Europa prohíbe rotundamente

La Ley de AI no escatima en este punto: determinadas aplicaciones violan nuestros valores fundamentales. Por tanto, están estrictamente prohibidas en suelo europeo. No hay negociación posible.

He aquí la lista negra que todo desarrollador debe conocer de memoria para evitar el muro:

- Sistemas de puntuación social por parte de los gobiernos, una práctica observada en China.

- IA que manipula las vulnerabilidades ligadas a la edad o a la discapacidad para modificar el comportamiento.

- Sistemas policiales predictivos basados únicamente en el perfil de un individuo.

- Reconocimiento de emociones utilizado en el lugar de trabajo o en las escuelas.

¿Qué es un «sistema de alto riesgo»?

Los sistemas de alto riesgo se definen por su capacidad de repercutir gravemente en nuestras vidas. No es la tecnología lo que plantea el problema, sino su ámbito preciso de aplicación.

Piensa en el software de clasificación de CV, las herramientas de diagnóstico médico, los algoritmos de préstamos bancarios o la IA en el sistema judicial. Los errores están prohibidos.

Un sistema es de alto riesgo si es un componente de seguridad de un producto o si se utiliza en zonas críticas enumeradas por la ley.

Grandes obligaciones para los sistemas sensibles

Los proveedores no tienen derecho a cometer errores y deben demostrar la fiabilidad de su herramienta antes de sacarla al mercado. Es una barrera de entrada enorme.

Hay una larga y técnica lista de tareas que completar antes de que puedas esperar que te den luz verde:

- Evaluación de la conformidad: Hacer que las autoridades competentes certifiquen el sistema.

- Calidad de los datos: Entrena la IA con conjuntos de datos impecables para evitar cualquier sesgo.

- Documentación técnica: Lleva un cuaderno de bitácora completo que explique el funcionamiento interno del sistema.

- Supervisión humana: Garantizar una supervisión humana capaz de intervenir y corregir las desviaciones.

- Robustez y ciberseguridad: Garantizar que el sistema es resistente a los ataques y sigue siendo fiable.

Identificación biométrica: un caso de manual

Europa está dando un duro golpe: la identificación biométrica a distancia y en tiempo real en espacios públicos está prohibida por defecto. Se trata de una gran victoria para la protección de la privacidad. Tus rostros no son datos gratuitos. El Gran Hermano no desaparecerá.

Sin embargo, la puerta permanece entreabierta mediante excepciones muy estrictas, validadas por un juez. Entre ellas se incluyen las búsquedas de víctimas o amenazas terroristas inminentes. A veces, la seguridad es lo primero.

IA Generativa y GPAI: un marco a medida

Se ha hablado mucho de aplicaciones geniales, pero el verdadero tema es el motor que hay bajo el capó. La Ley de la IA no lo ha olvidado, y dedica un capítulo entero a las tecnologías masivas que impulsan nuestras herramientas cotidianas.

Los modelos de IA de propósito general (GPAI) en el punto de mira

Los GPAI (modelos de IA de propósito general) no son sólo software, son monstruos de poder. Tienen una versatilidad poco común, capaces de realizar una inmensa variedad de tareas sin haber sido programados para una única función precisa.

Ya los conoces: son los cerebros de ChatGPT y Midjourney. Tecnologías como Google Gemini entran de lleno en esta categoría. Europa ha decidido que estos modelos no pueden seguir funcionando con total libertad.

La transparencia, la nueva regla de oro

Se acabaron las cajas negras impenetrables. La principal obligación que recae sobre los proveedores de IAM es la transparencia radical, en forma de exigencia de documentación técnica concreta que demuestre su buena fe.

En concreto, esto es lo que ahora tienen que poner sobre la mesa:

- Proporcionar una documentación técnica precisa en la que se detallen las capacidades y limitaciones reales del modelo.

- Proporciona un resumen del contenido utilizado para la formación, sin ocultar nada.

- Aplica una política estricta para cumplir la legislación europea sobre derechos de autor.

- Marca claramente el contenido generado (texto, imágenes, vídeo) para indicar que es artificial.

El respeto de los derechos de autor, un punto innegociable

Aquí es donde a menudo la cosa se complica. La Ley de IA exige a los desarrolladores de GPAI que demuestren que han cumplido la legislación sobre derechos de autor al recopilar sus datos de entrenamiento a gran escala.

No se trata de una mera formalidad administrativa. Deben poder mostrar un resumen detallado de las fuentes protegidas que han ingerido. Para los creadores y editores, se trata de una pequeña revolución que pone las cosas en orden.

El caso especial de los PAMI de «riesgo sistémico

Algunos modelos son demasiado grandes para ignorarlos. El término «riesgo sistémico» se utiliza cuando la potencia de cálculo acumulada para la formación supera un umbral crítico, amenazando potencialmente la seguridad pública o los derechos fundamentales.

Para estos gigantes, el listón está más alto. Deben realizar evaluaciones en profundidad de los modelos, gestionar activamente los riesgos, informar a la Comisión de cualquier incidente grave y garantizar un nivel de ciberseguridad intachable.

Gobernanza y calendario: ¿quién dirige y para cuándo?

La legislación está muy bien sobre el papel, pero ¿quién va a hacerla cumplir realmente y cuándo se pondrá en marcha? Ahora es el momento de hablar de los detalles: la gobernanza y el calendario de implantación.

La «Oficina de la IA»: el nuevo organismo de vigilancia de Europa

Puede que aún no hayas oído hablar de ella, pero la Oficina Europea de la IA se está convirtiendo rápidamente en una fuerza a tener en cuenta. Situada en el corazón de la Comisión Europea, esta nueva estructura actúa como un auténtico director de orquesta regulador.

Su misión está lejos de ser simbólica. Esta oficina supervisa directamente la aplicación de las normas para los modelos de uso general (GPAI), coordina a las autoridades nacionales y contribuye activamente a la elaboración de normas técnicas.

Proveedores, implantadores: ¿quién hace qué?

No confundas los papeles: podría ser un error costoso. El proveedor es el arquitecto: la entidad que desarrolla el sistema o lo lleva al mercado. Por tanto, sobre sus hombros recae la mayor parte de las obligaciones de cumplimiento.

En el otro lado está el desplegador. Es la empresa o autoridad pública que utiliza un sistema de IA, sobre todo de alto riesgo, en un contexto profesional. ¿Su responsabilidad? Garantizar una supervisión humana adecuada y una utilización conforme a las instrucciones.

Calendario de aplicación: un despliegue gradual

¿Crees que tienes tiempo? Piénsalo otra vez. Aunque la ley no entra en vigor de repente, su despliegue sigue un calendario preciso y escalonado. El objetivo es dar a los jugadores una ventana de oportunidad para adaptarse, pero esa ventana se está cerrando rápidamente.

Ten en cuenta estos plazos: las primeras prohibiciones entrarán en vigor en 2024 y principios de 2025. Después, las normas estrictas para los IPSM se aplicarán a mediados de 2025. Por último, el grueso del trabajo, relativo a los sistemas de alto riesgo, será plenamente efectivo entre 2026 y 2027.

¿Y las sanciones?

Bruselas no se la juega. El reglamento dota a los reguladores de enormes sanciones económicas para castigar el incumplimiento. Estamos hablando de cantidades capaces de desestabilizar una estructura financieramente sólida.

La lógica recuerda a la del RGPD, pero es más contundente. Las multas pueden alcanzar el 7% de la facturación mundial o 35 millones de euros. Se trata de un elemento disuasorio formidable que nadie debería ignorar.

Ley IA y RGPD: el dúo ganador para el cumplimiento

Por último, abordemos una pregunta que se hacen muchas empresas: ¿cómo encaja este nuevo texto con el famoso RGPD? Spoiler: están hechos para trabajar juntos.

No, la Ley IA no sustituye al RGPD

A menudo oímos esta confusión, pero dejemos las cosas claras desde el principio: la Ley de AI y el RGPD (Reglamento General de Protección de Datos) son dos actos legislativos complementarios. Una no excluye a la otra, eso es un hecho.

En realidad es bastante sencillo: el GDPR protege los datos personales de los individuos, mientras que la Ley de IA regula la seguridad y fiabilidad de los productos y servicios de IA.

Si un sistema de IA procesa datos personales, tendrá que cumplir ambas normativas. El cumplimiento de una no exime del cumplimiento de la otra.

Cómo refuerza la Ley IA los requisitos del RGPD

¿Ves el enlace? El trabajo de documentación exigido por la Ley de AI para los sistemas de alto riesgo es una valiosa ayuda para el cumplimiento del RGPD. No partimos de cero.

En términos prácticos, la documentación sobre la calidad de los datos y las pruebas de sesgo pueden alimentar directamente la Evaluación de Impacto sobre la Protección de Datos (EIPD ), que es obligatoria según el RGPD.

Cajas de arena reguladoras» para la innovación sin riesgo

He aquí una oportunidad que no debes desaprovechar.

Su objetivo es claro: permitir que las empresas, especialmente las PYME y las empresas de nueva creación, prueben su IA innovadora bajo la supervisión de las autoridades, para asegurarse de que son conformes antes de un lanzamiento oficial.

Prepararse para el cumplimiento: un doble papel obligatorio

No cometas el error de compartimentar tus equipos. Ahora las empresas tienen que pensar en su estrategia de cumplimiento desde dos ángulos: la protección de datos (RGPD) y la fiabilidad del sistema (Ley de AI).

Para las aplicaciones prácticas, esto significa que el diseño de tu próximo chatbot conversacional de IA deberá incorporar estas dos dimensiones desde el principio.

La Ley de AI marca un punto de inflexión decisivo: Europa no pretende frenar la innovación, sino ofrecerle un sólido marco de confianza. Para las empresas, el cumplimiento se está convirtiendo en una auténtica ventaja competitiva. Entonces, ¿estás preparado para afrontar el reto? Será mejor que empieces a pensar ya, porque dada la cuantía de las multas, la factura podría ser elevada.

PREGUNTAS FRECUENTES

¿Qué es exactamente la Ley de IA?

En pocas palabras, es la primera ley global del mundo que regula la inteligencia artificial. Encabezada por la Unión Europea, esta normativa no pretende prohibir la tecnología, sino establecer unas normas básicas claras. La idea es clasificar la IA en función de su peligrosidad: cuanto mayor sea el riesgo para los ciudadanos, mayores serán las restricciones. Es un poco como el «código de circulación» de los algoritmos para garantizar nuestra seguridad y nuestros derechos.

¿Cuándo entra realmente en vigor esta ley?

No se trata de un «big bang» inmediato, sino de una aplicación gradual para dar tiempo a todos a adaptarse. Las prácticas totalmente prohibidas (las líneas rojas) se prohibirán a partir de 2024. Las normas relativas a la IA generativa (como los modelos que hay detrás de ChatGPT) llegarán en 2025. Por último, el grueso de las normas relativas a los sistemas de alto riesgo será plenamente aplicable hacia 2026 o 2027.

¿Cuáles son los niveles de riesgo definidos por la Ley IA?

Europa ha optado por un enfoque piramidal muy pragmático. Hay cuatro niveles principales: riesgo inaceptable (sistemas prohibidos, como la calificación social), riesgo alto (estrictamente regulado, para la sanidad o la justicia, por ejemplo), riesgo limitado (que sólo requiere transparencia, como para los chatbots) y, por último, riesgo mínimo (sin restricciones, para los filtros de spam o los videojuegos).

¿Quién estuvo detrás de la adopción de la Ley IA?

Se trata de una iniciativa de la Unión Europea. El texto fue debatido y adoptado por las instituciones europeas (Parlamento y Consejo) para que pueda aplicarse uniformemente en los 27 Estados miembros. Un pequeño pero importante detalle: gracias a su alcance extraterritorial, no importa que la empresa sea estadounidense o china, es la UE la que impone sus normas en cuanto el sistema se utiliza en suelo europeo.

¿Qué se entiende por «deployeur» en el texto?

¡Cuidado con el matiz! El «desplegador» no es la persona que codifica la IA (ese es el proveedor), sino la entidad que la utiliza en un contexto profesional. Si tu empresa instala un software de IA para clasificar CV, se considera un «desplegador«. Como tal, tiene responsabilidades específicas, como garantizar que un humano vigile las decisiones de la máquina.

¿Qué significa la palabra «Actuar» en este contexto?

Es simplemente el término jurídico inglés para una «ley». En buen francés, hablamos de «Règlement sur l’Intelligence Artificielle», pero el nombre «Ley de IA» ha permanecido en el lenguaje común, incluso aquí en Francia. Es más corto y suena un poco más moderno, hay que reconocerlo.

¿Cuáles son las sanciones por incumplir las normas?

Europa se toma en serio el cumplimiento. Como vimos con el RGPD, las sanciones están diseñadas para ser disuasorias. La Ley de IA prevé