Das Wichtigste in Kürze: Der IA Act schafft die erste weltweite Regelung, die künstliche Intelligenz in vier Risikostufen einteilt, von einem reinen Verbot bis hin zu minimalen Verpflichtungen. Dieser harmonisierte Rechtsrahmen

Bereitet Ihnen das Inkrafttreten des IA-Acts kalte Füße, was die Zukunft Ihrer innovativen Projekte in Europa betrifft? Keine Sorge, wir verstehen diese Verordnung nicht als unüberwindbares Hindernis, sondern als

Der IA Act entschlüsselt: Spielregeln für Europa

Was ist der IA Act konkret?

Der IA Act markiert einen historischen Wendepunkt: Er ist die erste umfassende Gesetzgebung der Welt, die als Rahmen für künstliche Intelligenz konzipiert wurde. Die EU-Verordnung erlegt sowohl Entwicklern als auch Nutzern strenge und klare Regeln auf.

Vergessen Sie die Idee eines massiven Verbots. Der Text zielt vielmehr darauf ab, eine sichere und ethische Nutzung der Technik zu gewährleisten. Alles basiert auf einem Schlüsselwort: Vertrauen.

Die Ambitionen sind klar: die Wiederholung des Meisterstücks der DSGVO im Jahr 2018 und die Durchsetzung eines globalen Standards.

Die großen Ziele hinter dem Gesetz

Die oberste Priorität bleibt die Sicherheit der Bürger. Unsere Grundrechte müssen geschützt und die Demokratie gegen die möglichen Auswüchse dieser mächtigen Technologien abgeschirmt werden.

Europa möchte auch einen Binnenmarkt für „legale, sichere und zuverlässige“ Anwendungen schaffen. Die Idee dahinter? Ein stabiler Rechtsrahmen, der Sicherheit bietet, um Investitionen und Innovationen auf dem alten Kontinent zu stimulieren.

Das Ziel ist nicht, die KI zu bremsen, sondern sie zu lenken. Es geht darum, sicherzustellen, dass der Mensch die Kontrolle behält und dass die Technologie unseren Werten dient.

Wer ist im Visier? Der Geltungsbereich der Verordnung

Das Gesetz ist weit gefasst: Es betrifft jedes Unternehmen, das ein KI-System auf dem EU-Markt platziert oder dessen Nutzung sich auf Personen in der EU auswirkt.

Achten Sie auf den extraterritorialen Geltungsbereich. Es spielt keine Rolle, ob Ihre Firma in den USA oder in China ansässig ist. Wenn Ihr KI-Produkt in Europa eingesetzt wird, müssen Sie sich an den IA Act halten. Dies ist ein wichtiger Punkt, der von vielen unterschätzt wird.

Eine klare Definition des Begriffs „KI-System“.

Offiziell ist es ein maschinelles System, das mit variabler Autonomie arbeitet. Es

Diese Formulierung ist bewusst weit gefasst, um sowohl aktuelle als auch zukünftige Technologien zu umfassen. Er umfasst die verschiedenen Arten von künstlicher Intelligenz, die jeden Tag neu entstehen.

Der risikobasierte Ansatz: eine Pyramide mit vier Ebenen

Das Prinzip: Je größer das Risiko, desto strenger die Regeln.

Europa entscheidet sich für Pragmatismus mit einem risikobasierten Ansatz und lehnt eine blinde Regulierung ab. Das Ziel ist einfach: nicht allen Algorithmen die gleichen Beschränkungen auferlegen.

Die Logik ist einleuchtend: Ein Spamfilter kann nicht den gleichen potenziellen Schaden verursachen wie eine fehlerhafte medizinische Diagnosesoftware. Die Regulierung wird daher streng und verhältnismäßig an die tatsächliche Gefahr für die Gesundheit, Sicherheit oder unsere Grundrechte angepasst.

Die vier Risikokategorien auf einen Blick

Der Text unterscheidet zwischen vier genau definierten Niveaus: unannehmbares Risiko, hohes Risiko, begrenztes Risiko und minimales Risiko.

Diese Übersichtstabelle ist Ihr Kompass, damit Sie sich nicht verirren. Sie hilft Ihnen, die Kategorie Ihres KI und die daraus resultierenden Verpflichtungen sofort zu identifizieren und erspart Ihnen so viele kostspielige rechtliche Probleme.

| Risikoniveau | Beschreibung | Konkrete Beispiele | Hauptanleihe |

|---|---|---|---|

| Unannehmbares Risiko | Direkte Bedrohung der Rechte und der Sicherheit von Personen | Soziale Bewertung durch Regierungen, unterschwellige Verhaltensmanipulation, Gesichtserkennung in Echtzeit (mit strengen Ausnahmen). | Vollständiges Verbot |

| Hohes Risiko | Erhebliche Auswirkungen auf die Sicherheit oder die Grundrechte. | Rekrutierung (Sichtung von Lebensläufen), medizinische Diagnostik, Kreditvergabe, Justiz- und Polizeisysteme. | Strenge Einhaltung (Bewertung, Dokumentation, menschliche Überwachung) vor der Markteinführung. |

| Begrenztes Risiko | Risiko der Täuschung oder mangelnder Transparenz für den Nutzer. | Chatbots, Systeme, die Deepfakes erzeugen, Sprachassistenten. | Verpflichtung zur Transparenz (der Nutzer muss wissen, dass er mit einer KI interagiert). |

| Minimales Risiko | Kein oder nur ein geringes Risiko für Rechte oder Sicherheit. | Spam-Filter, Videospiele, einfache Empfehlungssysteme. | Keine gesetzliche Verpflichtung (freiwillige Verhaltenskodizes werden gefördert). |

Warum diese Klassifizierung der Eckpfeiler des Textes ist

Diese Methode ermöglicht es, dort hart durchzugreifen, wo es wirklich notwendig ist. Sie verhindert, dass die technische Innovation bei harmlosen Werkzeugen durch eine blinde und kontraproduktive Bürokratie gebremst wird.

Die Verhältnismäßigkeit bleibt der Schlüssel, um die Industrie dazu zu bringen, die Pille zu akzeptieren. Sie ist der lebenswichtige Kompromiss zwischen dem starken Schutz der europäischen Bürger und der Aufrechterhaltung eines dynamischen Wirtschaftswachstums.

Jenseits von Risiken, ein Wunsch nach Harmonisierung

Ohne diesen Text hätte jedes Land in seiner Ecke seine eigenen Gesetze zusammengebastelt. Für Unternehmen wäre das Jonglieren mit 27 widersprüchlichen Regelungen eine administrative und finanzielle Hölle gewesen.

Der IA Act schreibt nunmehr ein einheitliches Regelwerk für alle Mitgliedstaaten vor. In Paris konform zu sein, bedeutet, auch in Berlin konform zu sein, ein enormer Vorteil für einen flüssigeren Binnenmarkt.

Rote Linie: Verbotene Praktiken und Systeme mit hohem Risiko

Nachdem wir die globale Landschaft überblickt haben, wollen wir uns nun der Spitze der Gesetzespyramide zuwenden. Hier verbergen sich die absoluten roten Linien und Einschränkungen, die die Rechtsabteilungen zum Zittern bringen.

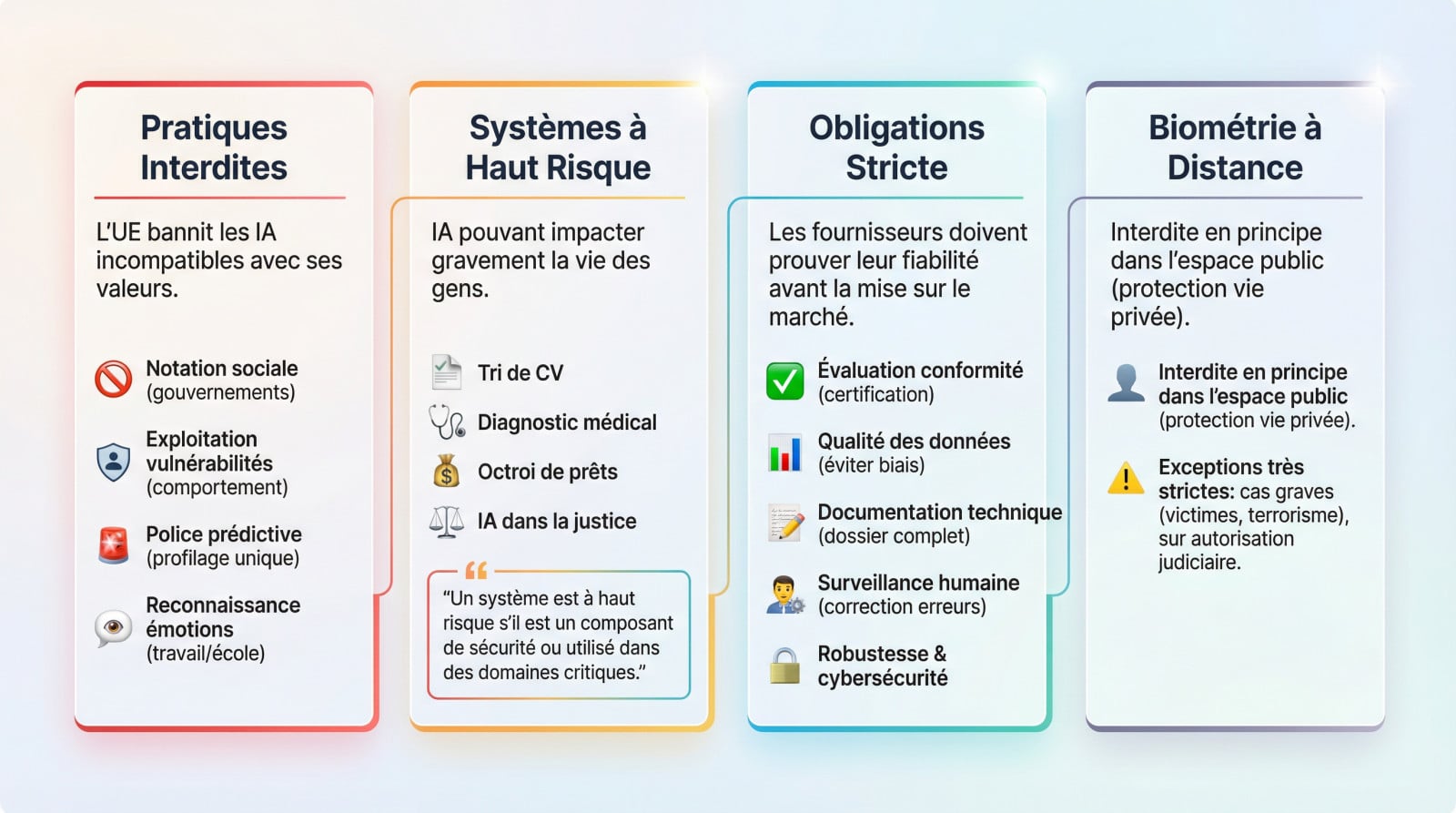

Was Europa schlichtweg verbietet

Der IA Act ist in diesem Punkt nicht zimperlich: Einige Anwendungen verletzen unsere Grundwerte. Sie sind daher auf europäischem Boden strengstens verboten. Keine Verhandlungen möglich.

Dies ist die schwarze Liste, die jeder Entwickler auswendig kennen muss, um nicht an die Wand gefahren zu werden:

- Soziale Bewertungssysteme („social scoring“) durch Regierungen, eine Praxis, die in China beobachtet werden kann.

- KI, die alters- oder behinderungsbedingte Schwachstellen manipuliert, um das Verhalten zu ändern.

- Predictive Policing-Systeme, die ausschließlich auf der Erstellung von Profilen einer Person basieren.

- Die Erkennung von Emotionen, die am Arbeitsplatz oder in Schulen eingesetzt wird.

Was ist ein „Hochrisikosystem“?

Hochrisikosysteme werden durch ihre Fähigkeit definiert, unser Leben ernsthaft zu beeinflussen. Es ist nicht die Technologie, die ein Problem darstellt, sondern der Bereich, in dem sie eingesetzt wird.

Denken Sie an Software zur Sortierung von Lebensläufen, medizinische Diagnosetools, Algorithmen für Bankkredite oder KI im Justizbereich. Hier sind Fehler verboten.

Ein System stellt ein hohes Risiko dar, wenn es eine Sicherheitskomponente eines Produkts ist oder in gesetzlich aufgelisteten kritischen Bereichen eingesetzt wird.

Schwere Pflichten für sensible Systeme

Die Anbieter können sich keine Fehler erlauben und müssen die Zuverlässigkeit ihres Tools vor der Markteinführung nachweisen. Dies ist eine massive Markteintrittsbarriere.

Um grünes Licht zu erhalten, ist die Liste der Pflichten lang und technisch:

- Konformitätsbewertung: Das System von den zuständigen Behörden zertifizieren lassen.

- Datenqualität: Trainieren Sie die KI mit einwandfreien Datensätzen, um Verzerrungen zu vermeiden.

- Technische Dokumentation: Führen Sie ein umfassendes Register, das die interne Funktionsweise des Systems erläutert.

- Menschliche Überwachung: Sicherstellung einer menschlichen Überwachung, die in der Lage ist, einzugreifen und Abweichungen zu korrigieren.

- Robustheit und Cybersicherheit: Sicherstellung, dass das System Angriffen standhält und zuverlässig ist.

Biometrische Identifizierung: ein Fallbeispiel

Europa schlägt zu: Die biometrische Identifizierung aus der Ferne und in Echtzeit im öffentlichen Raum wird standardmäßig verboten. Dies ist ein wichtiger Sieg für den Schutz der Privatsphäre. Ihre Gesichter sind keine freien Daten. Big Brother wird nicht durchkommen.

Die Tür bleibt jedoch einen Spalt breit offen, da es sehr strenge Ausnahmen gibt, die von einem Richter bestätigt werden müssen. Hier geht es um die Suche nach Opfern oder eine unmittelbare terroristische Bedrohung. Die Sicherheit geht manchmal vor.

Generative KI und ABM: ein maßgeschneiderter Rahmen

Es wurde viel über coole Anwendungen gesprochen, aber das eigentliche Thema ist der Motor unter der Motorhaube. Der IA Act hat dies nicht vergessen und widmet ein ganzes Kapitel diesen massiven Technologien, die unsere täglichen Werkzeuge antreiben.

KI-Modelle für allgemeine Zwecke (GPAI) im Fokus

GPAIs (General-Purpose AI models) sind nicht einfach nur Software, sie sind wahre Kraftpakete. Sie sind in der Lage, eine enorme Vielfalt an Aufgaben auszuführen, ohne für eine bestimmte Funktion programmiert worden zu sein.

Sie kennen sie bereits, es sind die Köpfe hinter ChatGPT oder Midjourney. Technologien wie Google Gemini fallen genau in diese Kategorie. Europa hat entschieden, dass diese Modelle nicht länger frei operieren können.

Transparenz, die neue goldene Regel

Schluss mit den undurchdringlichen Black Boxes. Die Hauptpflicht für Anbieter von ISPM ist eine radikale Transparenz, die sich in der Anforderung einer betonierten technischen Dokumentation als Beweis für ihren guten Glauben manifestiert.

Konkret müssen sie nun Folgendes auf den Tisch legen:

- Legen Sie eine genaue technische Dokumentation vor, die die tatsächlichen Fähigkeiten und Grenzen des Modells detailliert beschreibt.

- Stellen Sie eine Zusammenfassung des für das Training verwendeten Inhalts zur Verfügung, ohne etwas zu verbergen.

- Einführung einer strengen Politik zur Einhaltung des europäischen Urheberrechts.

- Deutliche Kennzeichnung der erzeugten Inhalte (Text, Bild, Video), um zu signalisieren, dass sie künstlich sind.

Die Einhaltung des Urheberrechts, ein nicht verhandelbarer Punkt

Dies ist oft der Punkt, an dem es klemmt. Der IA Act verpflichtet ABM-Entwickler, nachzuweisen, dass sie bei der massiven Sammlung ihrer Trainingsdaten die Urheberrechtsgesetze eingehalten haben.

Dies ist keine reine Verwaltungsformalität. Sie müssen in der Lage sein, eine detaillierte Zusammenfassung der von ihnen aufgenommenen geschützten Quellen vorzulegen. Für Urheber und Verleger ist dies eine kleine Revolution, die Ordnung schafft.

Der Sonderfall der ABIS mit „systemischem Risiko“

Einige Modelle sind zu groß, um ignoriert zu werden. Man spricht von einem systemischen Risiko, sobald die kumulierte Rechenleistung für den Antrieb eine kritische Schwelle überschreitet, die potenziell die öffentliche Sicherheit oder die Grundrechte bedroht.

Für diese Giganten ist die Messlatte höher. Sie müssen gründliche Modellbewertungen durchführen, aktiv Risiken managen, jeden ernsthaften Vorfall der Kommission melden und ein unangreifbares Maß an Cybersicherheit gewährleisten.

Governance und Zeitplan: Wer steuert und bis wann?

Ein Gesetz ist auf dem Papier schön und gut, aber wer wird es tatsächlich umsetzen und ab wann werden die Messer fallen? Es ist an der Zeit, konkret zu werden: Governance und Zeitplan für die Einführung.

Das „Büro für KI“: der neue europäische Gendarm

Sie kennen es vielleicht noch nicht, aber das Europäische Büro für Künstliche Intelligenz (AI Office) wird schnell zu einer festen Größe werden. Diese neue Struktur, die im Herzen der Europäischen Kommission angesiedelt ist, fungiert als der wahre Dirigent der Regulierung.

Seine Aufgabe ist alles andere als symbolisch. Das Büro überwacht direkt die Anwendung der Regeln für Gebrauchsmuster (GPAI), koordiniert die nationalen Behörden und trägt aktiv zur Entwicklung technischer Standards bei.

Lieferanten, Bereitsteller: Wer macht was?

Verwechseln Sie nicht die Rollen, ein Fehler könnte Sie teuer zu stehen kommen. Der Anbieter ist der Architekt: Er ist die Einheit, die das System entwickelt oder auf den Markt bringt. Auf seinen Schultern lastet der Großteil der Compliance-Verpflichtungen.

Auf der anderen Seite steht der Deployer. Dies ist das Unternehmen oder die Behörde, das/die ein KI-System, insbesondere ein Hochrisikosystem, in einem professionellen Rahmen nutzt. Was ist seine Verantwortung? Die Gewährleistung einer angemessenen menschlichen Überwachung und einer Nutzung entsprechend der Gebrauchsanweisung.

Der Zeitplan für die Umsetzung: eine schrittweise Einführung

Sie denken, Sie haben Zeit? Da irren Sie sich. Das Gesetz tritt zwar nicht abrupt in Kraft, aber seine Einführung folgt einem genauen gestaffelten Zeitplan. Das Ziel ist es, den Akteuren ein Zeitfenster zur Anpassung zu geben, aber dieses Zeitfenster schließt sich schnell wieder.

Merken Sie sich diese Fristen: Die ersten Verbote gelten ab 2024 und Anfang 2025. Dann gelten die strengen Regeln für ABMM Mitte 2025. Der größte Teil der Maßnahmen für Hochrisikosysteme wird zwischen 2026 und 2027 voll wirksam.

Was ist mit den Sanktionen?

Brüssel ist nicht auf den Mund gefallen. Die Verordnung rüstet die Regulierungsbehörden mit massiven finanziellen Sanktionen aus, um die Nichteinhaltung zu bestrafen. Es geht hier um Beträge, die eine finanziell solide Struktur destabilisieren können.

Die Logik ähnelt der der DSGVO, ist jedoch strenger. Die Geldbußen können bis zu 7 % des weltweiten Umsatzes oder 35 Millionen Euro betragen. Es handelt sich hierbei um eine starke Abschreckung, die niemand ignorieren sollte.

KI-Gesetz und DSGVO: das Gewinner-Duo für die Einhaltung der Vorschriften

Lassen Sie uns abschließend eine Frage ansprechen, die sich viele Unternehmen stellen: Wie wird dieses neue Gesetz mit der berühmten DSGVO zusammenarbeiten? Spoiler: Sie sind dazu bestimmt, zusammenzuarbeiten.

Nein, der IA Act ist kein Ersatz für die DSGVO

Diese Verwechslung wird oft gemacht, aber lassen Sie uns sofort klarstellen, dass der IA Act und die GDPR (General Data Protection Regulation) zwei sich ergänzende Gesetze sind. Es ist eine Tatsache, dass das eine das andere nicht verdrängt.

Es ist eigentlich ganz einfach: Die DSGVO schützt die persönlichen Daten von Einzelpersonen, während der IA Act die Sicherheit und Zuverlässigkeit von KI-Produkten und -Dienstleistungen regelt.

Wenn ein KI-System personenbezogene Daten verarbeitet, muss es beide Verordnungen einhalten. Die Einhaltung der einen Verordnung entbindet nicht von der Einhaltung der anderen Verordnung.

Wie der IA Act die Anforderungen der DSGVO verschärft

Sehen Sie den Link? Die vom IA Act verlangte Dokumentationsarbeit für Hochrisikosysteme ist eine

Konkret kann die Dokumentation der Datenqualität und der Bias-Tests direkt in die Datenschutz-Folgenabschätzung (DSFA) einfließen, die unter der DSGVO obligatorisch ist.

Regulatorische Sandkästen“ für risikofreie Innovationen

Dies ist eine Gelegenheit, die Sie nicht verpassen sollten. Gesetzliche Sandkästen (Sandboxes) sind kontrollierte Umgebungen, die von den Behörden eingerichtet wurden, um ohne die unmittelbare Angst vor Sanktionen zu testen. Dies ist eine der guten Ideen des Textes.

Ihr Ziel ist klar: Unternehmen, insbesondere KMU und Start-ups, sollen die Möglichkeit haben , ihre innovativen KIs unter behördlicher Aufsicht zu testen, um sicherzustellen, dass sie vor der offiziellen Markteinführung den Anforderungen entsprechen.

Vorbereitung auf die Compliance: ein obligatorischer Doppelhut

Machen Sie nicht den Fehler, Ihre Teams zu trennen. Unternehmen müssen ihre Compliance-Strategie jetzt mit einer doppelten Vision betrachten: Datenschutz (DSGVO) und Systemzuverlässigkeit (IA Act).

Für konkrete Anwendungen bedeutet dies, dass das Design Ihres nächsten KI-Chatbots diese beiden Dimensionen von Anfang an berücksichtigen muss.

Der IA Act markiert einen Wendepunkt: Europa versucht nicht, die Innovation zu bremsen, sondern ihr einen soliden Vertrauensrahmen zu bieten. Für Unternehmen wird die Einhaltung der Vorschriften zu einem echten Wettbewerbsvorteil. Sind Sie also bereit,

FAQ

Was genau ist der AI Act?

Einfach ausgedrückt ist dies das erste umfassende Gesetz der Welt zur Regelung der künstlichen Intelligenz. Die von der Europäischen Union getragene Verordnung versucht nicht, die Technologie zu verbieten, sondern klare Spielregeln aufzustellen. Die Idee ist, Künstliche Intelligenz nach ihrer Gefährlichkeit zu klassifizieren: je höher das Risiko für die Bürger, desto stärker die Einschränkungen. Dies ist eine Art „Straßenverkehrsordnung“ für Algorithmen, um unsere Sicherheit und unsere Rechte zu gewährleisten.

Wann tritt dieses Gesetz in Kraft?

Es handelt sich nicht um einen sofortigen „Big Bang“, sondern vielmehr um eine schrittweise Einführung, um allen Zeit zur Anpassung zu geben. Völlig verbotene Praktiken (die roten Linien) werden ab 2024 verboten. Die Regeln für generative KI (wie die Modelle hinter ChatGPT) werden 2025 eingeführt. Schließlich wird der größte Teil der Bestimmungen für Hochrisikosysteme um 2026 oder 2027 vollständig umgesetzt sein.

Welche Risikoniveaus definiert der IA Act?

Europa hat sich für einen sehr pragmatischen pyramidalen Ansatz entschieden. Es werden im Wesentlichen vier Stufen unterschieden: inakzeptables Risiko (verbotene Systeme, z.B. soziale Ratings), hohes Risiko (streng geregelt, z.B. für das Gesundheitswesen oder die Justiz), begrenztes Risiko (erfordert nur Transparenz, z.B. bei Chatbots) und schließlich minimales Risiko (keine Einschränkungen, z.B. bei Spamfiltern oder Videospielen).

Wer hat die Verabschiedung des IA Act veranlasst?

Dies ist eine Initiative der Europäischen Union. Der Text wurde von den EU-Institutionen (Parlament und Rat) diskutiert und verabschiedet, um in allen 27 Mitgliedstaaten einheitlich angewendet zu werden. Ein kleines Detail, das wichtig ist: Dank des extraterritorialen Geltungsbereichs spielt es keine Rolle, ob das Unternehmen aus den USA oder China stammt.

Was ist in dem Text mit „Entführer“ gemeint?

Achten Sie auf die Nuance! Der „Bereitsteller“ ist nicht derjenige, der die KI codiert (das ist der Anbieter), sondern die Einheit, die die KI in einem professionellen Rahmen nutzt. Wenn Ihr Unternehmen eine KI-Software installiert, um Lebensläufe zu sortieren, wird es als „Bereitsteller“ betrachtet. Als solcher hat es bestimmte Verantwortlichkeiten, wie z.B. sicherzustellen, dass ein Mensch die Entscheidungen der Maschine im Auge behält.

Was bedeutet das Wort „Act“ in diesem Zusammenhang?

Es ist ganz einfach, es ist einfach der englische Rechtsbegriff für ein „Gesetz“. In gutem Französisch spricht man von „Règlement sur l’Intelligence Artificielle“, aber die Bezeichnung „AI Act“ hat sich auch bei uns in der Umgangssprache gehalten. Es ist kürzer und klingt zugegebenermaßen etwas moderner.

Welche Sanktionen gibt es, wenn man sich nicht an die Regeln hält?

Europa meint es ernst mit der Einhaltung von Vorschriften. Wie wir bei der DSGVO gesehen haben, sollen die Sanktionen abschreckend sein. Der AI Act sieht sehr hohe Geldbußen vor, die einen erheblichen Prozentsatz des weltweiten Umsatzes des Unternehmens ausmachen können, das gegen die Bestimmungen verstößt. Es ist daher besser, das Thema jetzt ernst zu nehmen.