Pontos importantes a serem lembrados: a Lei de IA estabelece as primeiras regulamentações do mundo que classificam a inteligência artificial de acordo com quatro níveis de risco, desde a proibição total até as obrigações mínimas. Essa estrutura jurídica harmonizada garante a inovação e protege os direitos na Europa. Assim como o RGPD, ela se aplica a qualquer entidade, europeia ou não, que opere no mercado da UE, com penalidades dissuasivas a seguir.

A entrada em vigor da lei ia está fazendo você suar frio em relação ao futuro de seus projetos inovadores na Europa? Não se preocupe, não vemos essa regulamentação como um obstáculo intransponível, mas como

A Lei de Assuntos Internos decifrada: as regras do jogo para a Europa

Em termos concretos, o que é a Lei de Assuntos Internos?

O AI Act marca um ponto de virada histórico: é a primeira legislação abrangente do mundo criada para fornecer uma estrutura para a inteligência artificial. Essa regulamentação da União Europeia impõe regras rigorosas e claras tanto para desenvolvedores quanto para usuários.

Esqueça a ideia de uma proibição em massa. Em vez disso, o texto visa a garantir o uso seguro e ético da tecnologia. Tudo isso depende de uma palavra-chave: confiança.

A ambição é clara: repetir o golpe de mestre do RGPD em 2018 e impor um padrão global.

Os principais objetivos por trás da lei

A prioridade absoluta continua sendo a segurança de nossos cidadãos. Precisamos proteger nossos direitos fundamentais e blindar a democracia contra os possíveis abusos dessas tecnologias poderosas.

A Europa também quer criar um mercado único para aplicativos “legais, seguros e confiáveis”. A ideia? Fornecer uma estrutura jurídica estável e tranquilizadora para estimular o investimento e a inovação no velho continente.

O objetivo não é frear a IA, mas orientá-la. Trata-se de garantir que os seres humanos permaneçam no comando e que a tecnologia sirva aos nossos valores.

Quem é o alvo? O escopo do regulamento

O escopo da lei é amplo: ela diz respeito a qualquer entidade que coloque um sistema de IA no mercado da UE ou cujo uso tenha impacto sobre pessoas localizadas na UE.

Cuidado com o alcance extraterritorial. Não importa se sua empresa está sediada nos EUA ou na China. Se o seu produto de IA estiver sendo executado na Europa, você terá que cumprir a Lei de IA. Esse é um ponto importante que muitas pessoas subestimam.

Uma definição clara de um “sistema de IA

Oficialmente, é um sistema de máquina que opera com autonomia variável. Ele gera previsões, conteúdo ou decisões que influenciam diretamente ambientes reais ou virtuais. Uma definição feita sob medida para o futuro.

Esse texto é deliberadamente amplo para abranger tecnologias atuais e futuras. Ela abrange os diferentes tipos de inteligência artificial que estão surgindo todos os dias.

A abordagem baseada em riscos: uma pirâmide de quatro níveis

O princípio: quanto maior o risco, mais rígidas as regras

A Europa está optando por uma abordagem pragmática e baseada em riscos, recusando-se a regulamentar cegamente. O objetivo é simples: não impor as mesmas restrições a todos os algoritmos.

A lógica é óbvia: um filtro anti-spam não representa o mesmo dano potencial que um software de diagnóstico médico defeituoso. Portanto, a regulamentação é estritamente proporcional ao perigo real à saúde, à segurança ou aos nossos direitos fundamentais.

Visão geral das quatro categorias de risco

O texto distingue quatro níveis bem específicos: risco inaceitável, alto risco, risco limitado e risco mínimo.

Essa tabela de resumo funciona como uma bússola para ajudar você a se manter no caminho certo. Ela permite que você identifique imediatamente a categoria do seu IA e as obrigações resultantes, poupando-o de muitas dores de cabeça legais dispendiosas.

| Nível de risco | Descrição | Exemplos concretos | Obrigação principal |

|---|---|---|---|

| Risco inaceitável | Ameaça direta aos direitos e à segurança individuais | Classificação social por governos, manipulação subliminar de comportamento, reconhecimento facial em tempo real (com exceções rigorosas). | Proibição total |

| Alto risco | Impacto significativo na segurança ou nos direitos fundamentais | Recrutamento (classificação de currículos), diagnóstico médico, concessão de crédito, sistemas de justiça e polícia. | Conformidade rigorosa (avaliação, documentação, monitoramento humano) antes da comercialização. |

| Risco limitado | Risco de engano ou falta de transparência para o usuário | Chatbots, sistemas que geram deepfakes, assistentes de voz. | Obrigação de transparência (os usuários devem saber que estão interagindo com uma IA). |

| Risco mínimo | Pouco ou nenhum risco aos direitos ou à segurança | Filtros de spam, videogames, sistemas de recomendação simples. | Nenhuma obrigação legal (códigos de conduta voluntários são incentivados). |

Por que essa classificação é a base do texto

Esse método permite que você atinja com força onde realmente é necessário. Ele evita sufocar a inovação técnica em ferramentas inofensivas com burocracia cega e contraproducente.

A proporcionalidade continua sendo a chave para fazer com que o setor aceite a pílula. É o compromisso vital entre proteger ferozmente os cidadãos europeus e manter o crescimento econômico dinâmico.

Além dos riscos, um desejo de harmonização

Sem esse texto, cada país teria criado suas próprias leis em seu próprio canto. Para as empresas, fazer malabarismos com 27 regulamentações contraditórias teria sido um verdadeiro pesadelo administrativo e financeiro.

A Lei de Assuntos Internos agora impõe um único conjunto de regras para todos os Estados-Membros. Estar em conformidade em Paris significa estar em conformidade em Berlim, uma vantagem colossal para tornar o mercado interno mais fluido.

Linha vermelha: práticas proibidas e sistemas de alto risco

Depois de examinar o cenário global, vamos dar um zoom no topo da pirâmide legislativa. É aqui que se escondem as linhas vermelhas absolutas e as restrições que fazem os departamentos jurídicos tremerem.

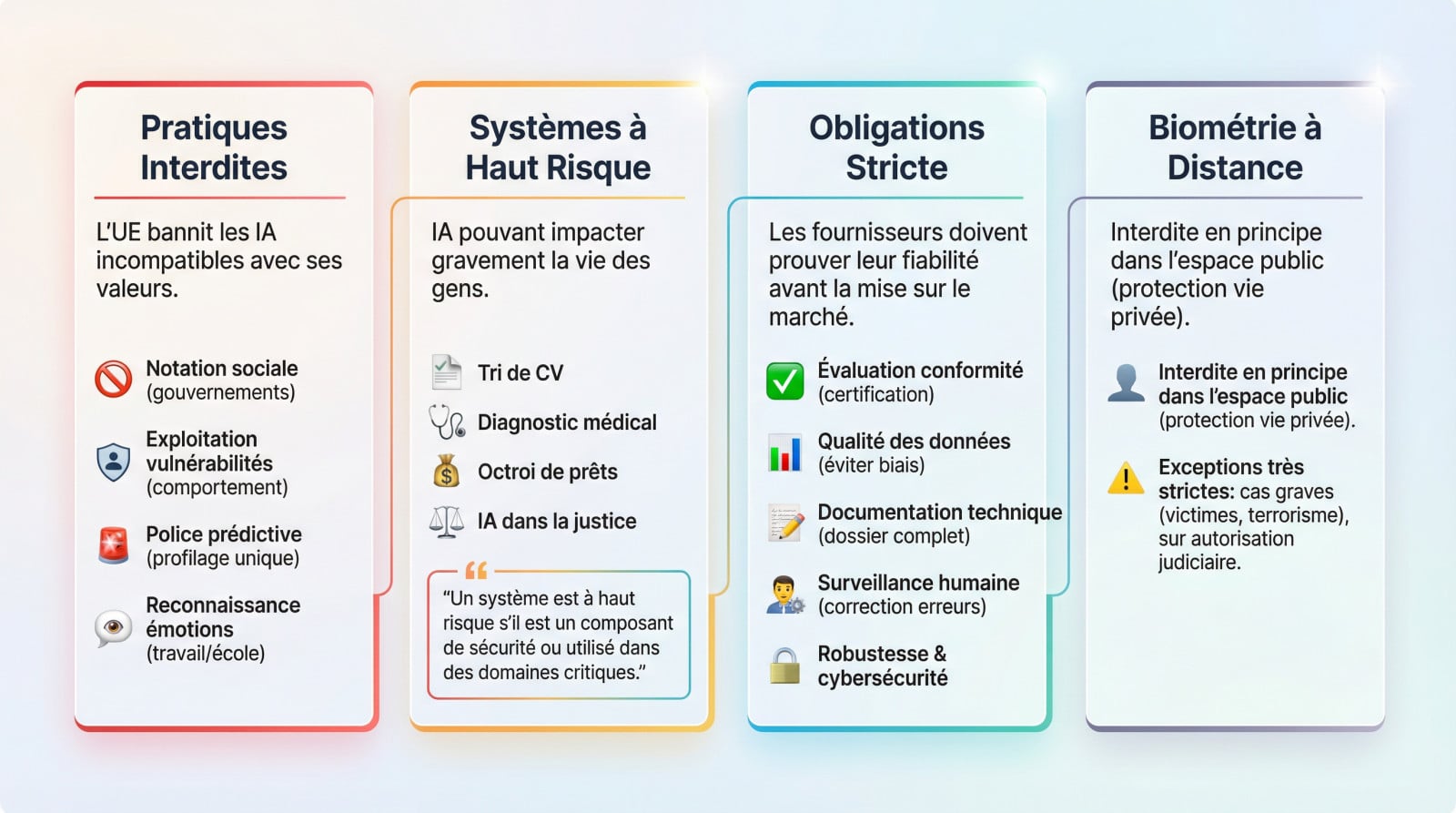

O que a Europa proíbe totalmente

A Lei de Assuntos Internos não é negligente com relação a esse ponto: determinados aplicativos violam nossos valores fundamentais. Portanto, elas são estritamente proibidas em solo europeu. Não há possibilidade de negociação.

Aqui está a lista negra que todo desenvolvedor precisa saber de cor para evitar o muro:

- Sistemas de pontuação social pelos governos, uma prática observada na China.

- IA que manipula vulnerabilidades ligadas à idade ou deficiência para modificar o comportamento.

- Sistemas de policiamento preditivo baseados exclusivamente no perfil de um indivíduo.

- Reconhecimento de emoções usado no local de trabalho ou nas escolas.

O que é um “sistema de alto risco”?

Os sistemas de alto risco são definidos por sua capacidade de causar um impacto sério em nossas vidas. Não é a tecnologia que representa o problema, mas sua área precisa de aplicação.

Pense no software de classificação de currículos, nas ferramentas de diagnóstico médico, nos algoritmos de empréstimos bancários ou na IA no sistema judiciário. Os erros são proibidos.

Um sistema é de alto risco se for um componente de segurança de um produto ou se for usado em áreas críticas listadas por lei.

Obrigações pesadas para sistemas sensíveis

Os fornecedores não têm o direito de cometer erros e precisam provar a confiabilidade de sua ferramenta antes de colocá-la no mercado. É uma barreira enorme para você entrar no mercado.

Há uma lista longa e técnica de tarefas a serem concluídas antes que você possa esperar receber o sinal verde:

- Avaliação da conformidade: Certificação do sistema pelas autoridades competentes.

- Qualidade dos dados: treine a IA em conjuntos de dados impecáveis para evitar qualquer viés.

- Documentação técnica: mantenha um diário de bordo abrangente que explique o funcionamento interno do sistema.

- Supervisão humana: garantir a supervisão humana capaz de intervir e corrigir desvios.

- Robustez e segurança cibernética: garantir que o sistema seja resistente a ataques e permaneça confiável.

Identificação biométrica: um caso exemplar

A Europa está atacando com força: a identificação biométrica remota e em tempo real em espaços públicos está proibida por padrão. Essa é uma grande vitória para a proteção da privacidade. Seus rostos não são dados gratuitos. O Big Brother não vai desaparecer.

No entanto, a porta permanece entreaberta por meio de exceções muito rigorosas, validadas por um juiz. Essas exceções incluem buscas por vítimas ou ameaças terroristas iminentes. Às vezes, a segurança vem em primeiro lugar.

IA generativa e GPAI: uma estrutura sob medida

Muito se tem falado sobre aplicativos legais, mas o verdadeiro assunto é o motor sob o capô. O AI Act não se esqueceu disso e dedica um capítulo inteiro às tecnologias massivas que alimentam nossas ferramentas cotidianas.

Modelos de IA de uso geral (GPAI) em destaque

Os GPAIs (modelos de IA de uso geral) não são apenas softwares, eles são monstros de poder. Eles têm uma versatilidade rara, capazes de executar uma imensa variedade de tarefas sem terem sido programados para uma única função precisa.

Você já os conhece: os cérebros por trás do ChatGPT e do Midjourney. Tecnologias como o Google Gemini se enquadram perfeitamente nessa categoria. A Europa decidiu que você não pode mais permitir que esses modelos operem com total liberdade.

Transparência, a nova regra de ouro

Não há mais caixas pretas impenetráveis. A principal obrigação que recai sobre os provedores de IAM é a transparência radical, na forma de uma exigência de documentação técnica concreta para comprovar sua boa fé.

Em termos concretos, isso é o que eles têm agora para colocar na mesa:

- Forneça documentação técnica precisa detalhando os recursos e as limitações reais do modelo.

- Forneça um resumo do conteúdo usado no treinamento, sem ocultar nada.

- Implemente uma política rigorosa para cumprir a lei europeia de direitos autorais.

- Marque claramente o conteúdo gerado (texto, imagens, vídeo) para indicar que ele é artificial.

Respeito aos direitos autorais, um ponto inegociável

É nesse ponto que as coisas costumam ficar complicadas. A Lei de IA exige que os desenvolvedores da GPAI provem que cumpriram a legislação de direitos autorais ao coletar seus dados de treinamento em grande escala.

Isso não é apenas uma formalidade administrativa. Eles devem ser capazes de mostrar um resumo detalhado das fontes protegidas que ingeriram. Para criadores e editores, essa é uma pequena revolução que coloca as coisas em ordem novamente.

O caso especial das GPAIs de “risco sistêmico

Alguns modelos são grandes demais para serem ignorados. O termo “risco sistêmico” é usado quando a capacidade cumulativa de computação para treinamento excede um limite crítico, podendo ameaçar a segurança pública ou os direitos fundamentais.

Para esses gigantes, a exigência é maior. Elas devem realizar avaliações detalhadas dos modelos, gerenciar ativamente os riscos, comunicar qualquer incidente grave à Comissão e garantir um nível inatacável de segurança cibernética.

Governança e cronograma: quem dirige e para quando?

A legislação é muito boa no papel, mas quem de fato vai aplicá-la e quando é que você vai começar a trabalhar? Agora é a hora de falar sobre os detalhes: governança e cronograma de implementação.

O “Escritório de IA”: o novo cão de guarda da Europa

Talvez você ainda não tenha ouvido falar dele, mas o Escritório Europeu de IA está se tornando rapidamente uma força a ser reconhecida. Localizada no coração da Comissão Europeia, essa nova estrutura atua como um verdadeiro condutor regulatório.

Sua missão está longe de ser simbólica. Esse escritório supervisiona diretamente a aplicação das regras para modelos de uso geral (GPAI), coordena as autoridades nacionais e contribui ativamente para o desenvolvimento de padrões técnicos.

Fornecedores, implementadores: quem faz o quê?

Não confunda as funções – isso pode ser um erro caro. O provedor é o arquiteto: a entidade que desenvolve o sistema ou o coloca no mercado. Portanto, é sobre seus ombros que recai a maior parte das obrigações de conformidade.

Do outro lado está o implantador. Essa é a empresa ou autoridade pública que usa um sistema de IA, especialmente um sistema de alto risco, em um contexto profissional. Sua responsabilidade? Garantir a supervisão humana adequada e o uso de acordo com as instruções.

Cronograma de implementação: uma implementação gradual

Você acha que tem tempo? Pense novamente. Embora a lei não entre em vigor repentinamente, sua implementação segue um cronograma preciso e em fases. O objetivo é dar aos jogadores uma janela de oportunidade para se adaptarem, mas essa janela está se fechando rapidamente.

Tenha em mente estes prazos: as primeiras proibições entrarão em vigor em 2024 e no início de 2025. Em seguida, as regras rígidas para IPSMs serão aplicadas em meados de 2025. Por fim, a maior parte do trabalho, referente aos sistemas de alto risco, entrará totalmente em vigor entre 2026 e 2027.

E quanto às penalidades?

Bruxelas não está jogando para se manter. A regulamentação arma os reguladores com penalidades financeiras maciças para punir a não conformidade. Estamos falando aqui de valores capazes de desestabilizar uma estrutura financeiramente sólida.

A lógica lembra a do RGPD, mas é mais forte. As multas podem chegar a 7% do faturamento mundial ou 35 milhões de euros. Esse é um impedimento formidável que ninguém deve ignorar.

Lei IA e RGPD: a dupla vencedora para conformidade

Por fim, vamos abordar uma questão que muitas empresas estão se perguntando: como esse novo texto se encaixa no famoso RGPD? Spoiler: eles foram feitos para trabalharem juntos.

Não, a Lei IA não substitui o RGPD

É comum ouvirmos essa confusão, mas vamos esclarecer logo de cara: a Lei de Proteção de Dados e o RGPD (Regulamento Geral de Proteção de Dados) são duas legislações complementares. Uma não exclui a outra, isso é um fato.

Na verdade, é bem simples: o GDPR protege os dados pessoais dos indivíduos, enquanto a Lei de IA regulamenta a segurança e a confiabilidade dos produtos e serviços de IA.

Se um sistema de IA processar dados pessoais, ele terá que cumprir os dois regulamentos. A conformidade com um deles não o isenta da conformidade com o outro.

Como a Lei IA reforça os requisitos do RGPD

Você está vendo o link? O trabalho de documentação exigido pela Lei IA para sistemas de alto risco é uma ajuda valiosa para a conformidade com o RGPD. Não estamos começando do zero.

Em termos práticos, a documentação sobre a qualidade dos dados e o teste de viés pode alimentar diretamente a Avaliação de Impacto da Proteção de Dados (DPIA), que é obrigatória de acordo com o RGPD.

Sandboxes regulatórias” para inovação sem riscos

Esta é uma oportunidade que você não pode perder. Os sandboxes regulatórios são ambientes controlados criados pelas autoridades para testes sem o medo imediato de punição. Essa é uma das boas ideias do texto.

Seu objetivo é claro: permitir que as empresas, especialmente as PMEs e as start-ups, testem sua IA inovadora sob a supervisão das autoridades, para garantir a conformidade antes de um lançamento oficial.

Preparação para a conformidade: uma função dupla obrigatória

Não cometa o erro de compartimentar suas equipes. As empresas agora precisam pensar em sua estratégia de conformidade sob dois ângulos: proteção de dados (RGPD) e confiabilidade do sistema (IA Act).

Para aplicações práticas, isso significa que o design do seu próximo chatbot de IA conversacional precisará incorporar essas duas dimensões desde o início.

A Lei de Assuntos Internos marca um ponto de inflexão decisivo: a Europa não está buscando restringir a inovação, mas oferecer a ela uma sólida estrutura de confiança. Para as empresas, a conformidade está se tornando uma verdadeira vantagem competitiva. Então, você está pronto para enfrentar o desafio? É melhor você começar a pensar no futuro agora, pois, considerando o tamanho das multas, a conta pode ser alta.

PERGUNTAS FREQUENTES

O que é exatamente a Lei de IA?

Simplificando, é a primeira lei abrangente do mundo a regulamentar a inteligência artificial. Liderada pela União Europeia, essa regulamentação não busca banir a tecnologia, mas estabelecer regras básicas claras. A ideia é classificar a IA de acordo com seu grau de perigo: quanto maior o risco para os cidadãos, maiores serão as restrições. É um pouco como o “código da estrada” para que os algoritmos garantam nossa segurança e nossos direitos.

Quando essa lei realmente entrará em vigor?

Não se trata de um “big bang” imediato, mas de uma implementação gradual para que todos tenham tempo de se adaptar. As práticas totalmente proibidas (as linhas vermelhas) serão banidas a partir de 2024. As regras sobre IA generativa (como os modelos por trás do ChatGPT) serão aplicadas em 2025. Por fim, a maior parte das regras referentes a sistemas de alto risco será totalmente aplicável por volta de 2026 ou 2027.

Quais são os níveis de risco definidos pela Lei de Assuntos Internos?

A Europa optou por uma abordagem piramidal muito pragmática. Há quatro níveis principais: risco inaceitável (sistemas proibidos, como classificação social), alto risco (estritamente regulamentado, para saúde ou justiça, por exemplo), risco limitado (que exige apenas transparência, como para chatbots) e, finalmente, risco mínimo (sem restrições, para filtros de spam ou videogames).

Quem estava por trás da adoção da Lei de Assuntos Internos?

Essa é uma iniciativa da União Europeia. O texto foi debatido e adotado pelas instituições europeias (Parlamento e Conselho) para que possa ser aplicado de maneira uniforme em todos os 27 Estados-Membros. Um detalhe pequeno, mas importante: graças ao seu escopo extraterritorial, não importa se a empresa é americana ou chinesa, é a UE que impõe suas regras assim que o sistema é usado em solo europeu.

O que você quer dizer com “deployeur” no texto?

Cuidado com as nuances! O “implantador” não é a pessoa que codifica a IA (esse é o fornecedor), mas a entidade que a utiliza em um contexto profissional. Se a sua empresa instala um software de IA para classificar currículos, ela é considerada um “implantador”. Como tal, ela tem responsabilidades específicas, como garantir que um humano fique de olho nas decisões da máquina.

O que significa a palavra “Act” nesse contexto?

É simplesmente o termo jurídico em inglês para uma “lei”. Em bom francês, falamos de “Règlement sur l’Intelligence Artificielle”, mas o nome “AI Act” permaneceu na linguagem comum, mesmo aqui na França. É mais curto e soa um pouco mais moderno, é verdade.

Quais são as penalidades por violar as regras?

A Europa leva a sério a conformidade. Como vimos com o RGPD, as penalidades são projetadas para serem dissuasivas. A Lei de IA prevê multas administrativas muito pesadas que podem representar uma porcentagem significativa do faturamento global da empresa infratora. Portanto, é melhor você levar a sério agora.