Punti chiave da ricordare: l’IA Act stabilisce la prima normativa al mondo che classifica l’intelligenza artificiale secondo quattro livelli di rischio, dal divieto assoluto agli obblighi minimi. Questo quadro giuridico armonizzato garantisce l’innovazione e protegge i diritti in Europa. Come il RGPD, si applica a qualsiasi entità, europea o meno, che opera sul mercato dell’UE, con sanzioni dissuasive a seguire.

L’entrata in vigore dello ia act ti fa venire i sudori freddi sul futuro dei tuoi progetti innovativi in Europa? Non preoccuparti, non vediamo questa normativa come un ostacolo insormontabile, ma come le nuove istruzioni per costruire un’intelligenza artificiale etica e sostenibile. Qui scoprirai come destreggiarti tra i diversi livelli di rischio ed evitare le pesanti sanzioni senza sacrificare la tua agilità tecnica.

La legge sulle AI decifrata: le regole del gioco per l’Europa

Che cos’è esattamente l’IA Act?

L’AI Act segna una svolta storica: è la prima legislazione completa al mondo concepita per fornire un quadro di riferimento per l’intelligenza artificiale. Questo regolamento dell’Unione Europea impone regole severe e chiare sia agli sviluppatori che agli utenti.

Dimentica l’idea di un divieto massiccio. Il testo mira invece a garantire un uso sicuro ed etico della tecnologia. Tutto si basa su una parola chiave: fiducia.

L’ambizione è chiara: ripetere il colpo da maestro del RGPD nel 2018 e imporre uno standard globale.

I principali obiettivi della legge

La priorità assoluta rimane la sicurezza dei nostri cittadini. Dobbiamo proteggere i nostri diritti fondamentali e blindare la democrazia contro i possibili abusi di queste potenti tecnologie.

L’Europa vuole anche costruire un mercato unico per le applicazioni “legali, sicure e affidabili”. L’idea? Fornire un quadro giuridico stabile e rassicurante per stimolare gli investimenti e l’innovazione nel vecchio continente.

L’obiettivo non è quello di frenare l’IA, ma di guidarla. Si tratta di garantire che l’uomo rimanga al posto di guida e che la tecnologia sia al servizio dei nostri valori.

Chi sono i destinatari del regolamento? Il campo di applicazione del regolamento

La legge ha un campo di applicazione molto ampio: riguarda qualsiasi soggetto che immette un sistema di intelligenza artificiale sul mercato dell’UE o il cui utilizzo ha un impatto su persone situate nell’UE.

Attenzione alla portata extraterritoriale. Non importa se la tua azienda ha sede negli Stati Uniti o in Cina. Se il tuo prodotto di intelligenza artificiale viene utilizzato in Europa, devi rispettare la legge sull’AI. Questo è un aspetto importante che molti sottovalutano.

Una chiara definizione di “sistema di intelligenza artificiale

Ufficialmente, si tratta di un sistema macchina che opera con un’autonomia variabile. Genera previsioni, contenuti o decisioni che influenzano direttamente gli ambienti reali o virtuali. Una definizione fatta su misura per il futuro.

Questa formulazione è volutamente ampia per includere le tecnologie attuali e future. Copre i diversi tipi di intelligenza artificiale che stanno emergendo ogni giorno.

L’approccio basato sul rischio: una piramide a 4 livelli

Il principio: maggiore è il rischio, più rigide sono le regole

L’Europa sta optando per un approccio pragmatico e basato sul rischio, rifiutandosi di regolamentare alla cieca. L’obiettivo è semplice: non imporre gli stessi vincoli a tutti gli algoritmi.

La logica è ovvia: un filtro anti-spam non rappresenta lo stesso potenziale danno di un software diagnostico medico difettoso. La regolamentazione è quindi strettamente proporzionale al pericolo reale per la salute, la sicurezza o i nostri diritti fondamentali.

Le quattro categorie di rischio in sintesi

Il testo distingue quattro livelli molto specifici: rischio inaccettabile, rischio elevato, rischio limitato e rischio minimo.

Questa tabella riassuntiva funge da bussola per aiutarti a non perdere la rotta. Ti permette di identificare immediatamente la categoria della tua AI e gli obblighi che ne derivano, risparmiandoti costosi grattacapi legali.

| Livello di rischio | Descrizione | Esempi concreti | Obbligo principale |

|---|---|---|---|

| Rischio inaccettabile | Minaccia diretta ai diritti e alla sicurezza individuale | Valutazione sociale da parte dei governi, manipolazione comportamentale subliminale, riconoscimento facciale in tempo reale (salvo eccezioni). | Divieto totale |

| Rischio elevato | Impatto significativo sulla sicurezza o sui diritti fondamentali | Assunzioni (selezione dei CV), diagnosi mediche, concessione di crediti, sistemi giudiziari e di polizia. | Conformità rigorosa (valutazione, documentazione, monitoraggio umano) prima della commercializzazione. |

| Rischio limitato | Rischio di inganno o di mancanza di trasparenza per l’utente | Chatbot, sistemi che generano deepfakes, assistenti vocali. | Obbligo di trasparenza (gli utenti devono sapere che stanno interagendo con un’IA). |

| Rischio minimo | Rischio minimo o nullo per i diritti o la sicurezza | Filtri antispam, videogiochi, semplici sistemi di raccomandazione. | Nessun obbligo legale (sono incoraggiati codici di condotta volontari). |

Perché questa classificazione è la chiave di volta del testo

Questo metodo permette di colpire duramente dove è veramente necessario. Evita di soffocare l’innovazione tecnica su strumenti innocui con una burocrazia cieca e controproducente.

La proporzionalità rimane la chiave per far accettare la pillola all’industria. Si tratta di un compromesso fondamentale tra la protezione dei cittadini europei e il mantenimento di una crescita economica dinamica.

Al di là dei rischi, il desiderio di armonizzazione

Senza questo testo, ogni paese avrebbe messo insieme le proprie leggi nel proprio angolo. Per le aziende, destreggiarsi tra ventisette regolamenti contraddittori sarebbe stato un vero e proprio incubo amministrativo e finanziario.

L’IA Act impone ora un unico insieme di regole per tutti gli Stati membri. Essere conformi a Parigi significa essere conformi a Berlino, un vantaggio enorme per rendere più fluido il mercato interno.

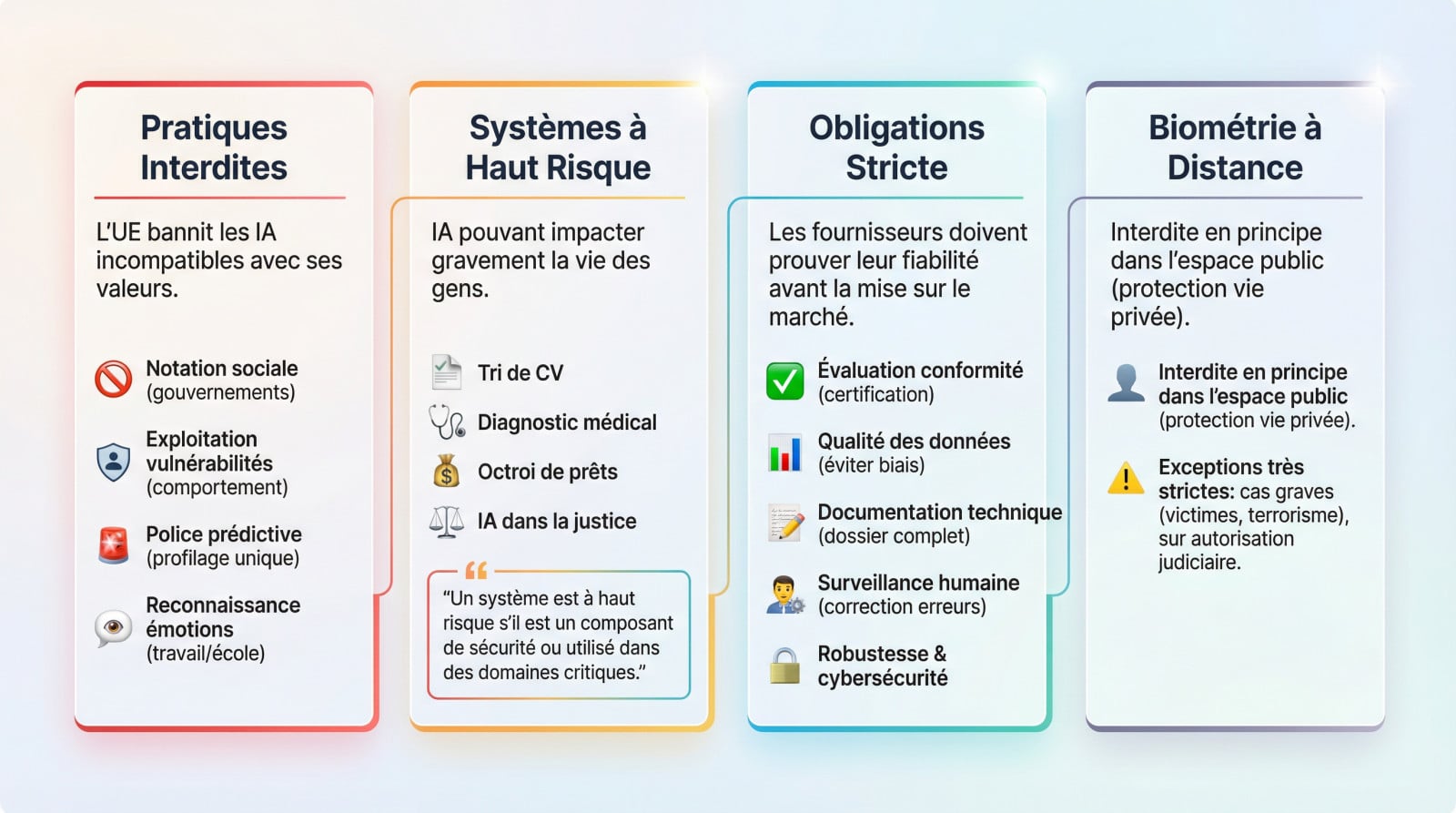

Linea rossa: pratiche vietate e sistemi ad alto rischio

Dopo aver analizzato il panorama globale, concentriamoci sul vertice della piramide legislativa. È qui che si nascondono le linee rosse assolute e i vincoli che fanno tremare gli uffici legali.

Ciò che l’Europa vieta in modo assoluto

La legge sulle AI non fa sconti su questo punto: alcune applicazioni violano i nostri valori fondamentali. Sono quindi severamente vietate sul territorio europeo. Non è possibile negoziare.

Ecco la lista nera che ogni sviluppatore deve conoscere a memoria per evitare il muro:

- Sistemi di punteggio sociale da parte dei governi, una pratica osservata in Cina.

- Un’intelligenza artificiale che manipola le vulnerabilità legate all’età o alla disabilità per modificare il comportamento.

- Sistemi di polizia predittiva basati esclusivamente sulla profilazione di un individuo.

- Riconoscimento delle emozioni utilizzato sul posto di lavoro o nelle scuole.

Che cos’è un “sistema ad alto rischio”?

I sistemi ad alto rischio sono definiti dalla loro capacità di avere un grave impatto sulle nostre vite. Non è la tecnologia a rappresentare un problema, ma il suo preciso ambito di applicazione.

Pensa al software di selezione dei CV, agli strumenti di diagnostica medica, agli algoritmi dei prestiti bancari o all’IA nel sistema giudiziario. Gli errori sono vietati.

Un sistema è ad alto rischio se è un componente di sicurezza di un prodotto o se viene utilizzato in aree critiche elencate dalla legge.

Obblighi gravosi per i sistemi sensibili

I fornitori non hanno il diritto di sbagliare e devono dimostrare l’affidabilità del loro strumento prima di immetterlo sul mercato. Si tratta di un’enorme barriera all’ingresso.

C’è una lunga e tecnica lista di compiti da completare per ottenere il via libera:

- Valutazione della conformità: far certificare il sistema dalle autorità competenti.

- Qualità dei dati: addestra l’IA su set di dati impeccabili per evitare qualsiasi pregiudizio.

- Documentazione tecnica: tieni un registro completo che spiega il funzionamento interno del sistema.

- Supervisione umana: garantire una supervisione umana in grado di intervenire e correggere le deviazioni.

- Robustezza e sicurezza informatica: garantire che il sistema sia resistente agli attacchi e resti affidabile.

Identificazione biometrica: un caso da manuale

L’Europa colpisce duro: l’identificazione biometrica a distanza e in tempo reale negli spazi pubblici è vietata di default. Si tratta di un’importante vittoria per la tutela della privacy. I tuoi volti non sono dati gratuiti. Il Grande Fratello non sparirà.

Tuttavia, la porta rimane socchiusa grazie a delle eccezioni molto severe, convalidate da un giudice. Queste includono le ricerche di vittime o di minacce terroristiche imminenti. La sicurezza a volte viene prima di tutto.

IA generativa e GPAI: un framework su misura

Si è parlato molto delle applicazioni più belle, ma il vero argomento è il motore sotto il cofano. L’AI Act non lo dimentica e dedica un intero capitolo alle enormi tecnologie che alimentano i nostri strumenti quotidiani.

I modelli di intelligenza artificiale di uso generale (GPAI) sotto i riflettori

Le GPAI (General-Purpose AI models) non sono semplici software, ma mostri di potenza. Hanno una versatilità rara, in grado di svolgere un’immensa varietà di compiti senza essere stati programmati per un’unica funzione precisa.

Li conosci già: sono gli ideatori di ChatGPT e Midjourney. Tecnologie come Google Gemini rientrano a pieno titolo in questa categoria. L ‘Europa ha deciso che questi modelli non possono più operare in totale libertà.

Trasparenza, la nuova regola d’oro

Niente più scatole nere impenetrabili. Il principale obbligo che grava sui fornitori di IAM è una trasparenza radicale, sotto forma di richiesta di documentazione tecnica concreta per dimostrare la loro buona fede.

In concreto, questo è ciò che devono mettere sul tavolo:

- Fornire una documentazione tecnica precisa che illustri le reali capacità e i limiti del modello.

- Fornisci una sintesi dei contenuti utilizzati per la formazione, senza nascondere nulla.

- Implementa una politica rigorosa per rispettare la legge europea sul copyright.

- Contrassegnare chiaramente i contenuti generati (testo, immagini, video) per indicare che sono artificiali.

Il rispetto del copyright, un punto non negoziabile

Questo è spesso il punto in cui le cose si complicano. L’AI Act richiede agli sviluppatori di GPAI di dimostrare di aver rispettato la legislazione sul copyright quando hanno raccolto i dati di addestramento su larga scala.

Non si tratta di una semplice formalità amministrativa. Devono essere in grado di mostrare un riepilogo dettagliato delle fonti protette che hanno ingerito. Per i creatori e gli editori si tratta di una piccola rivoluzione che rimette le cose in ordine.

Il caso speciale delle GPAI a “rischio sistemico

Alcuni modelli sono troppo grandi per essere ignorati. Il termine “rischio sistemico” viene utilizzato quando la potenza di calcolo cumulativa per la formazione supera una soglia critica, minacciando potenzialmente la sicurezza pubblica o i diritti fondamentali.

Per questi giganti, l’asticella è più alta. Devono effettuare valutazioni approfondite del modello, gestire attivamente i rischi, segnalare alla Commissione qualsiasi incidente grave e garantire un livello inattaccabile di sicurezza informatica.

Governance e calendario: chi guida e per quando?

La legislazione va bene sulla carta, ma chi la applicherà e quando verrà applicata? È il momento di parlare dei dettagli: la governance e il calendario di attuazione.

L'”Ufficio AI”: il nuovo cane da guardia dell’Europa

Forse non ne hai ancora sentito parlare, ma l’Ufficio Europeo per l’AI sta rapidamente diventando una forza da non sottovalutare. Situata nel cuore della Commissione Europea, questa nuova struttura agisce come un vero e proprio direttore d’orchestra della regolamentazione.

La sua missione è tutt’altro che simbolica. Questo ufficio supervisiona direttamente l’applicazione delle regole per i modelli di uso generale (GPAI), coordina le autorità nazionali e contribuisce attivamente allo sviluppo di standard tecnici.

Fornitori e distributori: chi fa cosa?

Non confondere i ruoli: potrebbe essere un errore costoso. Il fornitore è l’architetto: l’entità che sviluppa il sistema o lo immette sul mercato. È quindi sulle sue spalle che ricade la maggior parte degli obblighi di conformità.

Dall’altra parte c’è il deployer. Si tratta dell’azienda o dell’autorità pubblica che utilizza un sistema di IA, in particolare un sistema ad alto rischio, in un contesto professionale. La loro responsabilità? Garantire un’adeguata supervisione umana e un utilizzo conforme alle istruzioni.

Calendario di attuazione: un’introduzione graduale

Pensi di avere tempo? Ripensaci. Sebbene la legge non entri in vigore all’improvviso, la sua applicazione segue un calendario preciso e graduale. L’obiettivo è quello di dare ai giocatori una finestra di opportunità per adattarsi, ma questa finestra si sta chiudendo rapidamente.

Tieni a mente queste scadenze: i primi divieti entreranno in vigore nel 2024 e all’inizio del 2025. Poi, le regole più severe per gli IPSM si applicheranno a metà del 2025. Infine, il grosso del lavoro, riguardante i sistemi ad alto rischio, entrerà pienamente in vigore tra il 2026 e il 2027.

E le sanzioni?

Bruxelles non vuole giocare d’anticipo. Il regolamento prevede per i regolatori ingenti sanzioni finanziarie per punire la mancata conformità. Si tratta di importi in grado di destabilizzare una struttura finanziariamente solida.

La logica ricorda quella del RGPD, ma è più incisiva. Le multe possono raggiungere il 7% del fatturato mondiale o 35 milioni di euro. Si tratta di un deterrente formidabile che nessuno dovrebbe ignorare.

IA Act e RGPD: il binomio vincente per la compliance

Infine, affrontiamo una domanda che molte aziende si stanno ponendo: come si concilia questo nuovo testo con il famoso RGPD? Spoiler: sono destinati a lavorare insieme.

No, la legge sull’AI non sostituisce il RGPD.

Spesso sentiamo questa confusione, ma mettiamo subito le cose in chiaro: l’IA Act e il RGPD (Regolamento Generale sulla Protezione dei Dati) sono due leggi complementari. Una non esclude l’altra, questo è un dato di fatto.

È molto semplice: il GDPR protegge i dati personali delle persone, mentre l’AI Act regolamenta la sicurezza e l’affidabilità dei prodotti e dei servizi di IA.

Se un sistema di intelligenza artificiale tratta dati personali, dovrà rispettare entrambe le normative. Il rispetto di una di esse non esonera dal rispetto dell’altra.

In che modo la legge sulle AI rafforza i requisiti del RGPD

Vedi il link? Il lavoro di documentazione richiesto dall’IA Act per i sistemi ad alto rischio è un valido aiuto per la conformità al RGPD. Non stiamo partendo da zero.

In termini pratici, la documentazione sulla qualità dei dati e sul bias testing può confluire direttamente nella Valutazione d’Impatto sulla Protezione dei Dati (DPIA), obbligatoria ai sensi del RGPD.

Sandbox regolamentari” per l’innovazione senza rischi

Ecco un’opportunità da non perdere. Le sandbox regolamentari sono ambienti controllati istituiti dalle autorità per effettuare test senza il timore immediato di essere puniti. Questa è una delle buone idee del testo.

Il loro obiettivo è chiaro: consentire alle aziende, in particolare alle PMI e alle start-up, di testare le loro IA innovative sotto la supervisione delle autorità, per assicurarsi che siano conformi prima di un lancio ufficiale.

Prepararsi alla conformità: un duplice ruolo obbligatorio

Non commettere l’errore di compartimentare i tuoi team. Le aziende devono pensare alla loro strategia di conformità da due punti di vista: la protezione dei dati (RGPD) e l’affidabilità del sistema (IA Act).

Per le applicazioni pratiche, questo significa che il progetto del tuo prossimo chatbot AI conversazionale dovrà incorporare queste due dimensioni fin dall’inizio.

L’IA Act segna una svolta decisiva: l’Europa non sta cercando di frenare l’innovazione, ma di offrirle un solido quadro di fiducia. Per le aziende, la conformità sta diventando un vero e proprio vantaggio competitivo. Allora, sei pronto a raccogliere la sfida? È meglio iniziare a pianificare ora, perché vista l’entità delle multe, il conto potrebbe essere salato.

DOMANDE FREQUENTI

Che cos’è esattamente la legge sull’AI?

In parole povere, si tratta della prima legge al mondo che regolamenta l’intelligenza artificiale. Guidata dall’Unione Europea, questa normativa non mira a vietare la tecnologia, ma a stabilire chiare regole di base. L’idea è quella di classificare l’intelligenza artificiale in base alla sua pericolosità: maggiore è il rischio per i cittadini, maggiori sono i vincoli. È un po’ come il “codice della strada” per gli algoritmi, per garantire la nostra sicurezza e i nostri diritti.

Quando entrerà in vigore questa legge?

Non si tratta di un “big bang” immediato, ma piuttosto di un’implementazione graduale per dare a tutti il tempo di adattarsi. Le pratiche totalmente proibite (le linee rosse) saranno vietate a partire dal 2024. Le regole sull’IA generativa (come i modelli alla base di ChatGPT) arriveranno nel 2025. Infine, la maggior parte delle regole riguardanti i sistemi ad alto rischio sarà pienamente applicabile intorno al 2026 o 2027.

Quali sono i livelli di rischio definiti dalla legge sulle AI?

L’Europa ha scelto un approccio piramidale molto pragmatico. Ci sono quattro livelli principali: rischio inaccettabile (sistemi vietati, come il social rating), rischio elevato (strettamente regolamentato, ad esempio per la salute o la giustizia), rischio limitato (che richiede solo trasparenza, come per i chatbot) e infine rischio minimo (nessun vincolo, per i filtri antispam o i videogiochi).

Chi c’è dietro l’adozione della legge sull’AI?

Si tratta di un’iniziativa dell’Unione Europea. Il testo è stato discusso e adottato dalle istituzioni europee (Parlamento e Consiglio) in modo da poter essere applicato uniformemente in tutti i 27 Stati membri. Un piccolo ma importante dettaglio: grazie alla sua portata extraterritoriale, non importa se l’azienda è americana o cinese, è l’UE che impone le sue regole non appena il sistema viene utilizzato sul territorio europeo.

Cosa si intende per “deployeur” nel testo?

Attenzione alle sfumature! Il “deployer” non è la persona che codifica l’IA (quello è il fornitore), ma l’entità che la utilizza in un contesto professionale. Se la tua azienda installa un software di intelligenza artificiale per smistare i CV, è considerata un “deployer”. In quanto tale, ha responsabilità specifiche, come ad esempio garantire che un umano tenga d’occhio le decisioni della macchina.

Cosa significa la parola “Atto” in questo contesto?

È semplicemente il termine legale inglese per indicare una “legge”. In francese si parla di “Règlement sur l’Intelligence Artificielle”, ma il nome “AI Act” è rimasto nel linguaggio comune, anche qui in Francia. È più breve e suona un po’ più moderno, a dire il vero.

Quali sono le sanzioni per chi infrange le regole?

L’Europa fa sul serio per quanto riguarda la conformità. Come abbiamo visto con il RGPD, le sanzioni sono pensate per essere dissuasive. L’AI Act prevede multe amministrative molto pesanti che possono rappresentare una percentuale significativa del fatturato globale dell’azienda inadempiente. Quindi è meglio fare sul serio adesso.