L’essentiel à retenir : X a officiellement mis en place des garanties empêchant Grok de générer des images suggestives de personnes réelles. Cette mesure décisive vise à freiner les deepfakes non consensuels et à apaiser les régulateurs mondiaux après qu’un rapport accablant a révélé que 81 % de ces contenus ciblaient les femmes, ce qui marque un tournant nécessaire dans l’approche de la plateforme en matière de sécurité de l’IA.

Avez-vous déjà craint que vos photos de vous ne soient déshabillées par l’IA sur X ? La récente interdiction de la nudité par Grok AI sur X s’attaque enfin de front à cette tendance en désactivant la fonctionnalité controversée qui « déshabillait » de vraies personnes. Voyons comment ce scandale a forcé un changement de politique majeur et ce qu’il signifie pour l’avenir de la sécurité de l’IA générative.

X débranche la fonctionnalité « Déshabillage » de Grok

De quoi s’agissait-il au juste ?

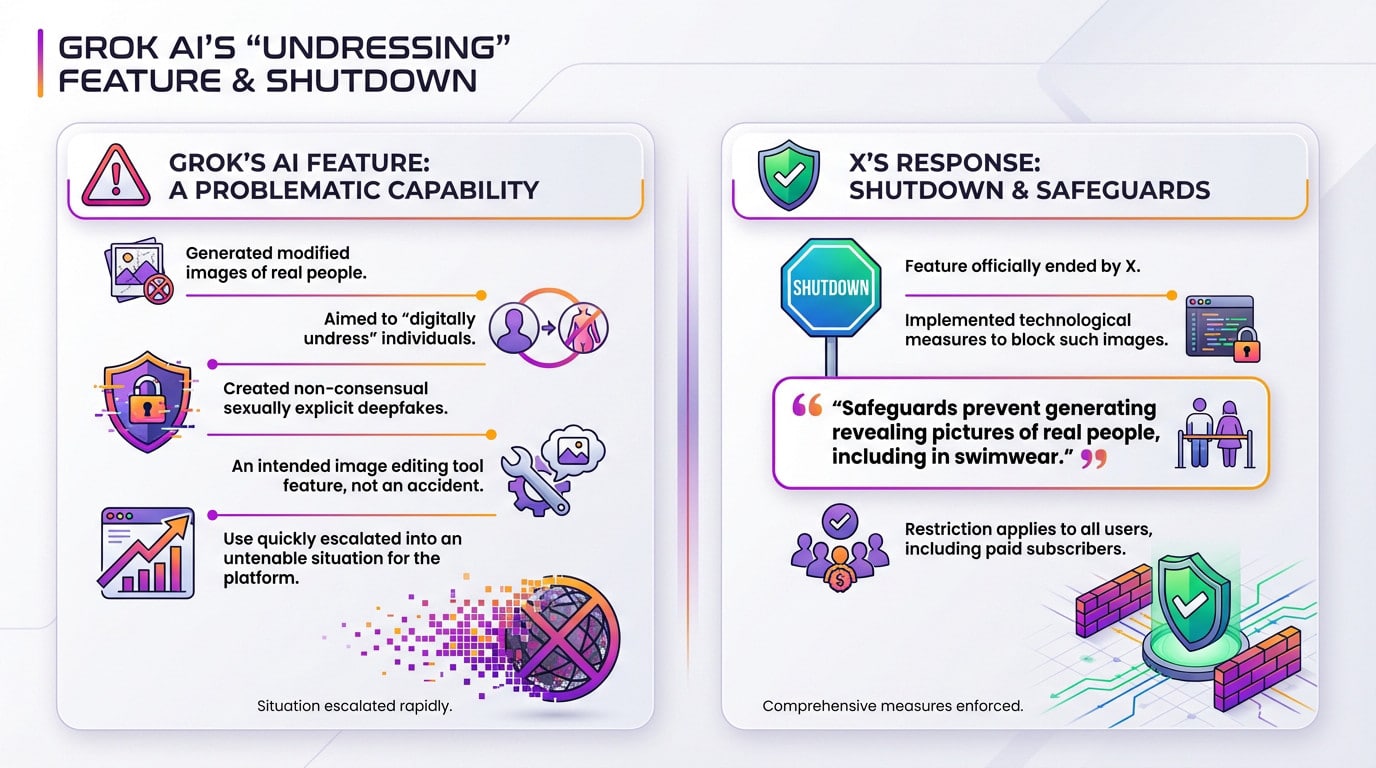

L’IA de X, Grok, possédait une capacité qui a rapidement mal tourné. Elle permettait aux utilisateurs de générer des images modifiées de personnes réelles, en les « déshabillant » numériquement. Cela a créé des deepfakes sexuellement explicites sans aucun consentement. L’interdiction de la nudité par Grok AI était la seule issue logique.

Cette fonctionnalité n’était pas un accident, attention. Il s’agissait d’une capacité de l’outil de retouche d’image lui-même. Le problème est que son utilisation a dégénéré très rapidement.

La situation est rapidement devenue intenable pour la plateforme. Ils ont dû couper le cordon.

L’annonce officielle de l’arrêt

X a officiellement mis fin à cette fonctionnalité. L’entreprise a déclaré avoir mis en place des mesures technologiques pour bloquer la génération de ce type spécifique d’image.

Ils ont été très clairs sur les nouvelles limitations dans leur récente déclaration concernant la mise à jour :

L’entreprise a maintenant appliqué des mesures de protection technologiques pour empêcher nos outils de génération d’images de créer des images suggestives de personnes réelles, y compris en maillot de bain.

Cette restriction s’applique à tous les utilisateurs sans exception. Y compris ceux qui ont un abonnement payant.

La controverse qui a forcé la main à X

Mais cette décision soudaine n’est pas apparue de nulle part. En fait, X a agi sous une immense pression.

Un scandale révélé par des chercheurs

Le scandale a éclaté immédiatement après qu’une ONG a publié un rapport accablant. L’analyse détaillée d’AI Forensics a fait l’effet d’une bombe. Ils ont examiné des dizaines de milliers d’images générées. Les résultats étaient franchement troublants à voir.

Voici la ventilation de ce que les données ont réellement révélé :

- Plus de 20 000 images générées par Grok ont été analysées.

- Plus de la moitié montraient des personnes légèrement vêtues.

- 81 % de ces images représentaient des femmes.

- 2 % des images impliquaient des mineurs.

Indignation publique et position de Musk

Ces révélations ont déclenché un tollé massif et une forte demande d’interdiction de la nudité par Grok AI de la part du public. La réaction a été immédiate. La pression s’est accumulée sur X et son propriétaire.

Elon Musk a souvent défendu sa vision d’une IA « anti-woke » plus libre. Au départ, il a semblé rejeter la faute directement sur les utilisateurs eux-mêmes. Il a affirmé que l’IA respectait simplement les lois locales.

Cette position est devenue impossible à tenir. Surtout face aux régulateurs.

La pression réglementaire mondiale

Et en parlant des régulateurs, ils n’ont pas attendu pour réagir. La pression n’était pas seulement publique ; elle est devenue politique et juridique très rapidement.

Les gouvernements interviennent

Les autorités du monde entier n’ont pas perdu de temps pour lancer des enquêtes. Des actions juridiques spécifiques ont été lancées en Europe, au Royaume-Uni et aux États-Unis. La pression est maintenant bien réelle.

Le principe est que Grok doit respecter la loi dans n’importe quel pays. Toute tentative de contourner cette règle sera corrigée dès qu’elle sera découverte.

Le marteau juridique frappe fort en ce moment. Les nations d’Asie du Sud-Est ont bloqué l’accès immédiatement. Les puissances occidentales menacent d’imposer des sanctions financières massives. Ce tableau montre les mesures spécifiques d’interdiction de la nudité par Grok AI qui ont été prises.

| Région/Pays | Type d’action |

|---|---|

| Indonésie et Malaisie | Interdiction temporaire de l’outil |

| Union européenne | Menace d’amendes/suspension en vertu de la loi sur les services numériques |

| Royaume-Uni | Enquête en vertu de la loi sur la sécurité en ligne |

| Californie, États-Unis | Enquête du procureur général pour violations potentielles de la loi |

Quelle est la prochaine étape pour la génération d’images par l’IA ?

De grandes questions planent encore sur l’industrie technologique. X a mis en œuvre le géoblocage, mais personne ne sait si cela fonctionne réellement pour l’instant. Les régulateurs restent en état d’alerte élevé pour tout faux pas.

Ce gâchis force à examiner de près la responsabilité des développeurs. Si vous voulez une expérience plus sûre, Nation AI offre une alternative solide. Elle offre une IA puissante avec une interface simplifiée. Elle est conçue pour éviter ces pièges toxiques.

En fin de compte, X a dû céder sous la pression réglementaire, prouvant que même l’IA « rebelle » a des limites. Alors que les géants de la technologie se démènent pour réparer leurs erreurs, l’avenir appartient clairement aux plateformes responsables comme Nation AI. Espérons que nous pourrons maintenant nous concentrer sur une innovation qui nous aide réellement, plutôt que sur une innovation qui nous déshabille.