L’essentiel à retenir : le terme « Dark GPT » regroupe des IA dépourvues de filtres éthiques, allant d’arnaques marketing à de véritables armes cybercriminelles comme FraudGPT. En facilitant la création de malwares et le phishing ciblé, ces outils démocratisent la cyberattaque. Une compréhension claire de ces risques reste le meilleur rempart pour renforcer sa sécurité numérique face à ces menaces automatisées.

Est-ce que la rumeur d’un Dark GPT capable de pirater vos données en quelques secondes vous donne des sueurs froides ? Nous allons démêler le vrai du faux sur ces intelligences artificielles malveillantes, en distinguant les simples arnaques marketing des véritables outils utilisés par les cybercriminels. Restez avec nous pour comprendre comment ces modèles opèrent réellement et découvrez les parades indispensables pour ne pas devenir la prochaine cible de ces algorithmes débridés.

Démystifier le terme Dark GPT : de quoi parle-t-on vraiment ?

Plus qu’une seule définition

« Dark GPT » n’est pas un produit unique, mais un terme fourre-tout souvent mal compris. Il désigne globalement une IA fonctionnant sans les garde-fous éthiques habituels, ce qui crée une énorme confusion.

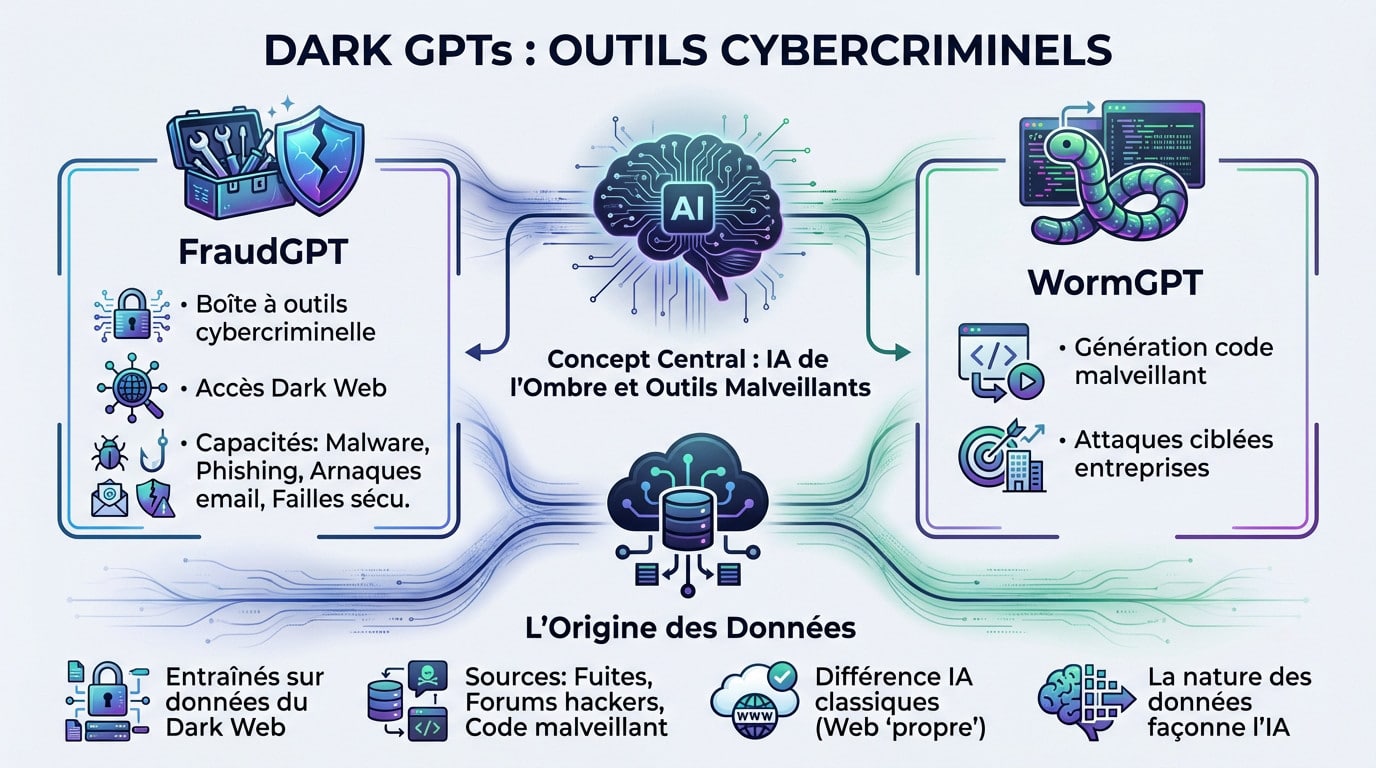

Trois grandes familles se cachent derrière ce nom. D’un côté, les véritables outils de cybercriminalité comme WormGPT. De l’autre, les versions « débridées » d’IA grand public. Et enfin, les produits commerciaux au marketing agressif comme FraudGPT, vendus sur le dark web.

Il est indispensable de les différencier pour saisir les véritables enjeux et les dangers.

La différence avec les ia grand public

Mettez cela en opposition directe avec ChatGPT ou Google Gemini. La distinction fondamentale réside dans l’absence totale de filtres de contenu et de restrictions éthiques.

Les entreprises comme OpenAI investissent massivement pour brider leurs IA et empêcher les dérives. Les Dark GPT, eux, sont conçus précisément pour ignorer ou contourner ces barrières, un processus parfois appelé « jailbreak ».

Cette absence de limites est ce qui les rend à la fois séduisants pour certains et extrêmement dangereux.

Les vrais Dark GPT : les outils des cybercriminels

Vous pensez que l’intelligence artificielle se limite à rédiger des poèmes ou à résumer des réunions ? Détrompez-vous. Une menace bien plus insidieuse grandit dans l’ombre des réseaux chiffrés. Les Dark GPT ne sont pas de simples anomalies ou des versions « débridées » par des adolescents curieux ; ce sont des armes de guerre numérique, calibrées pour l’attaque. Contrairement aux modèles grand public bridés par des garde-fous éthiques, ces IA opèrent en roue libre, sans conscience ni morale.

Le danger est réel et immédiat. Ces outils permettent à n’importe quel novice de lancer des cyberattaques d’une sophistication terrifiante, autrefois réservées à des experts chevronnés. Ils exploitent des données volées pour maximiser les dégâts, transformant la cybercriminalité en une industrie automatisée et accessible sur abonnement. Les implications éthiques sont vertigineuses : nous faisons face à une technologie capable d’amplifier le chaos à une échelle industrielle. Si vous ne prenez pas la mesure de cette évolution, vos systèmes de défense risquent d’être obsolètes avant même d’avoir détecté l’intrusion.

Maintenant que la distinction est plus claire, penchons-nous sur la catégorie la plus inquiétante : les IA conçues spécifiquement pour nuire.

FraudGPT et WormGPT, les fers de lance

FraudGPT s’impose aujourd’hui comme la référence absolue de cette mouvance souterraine. Vendu exclusivement sur les marchés noirs du dark web, il se présente comme une trousse à outils exhaustive pour tout cybercriminel qui se respecte.

Ses capacités techniques sont tout simplement effrayantes : rédaction de malwares complexes et génération de pages de phishing indétectables. Il conçoit des arnaques par email d’un réalisme bluffant tout en scannant activement vos réseaux pour y déceler des failles de sécurité. C’est le vrai visage de l’IA malveillante.

Son binôme, WormGPT, se focalise quant à lui sur la génération de codes malveillants pour des attaques ciblées.

L’origine des données : le dark web comme terrain d’entraînement

La puissance de frappe de ces modèles réside dans la source même de leur apprentissage. Leur efficacité redoutable vient du fait qu’elles sont entraînées sur des données issues du dark web : fuites massives, discussions de forums pirates et vastes bases de code malveillant.

On est loin des IA classiques éduquées sur la littérature ou le web « propre » et régulé. Ici, la nature toxique des données d’entraînement détermine directement la vocation offensive et nuisible de l’intelligence artificielle finale.

C’est ce qui les différencie radicalement d’un simple chatbot IA conversationnelle conçu pour le service client.

Les « faux » Dark GPT : entre marketing et contournement

Mais tous les « Dark GPT » ne sont pas des armes de cyberguerre. D’autres sont bien plus inoffensifs, voire relèvent de l’arnaque marketing.

Les promesses marketing des versions « sans limites »

Des produits s’affichent comme des « Dark GPT » sur le web. C’est un argument marketing pour vendre une IA prétendument « sans censure ». Ils cherchent à attirer les frustrés des modèles classiques.

La réalité derrière la façade est souvent bien différente. Ces services ont une réputation désastreuse. Les avis Trustpilot très bas signalent des problèmes de facturation récurrents et des prélèvements abusifs. La qualité technique est souvent médiocre.

La méfiance est de mise face à ces promesses. Gardez votre argent.

Le « jailbreak » : forcer l’IA à désobéir

Le « jailbreak » se définit de manière simple. Il s’agit d’utiliser des prompts astucieux. On amène une IA standard comme ChatGPT à contourner ses propres règles de sécurité.

C’est un jeu du chat et de la souris. Les développeurs corrigent constamment ces failles techniques.

Pour naviguer sans risque, il faut impérativement distinguer les véritables outils criminels des simples astuces de contournement ou des pièges commerciaux, comme le détaille ce tableau comparatif des risques et objectifs pour chaque type.

| Type de Dark GPT | Objectif Principal | Accès | Risque Associé |

|---|---|---|---|

| Dark GPT Malveillant | Cybercriminalité (fraude, malware) | Dark web, forums spécialisés | Élevé (illégal, dangereux) |

| Dark GPT Commercial | Marketing (vendre une IA « sans censure ») | Sites web publics, souvent payants | Moyen (escroqueries, service de mauvaise qualité, problèmes de facturation) |

| Dark GPT (Jailbreak/Persona) | Contourner les filtres d’une IA légitime | Via des prompts spécifiques sur des plateformes comme ChatGPT | Faible à Moyen (violation des conditions d’utilisation, génération de contenu inapproprié) |

Les risques concrets et comment s’en protéger

On imagine souvent le piratage comme l’œuvre de génies encapuchonnés tapant des lignes de code vertes dans une cave sombre. Faux. Avec l’émergence de modèles comme FraudGPT ou WormGPT, la cybercriminalité s’est totalement « ubérisée ». N’importe qui, avec quelques dollars en poche, peut désormais générer des attaques d’une sophistication effrayante sans rien connaître au code. C’est là que le bât blesse : la barrière technique a sauté. Nous ne parlons pas de scénarios de science-fiction, mais d’une réalité immédiate où votre identité numérique est constamment dans le viseur. Ces IA sans filtre, nourries aux données du dark web, ne s’embarrassent pas d’éthique ni de morale. Elles exécutent, point final. Si vous pensez être à l’abri parce que vous n’êtes pas une multinationale, détrompez-vous. Les cibles, c’est nous tous. Qu’il soit un outil criminel ou une simple astuce, le phénomène Dark GPT soulève de vraies questions de sécurité. Voyons les menaces concrètes et, surtout, comment ne pas en devenir une victime.

Les menaces à ne pas sous-estimer

Oubliez la théorie ou les scénarios lointains. Ces dangers ne sont pas théoriques, ils sont déjà bien réels et en action.

- Phishing et fraude par IA : Création d’emails et de messages d’escroquerie ultra-personnalisés et crédibles.

- Désinformation et deepfakes : Génération massive de fausses nouvelles, de fausses images ou de fausses vidéos pour nuire ou manipuler l’opinion.

- Développement de logiciels malveillants : Assistance à la création de virus et autres codes malicieux, même pour des pirates peu expérimentés.

Le vrai problème réside dans l’accès facilité. Ces IA abaissent drastiquement le niveau de compétence requis pour lancer des cyberattaques sophistiquées. C’est ça, le vrai changement.

Quelques réflexes de base pour votre sécurité

On ne peut pas empêcher ces outils d’exister, c’est un fait. Par contre, on peut adopter une meilleure hygiène numérique pour devenir une cible bien plus difficile.

- Vérifiez toujours la source : Soyez sceptique face aux emails, messages ou offres inattendus, même s’ils semblent bien écrits.

- Utilisez une sécurité robuste : Mots de passe complexes, uniques et authentification à deux facteurs (2FA) sont vos meilleurs alliés.

- Limitez votre empreinte numérique : Moins vous partagez d’informations publiquement, moins les agents IA malveillants ont de matière pour vous cibler.

Ne baissez jamais la garde face à l’écran. La vigilance et le bon sens restent les meilleures armes de défense.

Au fond, le terme Dark GPT désigne autant de redoutables outils de piratage que de simples leurres marketing. L’IA n’est qu’un amplificateur d’intentions, bonnes ou mauvaises. Face à cette nouvelle donne, ne cédez pas à la panique : votre esprit critique et une bonne hygiène numérique. Gardez l’œil ouvert