En bref : L ‘intelligence artificielle générale (AGI) reste un objectif théorique distinct des outils d’IA « étroits » d’aujourd’hui. Alors que les modèles actuels excellent dans des schémas spécifiques, une véritable IAG posséderait la capacité, semblable à celle d’un être humain, de généraliser ses connaissances dans n’importe quel domaine sans formation préalable. La compréhension de cette énorme lacune explique pourquoi, malgré des chatbots impressionnants, une machine capable de faire preuve d’un véritable bon sens reste le Saint-Graal de l’industrie.

Vous sentez-vous dépassé par les gros titres qui prédisent sans cesse l’apocalypse des robots, alors que vos propres appareils intelligents peinent encore à comprendre les commandes vocales les plus simples ? Vous cherchez probablement à savoir ce qu’est l’agi, car l’essor soudain des outils génératifs a brouillé la frontière entre une calculatrice intelligente et une machine qui pense vraiment comme un humain. Nous allons vous expliquer pourquoi l’intelligence artificielle générale reste le Saint-Graal théorique après lequel courent les géants de la technologie, et pourquoi elle est complètement différente des logiciels que nous utilisons aujourd’hui.

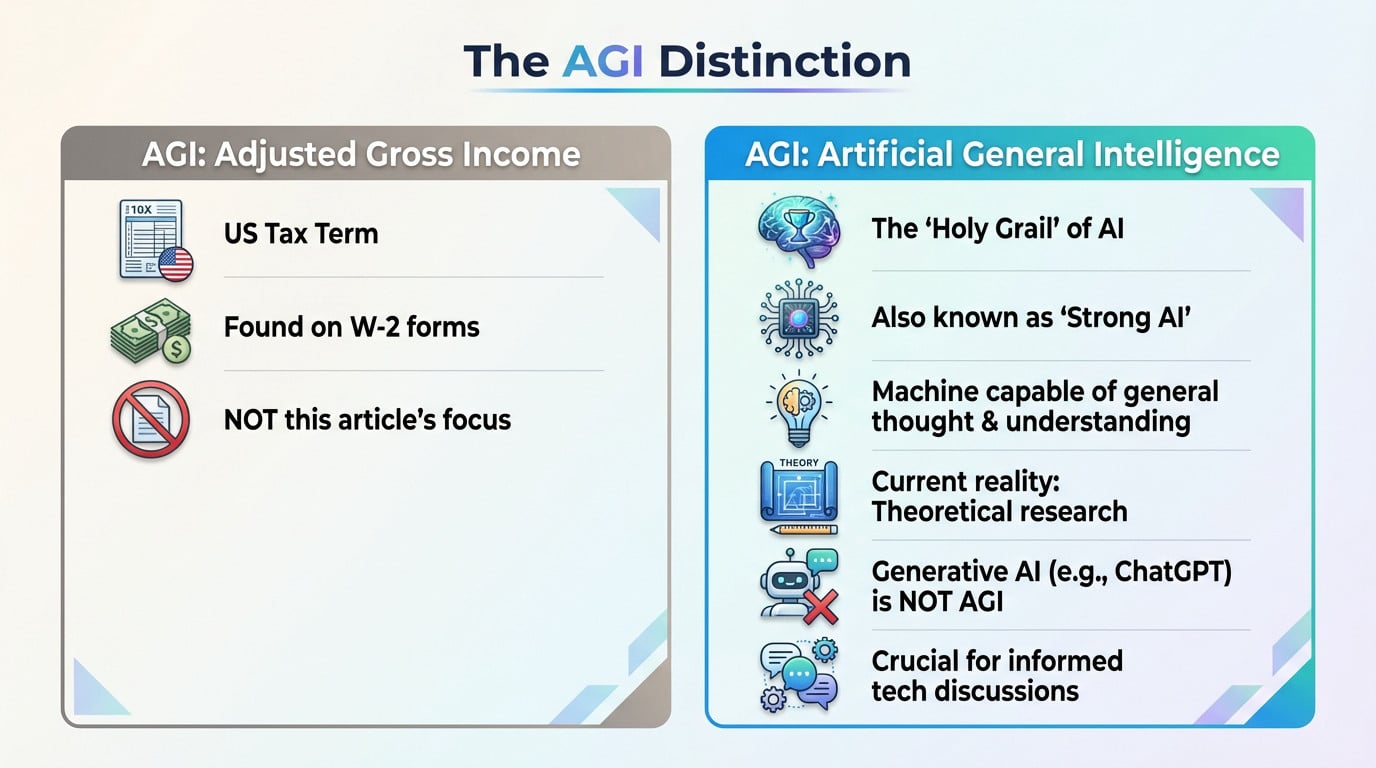

L’histoire de deux AGI : Dissiper la confusion d’abord

Mélange d’acronymes : IA vs. impôts

Vous vous grattez peut-être la tête en ce moment. C’est le cas parce que le terme « AGI » recouvre deux concepts radicalement différents. L’un détermine votre facture fiscale annuelle, tandis que l’autre vise à reproduire l’esprit humain.

Dans le monde de la finance, AGI signifie Adjusted Gross Income (revenu brut ajusté). Il s’agit du chiffre crucial de votre formulaire 1040 de l’IRS – en particulier la ligne 11 – calculé en prenant votre revenu total et en soustrayant les déductions telles que les intérêts des prêts étudiants. Il s’agit d’une mesure purement financière.

Mais écoutez, cet article ne traite pas de l’IRS. Nous nous concentrons strictement sur l’autre définition : le Saint-Graal technologique.

Préparer le terrain pour l’intelligence artificielle générale

Qu’est-ce que l’agi dans la sphère technologique ? Il s’agit de l’intelligence générale artificielle. Considérez-la comme le « Saint Graal » théorique de l’informatique : un système capable d’apprendre n’importe quelle tâche intellectuelle qu’un être humain peut accomplir.

Les experts parlent souvent d' »IA forte ». Nous ne parlons pas ici d’une calculatrice, mais d’une machine qui ne se contente pas d’exécuter du code, mais qui « pense » et généralise ses connaissances dans différents domaines.

Restez dans les parages, car nous devons décortiquer exactement ce que cette capacité implique pour nous.

Pourquoi cette distinction est plus importante que jamais

L’explosion des outils d’IA générative tels que ChatGPT a propulsé ce terme sous les feux de la rampe. Soudain, tout le monde pense que nous sommes arrivés à la ligne d’arrivée, ce qui crée un dangereux brouillard de confusion entre les outils avancés et les véritables machines pensantes.

Comprendre cette différence est le seul moyen d’avoir une conversation intelligente sur notre avenir. Prendre les chatbots actuels pour de véritables intelligences autonomes est un piège que vous devez éviter si vous voulez rester crédible.

Soyons clairs : ce dont nous disposons aujourd’hui est impressionnant, mais ce n’est pas l’AGI. Il s’en faut de beaucoup . Et il s’agit de comprendre pourquoi.

Les promesses et le battage médiatique

Atteindre ce niveau de cognition est la mission à long terme déclarée de géants comme OpenAI et Google DeepMind. C’est la force motrice qui sous-tend les milliards de dollars de dépenses actuelles en recherche et développement.

Bien que cela ressemble à de la pure science-fiction, il s’agit d’un domaine actif de recherche théorique. J’insiste sur le terme « théorique » car, malgré le battage médiatique, nous n’avons pas encore percé le code du raisonnement flexible au niveau humain. Il s’agit toujours d’une recherche académique.

Pour bien saisir l’enjeu de cette course, il faut d’abord définir exactement ce que nous essayons de construire.

Qu’est-ce que l’intelligence artificielle générale ?

L’idée maîtresse : Une IA capable de faire tout ce que vous pouvez faire

Faisons la part des choses. Qu’est-ce que l’AGI au juste ? Il s’agit d’une machine théorique dotée de véritables capacités cognitives de niveau humain. En gros, elle pourrait apprendre et exécuter n’importe quelle tâche intellectuelle que vous ou moi sommes capables de réaliser sans transpirer.

Et c’est là que le bât blesse. Il le fait sans formation préalable spécifique pour chaque nouvelle tâche. La partie « générale » est la seule chose qui compte vraiment ici.

Pensez-y de la manière suivante. La technologie actuelle n’est qu’un tournevis spécialisé, tandis que l’AGI est le couteau suisse par excellence.

Un contraste saisissant avec l’IA étroite

Prenons maintenant l’IA étroite, souvent appelée IA faible. Elle représente 99,9 % de ce que nous utilisons aujourd’hui. Ces systèmes sont conçus pour une tâche unique et solitaire. Ils ne gèrent que des tâches telles que la reconnaissance d’images ou la traduction.

Vous voyez la limite ? Une IA qui génère de superbes images ne peut pas écrire une seule ligne de code. Elle ne peut certainement pas analyser des données financières complexes. Elle reste complètement bloquée dans son domaine d’apprentissage d’origine.

Même les modèles génératifs avancés ne sont que de l’IA étroite. Ils sont polyvalents, certes, mais ils restent limités.

Au-delà de l’appariement des formes : une véritable compréhension

L’AGI va bien au-delà de la simple correspondance de modèles. Elle implique une forme profonde de compréhension du contexte et de logique. Il s’agit en fait de raisonner à travers les problèmes au lieu de simplement deviner le mot suivant.

L’objectif ultime n’est pas seulement d’effectuer des tâches, mais de comprendre et d’apprendre toutes les tâches intellectuelles qu’un humain peut accomplir, sans être explicitement programmé pour chacune d’entre elles.

C’est la différence entre réciter un livre et le comprendre vraiment. C’est le fossé.

La capacité à généraliser : Le Saint Graal

La généralisation est la principale caractéristique de l’AGI. Il s’agit de la capacité à transférer des connaissances d’un domaine à un autre complètement différent. Elle prend les compétences de A et les applique à B.

Les humains le font constamment. Apprendre à faire du vélo vous aidera plus tard à apprendre à faire de la moto. Une IAG devrait établir des liens cognitifs similaires.

C’est précisément ce que les IA actuelles ne peuvent pas faire. Elles échouent sur ce point.

Les éléments constitutifs d’une machine à penser

Plus qu’une simple calculatrice puissante

Il est facile de tomber dans le piège de penser que l’AGI se résume à la vitesse de traitement brute, mais c’est passer complètement à côté de l’essentiel. La véritable intelligence ne consiste pas à calculer des chiffres plus rapidement, mais à disposer de capacités cognitives qualitatives qui s’adaptent au chaos. Nous ne cherchons pas une meilleure calculatrice, mais un esprit qui comprend réellement le contexte.

Pour répondre véritablement à la question de savoir ce qu’est l’agi, nous devons examiner les caractéristiques humaines spécifiques que nous essayons de refléter. Il s’agit du raisonnement, de la planification, de la résolution de problèmes complexes et de la pensée abstraite. Il s’agit de la capacité à apprendre rapidement à partir de presque rien, sans se contenter de régurgiter les données qui lui ont été transmises au cours de l’entraînement.

La boîte à outils cognitive de base d’une AGI

Qu’y a-t-il exactement dans la boîte ? Les chercheurs ne s’entendent pas sur les caractéristiques spécifiques, mais il existe un consensus général sur le « kit de démarrage » nécessaire pour qu’une machine puisse penser. Il ne s’agit pas d’une liste exhaustive, mais sans ces outils, vous ne ferez que construire un chatbot fantaisiste.

Voici ce que les experts considèrent comme non négociable pour qu’un système puisse prétendre à l’intelligence générale :

- Raisonnement et résolution de problèmes: Capacité à élaborer des stratégies, à planifier et à penser de manière abstraite pour résoudre des problèmes peu familiers.

- Représentation des connaissances: Construction d’un modèle interne riche du monde, y compris le sens commun et les normes sociales.

- Apprendre par l’expérience : Acquérir rapidement de nouvelles compétences et connaissances à partir de petites quantités de données, comme le font les humains.

- Compréhension du langage naturel : Il ne s’agit pas simplement de traiter du texte, mais de saisir véritablement les nuances, le contexte et le sous-texte de la communication.

- Créativité: La capacité à générer des idées ou des objets nouveaux et utiles.

Le bon sens : L’ingrédient manquant

Voici l’essentiel : le bon sens est incroyablement difficile à coder, mais il est le ciment de l’intelligence. Il s’agit de cette connaissance implicite que nous possédons tous, comme le fait de savoir que l’eau mouille les choses ou que l’on ne peut pas être à deux endroits à la fois. Les machines ne « comprennent » pas ces choses naturellement.

Les modèles d’IA actuels échouent lourdement sur ce point. Si vous interrogez un système sur des objets physiques, il peut vous répondre en toute confiance que quelque chose est logiquement possible, mais totalement absurde dans la réalité. Il est complètement déconnecté des règles physiques qui régissent notre vie.

En d’autres termes, sans cet ancrage dans la réalité, il n’y a pas d’intelligence « générale ». Nous n’avons qu’un perroquet très cher.

Conscience de soi et conscience : La dernière frontière ?

Nous nous heurtons maintenant à un mur philosophique. Une machine doit-elle être éveillée pour être intelligente? Il s’agit d’un vaste débat. Certains affirment qu’une IAG doit « sentir » pour être générale, tandis que d’autres affirment que seules les performances comptent.

Nous devons séparer l’intelligence – les problèmes de résolution – de la conscience, qui est l’expérience subjective. La plupart des chercheurs s’intéressent à la première parce que, franchement, la seconde est un mystère que même les neuroscientifiques n’ont pas encore percé.

Comment le saurions-nous ? Les épreuves décisives de l’AGI

Définir ce qu’est l’agi est une bonne chose pour les manuels, mais comment prouver qu’une machine a atteint ce niveau sans se contenter de la croire sur parole ?

Le classique : Le test de Turing

Vous avez sans doute entendu parler du test de Turing, l’épreuve la plus célèbre de l’histoire. Le principe en est faussement simple : si un juge humain a une conversation avec une machine et un autre humain, peut-il dire lequel est l’autre ?

Mais voici le problème que pose cette norme aujourd’hui. Les LLM modernes peuvent « réussir » ce test simplement en étant des imitateurs de classe mondiale, prédisant le mot suivant sans comprendre la moindre chose de ce qu’ils disent.

Le test de Turing mesure la capacité à tromper et non la véritable intelligence.

Des critères de référence plus modernes (et plus pratiques)

Puisqu’il devient trop facile de tromper un juge humain, des chercheurs comme Steve Wozniak et Nils Nilsson ont proposé des tests concrets qui nécessitent la résolution de problèmes réels et compliqués.

- Le test du café : La machine peut-elle entrer dans un foyer américain moyen et comprendre comment faire un café, notamment en trouvant la machine à café, la tasse et l’eau ?

- Le test IKEA (ou test du robot étudiant): L’IA peut-elle assembler un meuble IKEA à partir d’instructions, ou s’inscrire à l’université et obtenir un diplôme ?

- Le test de l’emploi : Une IA peut-elle effectuer un travail humain avec une telle efficacité qu’elle soit économiquement viable et indiscernable d’un employé humain ?

Ce que ces tests mesurent réellement

Ces tests ont un point commun : ils ne s’intéressent pas aux journaux de discussion, mais plutôt à la capacité d’agir dans le monde réel. Il s’agit de prendre des instructions vagues et de manipuler des objets physiques pour obtenir un résultat spécifique.

Ils testent la généralisation, la planification et l’interaction physique, des compétences qui sont infiniment plus difficiles à imiter que l’écriture d’un poème. Ils obligent l’IA à faire appel à la perception sensorielle et à la motricité, comblant ainsi le fossé entre le code et la réalité.

Le problème d’une ligne d’arrivée unique

Nous avons tendance à considérer l’intelligence comme un interrupteur : elle est soit allumée, soit éteinte. Mais il s’agit en réalité d’un spectre, et il n’y aura probablement pas un seul moment « Aha ! » où nous déclarerons officiellement que l’AGI est arrivée.

L’émergence de l’AGI sera probablement un processus progressif, les systèmes devenant de plus en plus capables d’accomplir des tâches de plus en plus variées. C’est pourquoi se fier à une seule ligne d’arrivée est une erreur.

Le spectre de l’intelligence : Où se situe l’IA d’aujourd’hui ?

Puisqu’il n’existe pas d’interrupteur magique pour l’AGI, comment classer les progrès réalisés ? Des chercheurs ont proposé un cadre pour clarifier la situation.

De l’étroit au général : Un cheminement progressif

Des chercheurs, notamment de Google DeepMind, ont proposé une taxonomie qui abandonne la simple étiquette « intelligent ou stupide ». Au lieu de cela, ils classent les systèmes d’IA sur un spectre de généralité, ce qui nous aide à déterminer exactement où se situe une machine sur l’échelle de l’intelligence.

Ce modèle est une bouffée d’air frais car il nous permet de dépasser l’argument binaire ANI vs AGI. Il offre un aperçu nuancé de la recherche actuelle, reconnaissant que l’intelligence n’est pas noire ou blanche, mais qu’il s’agit d’un gradient.

Niveaux de performance et d’autonomie de l’AGI

Considérez la comparaison suivante comme une confrontation à la réalité. Elle illustre l’écart considérable entre les outils d’IA que nous utilisons quotidiennement et la puissance théorique que représente la véritable IAG.

| Catégorie | IA étroite (ANI) | AGI émergente (par exemple, LLMs avancés) | Véritable IAG (théorique) |

|---|---|---|---|

| Champ d’application | Tâche unique et spécifique (par exemple, jouer aux échecs, identifier des chats). | Tâches multiples dans un domaine (par exemple, écrire, coder, résumer), mais nécessitant une incitation spécifique. | Toute tâche intellectuelle qu’un être humain peut accomplir, dans n’importe quel domaine. |

| Apprentissage | Entraîné sur un ensemble de données spécifique. Il n’est pas possible d’apprendre en dehors de ce champ d’application sans se réentraîner. | Pré-entraîné à partir d’un grand nombre de données. Peut effectuer des tâches à zéro ou à quelques reprises, mais n’apprend pas vraiment de nouvelles compétences de manière autonome. | Apprend en permanence et de manière autonome à partir de son expérience, en transférant ses connaissances d’un domaine à l’autre. |

| Généralisation | Aucun. Les connaissances ne sont pas transférables. | Limité. Peut appliquer des modèles à des problèmes similaires mais échoue sur des concepts fondamentalement nouveaux. | Généralisation profonde. Peut appliquer des principes abstraits appris dans un domaine à un domaine complètement nouveau. |

| Le bon sens | Zéro. Aucune compréhension du monde physique ou social. | Simulé. Peut réciter des faits de bon sens à partir de données, mais manque d’une véritable compréhension. | Inné. Possède un modèle riche et implicite du fonctionnement du monde. |

| L’autonomie | Outil. Son fonctionnement nécessite une commande humaine directe. | Consultant/outil. Peut exécuter des instructions complexes mais manque d’autonomie ou d’initiative. | Agent. Peut se fixer ses propres objectifs et agir de manière autonome pour les atteindre. |

Les LLM sont-ils donc une forme d’AGI ?

Soyons francs : non, les LLM ne sont pas des AGI. D’après le cadre de référence, ils s’inscrivent parfaitement dans la catégorie des AGI « émergentes ». Ils font preuve de compétences dans des domaines spécifiques mais restent incomplets, manquant d’autonomie pour fonctionner sans que nous leur tenions la main.

Voici ce que j’en pense : ce sont des perroquets stochastiques incroyablement sophistiqués. Ils sont passés maîtres dans l’imitation statistique, prédisant le mot suivant avec une précision inquiétante, alors qu’ils ne comprennent pas la moindre chose de ce qu’ils disent. C’est du mimétisme, pas de l’esprit.

Les voies théoriques pour construire l’AGI (sans les plans)

Nous savons exactement à quoi ressemble la destination – une machine dotée d’une cognition de niveau humain. Mais quelle est la carte pour y parvenir ? C’est là que les experts commencent à se disputer. Voici comment les chercheurs tentent de la construire.

L’approche symbolique : Logique descendante

Considérez cette méthode comme celle de l' »IA à l’ancienne ». Elle traite l’intelligence comme un gigantesque organigramme. Les programmeurs codent en dur des règles explicites dans le système, lui apprenant essentiellement à penser en utilisant des énoncés logiques stricts du type « si… alors… » pour représenter le monde. Elle s’appuie sur des symboles que les humains peuvent lire.

Cela fonctionne à merveille pour les échecs ou l’algèbre, des domaines où les règles ne changent jamais. Mais dans le monde réel et désordonné ? Elle s’effondre. Vous ne pouvez pas écrire une règle pour chaque nuance d’une conversation ou d’une scène de rue chaotique. Il est tout simplement trop rigide pour gérer l’ambiguïté.

L’approche connexionniste : L’émergence de bas en haut

C’est le champion des poids lourds à l’heure actuelle. Au lieu de programmer des règles, l’approche connexionniste tente d’imiter la structure physique du cerveau humain à l’aide de réseaux neuronaux artificiels. Elle se concentre sur l’ajustement des connexions entre les neurones pour apprendre à partir des données, construisant ainsi un cerveau numérique.

La véritable intelligence « émerge » de l’interaction de millions de neurones simples qui traitent les informations ensemble, plutôt que de suivre un script. Ce concept est le moteur de l’apprentissage profond moderne, qui permet aux systèmes de repérer des schémas qui nous échappent.

Elle est incroyablement puissante, c’est certain. Mais elle crée une « boîte noire »: nous n’avons souvent aucune idée de la manière dont l’IA est parvenue à ses conclusions.

Autres écoles de pensée

Si vous pensez qu’il s’agit d’un simple choix binaire entre symboles et neurones, détrompez-vous. Les chercheurs explorent d’autres pistes pour percer le code de ce qu’est l’agi.

- Approche hybride : Pourquoi choisir un camp ? Cette méthode tente de combiner les forces de raisonnement structuré de la logique symbolique avec la puissance d’apprentissage des données brutes des méthodes connexionnistes.

- L’architecture du corps entier : Certains affirment que l’intelligence ne se résume pas à un code dans une boîte. Cette théorie suggère que l ‘AGI a besoin d’un corps physique pour interagir avec le monde – unecognition incarnée.

- Approche universaliste: Il s’agit de la recherche d’un algorithme informatique unique, théoriquement parfait, qui résoudrait l’intelligence une fois pour toutes, quelle que soit la tâche spécifique.

Le consensus ? Il n’y a pas de consensus

Voici la vérité toute crue : aucun d’entre eux n’a encore mis au point l’AGI. Il s’agit toujours d’une vaste énigme interdisciplinaire, qui fait appel à l’informatique, aux neurosciences et à la psychologie cognitive. Nous en sommes encore à deviner la solution.

En réalité, personne ne sait quel chemin mène au Saint-Graal. Il s’agira probablement d’un mélange désordonné de tous ces éléments, avec une ou deux découvertes fondamentales que nous n’avons même pas encore imaginées.

Les plus grands obstacles sur la voie de l’AGI

La voie est loin d’être dégagée. Pour vraiment comprendre ce qu’est l’AGI, nous devons nous pencher sur les obstacles colossaux qui subsistent.

Le problème de l’apprentissage par transfert

Nous nous sommes heurtés à un mur avec le problème de l’apprentissage par transfert. Il s’agit sans doute de la bête technique la plus difficile à apprivoiser. Les modèles actuels sont tout simplement incapables d’appliquer les connaissances de manière flexible. Ils se bloquent complètement lorsque le contexte change légèrement.

Le hic, c’est qu’ils apprennent les corrélations statistiques, jamais les relations de cause à effet. Ils devinent le mot suivant en se basant sur les mathématiques, et non sur une compréhension réelle. Il s’agit de mimétisme et non de raisonnement.

Sans cela, une IA reste un outil hyper-spécialisé, quelle que soit sa vitesse. Elle n’est qu’un perroquet doté d’une meilleure mémoire.

Le fantôme dans la machine : Emotion et créativité

Ensuite, il y a le vide de l’intelligence émotionnelle et de la créativité authentique. Les algorithmes peuvent simuler l’art ou imiter la tristesse, bien sûr. Mais il s’agit d’une imitation creuse réalisée à partir de données existantes. Ils ne ressentent rien ; ils se contentent de traiter des modèles.

Cela nous amène à prendre conscience avec humilité de nos créations en silicium.

La véritable créativité et l’intelligence émotionnelle restent le fantôme de la machine, une énigme que les systèmes actuels, malgré toute leur puissance, n’ont pas encore résolue.

Alors, posez-vous la question suivante : une intelligence sans émotions peut-elle vraiment être « générale » ? J’en doute sérieusement.

Perception sensorielle et interaction physique

Nous sous-estimons souvent le poids de la perception sensorielle. La véritable intelligence humaine est façonnée par nos contacts physiques avec le monde: le toucher, le goût, l’odorat. Nous apprenons en faisant, pas seulement en lisant des textes statiques.

Les IA actuelles sont essentiellement des « cerveaux dans un bocal », totalement coupés de la réalité physique. Si la robotique et la vision par ordinateur s’améliorent, elles sont encore loin de la finesse humaine. Elles voient des pixels, pas le monde.

Le problème des données et de l’énergie

Enfin, considérez le cauchemar pratique : les données astronomiques et l’énergie nécessaires pour former ces modèles. C’est scandaleusement inefficace par rapport à un enfant humain. Nous brûlons des forêts pour allumer une seule bougie.

En réalité, l’AGI exige une percée massive vers l’apprentissage efficace des données. Nous avons besoin de systèmes qui apprennent rapidement à partir de quelques exemples. Le calcul brutal ne nous permettra tout simplement pas d’y parvenir.

En fin de compte, l’AGI représente la dernière frontière de l’informatique – une machine qui comprend vraiment. Bien que nous soyons encore loin de cette réalité (et heureusement, à l’abri des robots pour le moment), le voyage est fascinant. N’oubliez pas : si elle vous demande votre formulaire W-2, il s’agit probablement de la mauvaise AGI.