L’essentiel à retenir : l’IA Act établit la première première réglementation mondiale classant l’intelligence artificielle selon quatre niveaux de risque, de l’interdiction pure aux obligations minimales. Ce cadre juridique harmonisé sécurise l’innovation et protège les droits en Europe. Comme le RGPD, il s’applique à toute entité, européenne ou non, opérant sur le marché de l’UE, avec des sanctions dissuasives à la clé.

L’entrée en vigueur de l’ia act vous donne-t-elle des sueurs froides quant à l’avenir de vos projets innovants en Europe ? Rassurez-vous, nous décryptons ce règlement non pas comme un obstacle insurmontable, mais comme le nouveau mode d’emploi pour bâtir une intelligence artificielle éthique et pérenne. Vous découvrirez ici comment jongler avec les niveaux de risques et éviter les lourdes sanctions sans pour autant sacrifier votre agilité technique.

L’IA Act décrypté : les règles du jeu pour l’Europe

Qu’est-ce que l’IA Act, concrètement ?

L’IA Act marque un tournant historique : c’est la toute première législation complète au monde conçue pour encadrer l’intelligence artificielle. Ce règlement de l’Union Européenne impose des règles strictes et claires aux développeurs comme aux utilisateurs.

Oubliez l’idée d’une interdiction massive. Le texte vise plutôt à garantir une utilisation sûre et éthique de la tech. Tout repose sur un mot clé : la confiance.

L’ambition est claire : réitérer le coup de maître du RGPD en 2018 et imposer une norme mondiale.

Les grands objectifs derrière la loi

La priorité absolue reste la sécurité des citoyens. Il faut protéger nos droits fondamentaux et blinder la démocratie contre les dérives possibles de ces technologies puissantes.

L’Europe veut aussi bâtir un marché unique pour des applications « légales, sûres et fiables ». L’idée ? Offrir un cadre juridique stable qui rassure pour enfin stimuler l’investissement et l’innovation sur le vieux continent.

L’objectif n’est pas de freiner l’IA, mais de la guider. Il s’agit de s’assurer que l’humain reste aux commandes et que la technologie sert nos valeurs.

Qui est dans le viseur ? la portée du règlement

La loi frappe large : elle concerne toute entité plaçant un système d’IA sur le marché de l’UE ou dont l’usage impacte des personnes situées chez nous.

Attention à la portée extraterritoriale. Que votre boîte soit basée aux USA ou en Chine, peu importe. Si votre produit IA tourne en Europe, vous devez vous plier à l’IA Act. C’est un point majeur que beaucoup sous-estiment.

Une définition claire du « système d’IA »

Officiellement, c’est un système machine fonctionnant avec une autonomie variable. Il génère des prédictions, des contenus ou des décisions qui influencent directement des environnements réels ou virtuels. Une définition taillée pour le futur.

Ce libellé reste volontairement large pour englober les technologies actuelles et celles à venir. Cela couvre les différents types d’intelligence artificielle qui émergent chaque jour.

L’approche par les risques : une pyramide à 4 niveaux

Le principe : plus le risque est grand, plus les règles sont strictes

L’Europe opte pour le pragmatisme avec une approche fondée sur le risque, refusant de réguler aveuglément. L’objectif est simple : ne pas imposer les mêmes contraintes à tous les algorithmes.

La logique tombe sous le sens : un filtre anti-spam ne porte pas le même préjudice potentiel qu’un logiciel de diagnostic médical erroné. La réglementation s’ajuste donc strictement, de manière proportionnelle, au danger réel pesant sur la santé, la sécurité ou nos droits fondamentaux.

Les quatre catégories de risque en un coup d’œil

Le texte distingue quatre niveaux bien précis : le risque inacceptable, le risque élevé, le risque limité et le risque minimal.

Ce tableau récapitulatif agit comme votre boussole pour ne pas vous perdre. Il permet d’identifier immédiatement la catégorie de votre IA et les obligations qui en découlent, vous évitant ainsi bien des déboires légaux coûteux.

| Niveau de risque | Description | Exemples concrets | Obligation principale |

|---|---|---|---|

| Risque inacceptable | Menace directe pour les droits et la sécurité des personnes | Notation sociale par les gouvernements, manipulation comportementale subliminale, reconnaissance faciale en temps réel (sauf exceptions strictes). | Interdiction totale |

| Risque élevé | Impact significatif sur la sécurité ou les droits fondamentaux | Recrutement (tri de CV), diagnostic médical, octroi de crédit, systèmes de justice et de police. | Conformité stricte (évaluation, documentation, surveillance humaine) avant mise sur le marché. |

| Risque limité | Risque de tromperie ou de manque de transparence pour l’utilisateur | Chatbots, systèmes générant des deepfakes, assistants vocaux. | Obligation de transparence (l’utilisateur doit savoir qu’il interagit avec une IA). |

| Risque minimal | Risque faible ou nul pour les droits ou la sécurité | Filtres anti-spam, jeux vidéo, systèmes de recommandation simples. | Aucune obligation légale (codes de conduite volontaires encouragés). |

Pourquoi cette classification est la pierre angulaire du texte

Cette méthode permet de frapper fort là où c’est vraiment nécessaire. Elle évite de brider l’innovation technique sur des outils inoffensifs par une bureaucratie aveugle et contre-productive.

La proportionnalité reste la clé pour faire accepter la pilule aux industriels du secteur. C’est le compromis vital entre la protection farouche des citoyens européens et le maintien d’une croissance économique dynamique.

Au-delà des risques, une volonté d’harmonisation

Sans ce texte, chaque pays aurait bricolé ses propres lois dans son coin. Pour les entreprises, jongler avec vingt-sept règlements contradictoires aurait été un véritable enfer administratif et financier.

L’IA Act impose désormais un ensemble unique de règles pour tous les États membres. Être conforme à Paris signifie l’être à Berlin, un atout colossal pour fluidifier le marché intérieur.

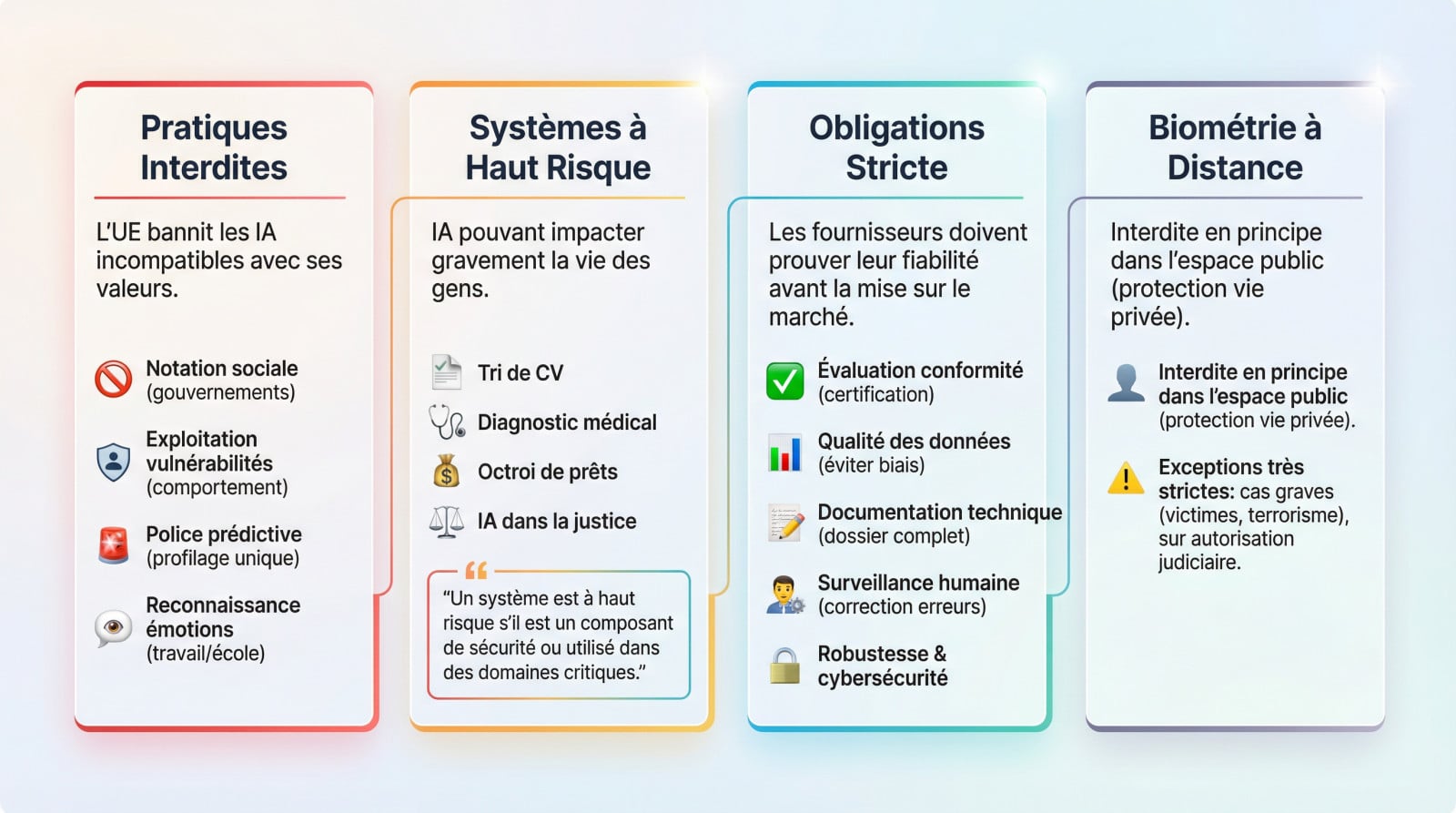

Ligne rouge : les pratiques interdites et les systèmes à haut risque

Après avoir survolé le paysage global, zoomons sur le sommet de la pyramide législative. C’est ici que se cachent les lignes rouges absolues et les contraintes qui font trembler les départements juridiques.

Ce que l’Europe bannit purement et simplement

L’IA Act ne fait pas dans la dentelle sur ce point : certaines applications violent nos valeurs fondamentales. Elles sont donc strictement interdites sur le sol européen. Pas de négociation possible.

Voici la liste noire que tout développeur doit connaître par cœur pour éviter le mur :

- Les systèmes de notation sociale (« social scoring ») par les gouvernements, une pratique observée en Chine.

- L’IA qui manipule les vulnérabilités liées à l’âge ou au handicap pour modifier le comportement.

- Les systèmes de police prédictive qui se basent uniquement sur le profilage d’un individu.

- La reconnaissance d’émotions utilisée sur le lieu de travail ou dans les écoles.

Qu’est-ce qu’un « système à haut risque » ?

On définit les systèmes à haut risque par leur capacité à impacter gravement nos vies. Ce n’est pas la technologie qui pose problème, mais bien son domaine d’application précis.

Pensez aux logiciels de tri de CV, aux outils de diagnostic médical, aux algorithmes de prêts bancaires ou à l’IA dans la justice. L’erreur y est interdite.

Un système est à haut risque s’il constitue un composant de sécurité d’un produit ou s’il est utilisé dans des domaines critiques listés par la loi.

Les obligations lourdes pour les systèmes sensibles

Les fournisseurs n’ont pas le droit à l’erreur et doivent prouver la fiabilité de leur outil avant la mise sur le marché. C’est une barrière à l’entrée massive.

Pour espérer obtenir le feu vert, la liste des devoirs est longue et technique :

- Évaluation de la conformité : Faire certifier le système par les autorités compétentes.

- Qualité des données : Entraîner l’IA sur des jeux de données impeccables pour éviter tout biais.

- Documentation technique : Tenir un registre exhaustif expliquant le fonctionnement interne du système.

- Surveillance humaine : Garantir une supervision humaine capable d’intervenir et de corriger les dérives.

- Robustesse et cybersécurité : Assurer que le système résiste aux attaques et reste fiable.

L’identification biométrique : un cas d’école

L’Europe frappe fort : l’identification biométrique à distance et en temps réel dans l’espace public est interdite par défaut. C’est une victoire majeure pour la protection de la vie privée. Vos visages ne sont pas des données libres. Big Brother ne passera pas.

Pourtant, la porte reste entrouverte via des exceptions très strictes, validées par un juge. On parle ici de recherches de victimes ou de menace terroriste imminente. La sécurité prime parfois.

IA générative et GPAI : un encadrement sur-mesure

On a beaucoup parlé des applications sympas, mais le vrai sujet, c’est le moteur sous le capot. L’IA Act ne l’a pas oublié et consacre un chapitre entier à ces technologies massives qui animent nos outils quotidiens.

Les modèles d’IA à usage général (GPAI) dans le collimateur

Les GPAI (General-Purpose AI models) ne sont pas de simples logiciels, ce sont des monstres de puissance. Ils possèdent une polyvalence rare, capables d’exécuter une immense variété de tâches sans avoir été programmés pour une seule fonction précise.

Vous les connaissez déjà, ce sont les cerveaux derrière ChatGPT ou Midjourney. Des technologies comme Google Gemini entrent pile dans cette catégorie. L’Europe a décidé qu’on ne pouvait plus laisser ces modèles opérer en totale liberté.

Transparence, la nouvelle règle d’or

Fini les boîtes noires impénétrables. La principale obligation qui tombe sur les fournisseurs de GPAI est une transparence radicale, matérialisée par l’exigence d’une documentation technique béton pour prouver leur bonne foi.

Concrètement, voici ce qu’ils doivent désormais mettre sur la table :

- Fournir une documentation technique précise détaillant les capacités réelles et les limites du modèle.

- Mettre à disposition un résumé du contenu utilisé pour l’entraînement, sans rien cacher.

- Mettre en place une politique stricte pour respecter le droit d’auteur européen.

- Apposer un marquage clair sur les contenus générés (texte, image, vidéo) pour signaler qu’ils sont artificiels.

Le respect du droit d’auteur, un point non négociable

C’est souvent là que ça coince. L’IA Act oblige les développeurs de GPAI à prouver qu’ils ont respecté la législation sur le droit d’auteur lors de la collecte massive de leurs données d’entraînement.

Ce n’est pas une simple formalité administrative. Ils doivent être capables de montrer un résumé détaillé des sources protégées qu’ils ont ingérées. Pour les créateurs et éditeurs, c’est une petite révolution qui remet de l’ordre.

Le cas particulier des GPAI à « risque systémique »

Certains modèles sont trop gros pour être ignorés. On parle de risque systémique dès que la puissance de calcul cumulée pour l’entraînement dépasse un seuil critique, menaçant potentiellement la sécurité publique ou les droits fondamentaux.

Pour ces géants, la barre est plus haute. Ils doivent réaliser des évaluations de modèle poussées, gérer activement les risques, signaler le moindre incident grave à la Commission et garantir un niveau de cybersécurité inattaquable.

Gouvernance et calendrier : qui pilote et pour quand ?

Une loi, c’est bien beau sur le papier, mais qui va réellement la faire appliquer et à partir de quand les couperets vont-ils tomber ? C’est le moment de parler concret : la gouvernance et le calendrier de déploiement.

Le « bureau de l’IA » : le nouveau gendarme européen

Vous ne le connaissez peut-être pas encore, mais le Bureau européen de l’IA (AI Office) va vite devenir incontournable. Installée au cœur de la Commission européenne, cette nouvelle structure agit comme le véritable chef d’orchestre de la régulation.

Sa mission est loin d’être symbolique. Ce bureau supervise directement l’application des règles pour les modèles à usage général (GPAI), coordonne les autorités nationales et contribue activement à l’élaboration des normes techniques.

Fournisseurs, déployeurs : qui fait quoi ?

Ne confondez pas les rôles, l’erreur pourrait vous coûter cher. Le fournisseur (provider) est l’architecte : c’est l’entité qui développe le système ou le met sur le marché. C’est donc sur ses épaules que repose la majorité des obligations de conformité.

De l’autre côté, on trouve le déployeur (deployer). Il s’agit de l’entreprise ou de l’administration qui utilise un système d’IA, notamment à haut risque, dans un cadre professionnel. Sa responsabilité ? Garantir une surveillance humaine adéquate et une utilisation conforme aux notices.

Le calendrier d’application : une mise en place progressive

Vous pensez avoir le temps ? Détrompez-vous. Si la loi n’entre pas en vigueur brutalement, son déploiement suit un calendrier échelonné précis. L’objectif est de laisser une fenêtre d’adaptation aux acteurs, mais cette fenêtre se referme vite.

Retenez ces échéances : les premières interdictions tombent dès 2024 et début 2025. Ensuite, les règles strictes pour les GPAI s’appliquent mi-2025. Enfin, le gros du morceau, concernant les systèmes à haut risque, sera pleinement effectif entre 2026 et 2027.

Et les sanctions dans tout ça ?

Bruxelles ne fait pas de la figuration. Le règlement arme les régulateurs de sanctions financières massives pour punir la non-conformité. On parle ici de montants capables de déstabiliser une structure financièrement solide.

La logique rappelle celle du RGPD, mais en plus musclé. Les amendes peuvent grimper jusqu’à 7 % du chiffre d’affaires mondial ou 35 millions d’euros. C’est un levier de dissuasion redoutable que personne ne devrait ignorer.

IA Act et RGPD : le duo gagnant pour la conformité

Pour finir, abordons une question que beaucoup d’entreprises se posent : comment ce nouveau texte s’articule-t-il avec le fameux RGPD ? Spoiler : ils sont faits pour travailler ensemble.

Non, l’IA Act ne remplace pas le RGPD

On entend souvent cette confusion, mais mettons les choses au clair immédiatement : l’IA Act et le RGPD (Règlement Général sur la Protection des Données) sont deux textes complémentaires. L’un ne chasse pas l’autre, c’est un fait.

C’est assez simple en réalité : le RGPD protège les données personnelles des individus, tandis que l’IA Act encadre la sécurité et la fiabilité des produits et services d’IA.

Si un système d’IA traite des données personnelles, il devra respecter les deux règlements. La conformité à l’un n’exonère pas de la conformité à l’autre.

Comment l’IA Act renforce les exigences du RGPD

Vous voyez le lien ? Le travail de documentation exigé par l’IA Act pour les systèmes à haut risque est une aide précieuse pour la conformité RGPD. On ne part pas de zéro.

Concrètement, la documentation sur la qualité des données et les tests de biais peut directement alimenter l’Analyse d’Impact sur la Protection des Données (AIPD), obligatoire sous le RGPD.

Les « bacs à sable réglementaires » pour innover sans risque

Voici une opportunité à ne pas rater. Les bacs à sable réglementaires (sandboxes) sont des environnements contrôlés mis en place par les autorités pour tester sans la peur immédiate de la sanction. C’est une des bonnes idées du texte.

Leur but est clair : permettre aux entreprises, surtout les PME et startups, de tester leurs IA innovantes sous la supervision des autorités, pour s’assurer de leur conformité avant un lancement officiel.

Préparer sa conformité : une double casquette obligatoire

Ne faites pas l’erreur de cloisonner vos équipes. Les entreprises doivent désormais penser leur stratégie de conformité avec cette double vision : protection des données (RGPD) et fiabilité du système (IA Act).

Pour des applications concrètes, cela signifie que la conception de votre prochain chatbot IA conversationnelle devra intégrer ces deux dimensions dès le départ.

L’IA Act marque un tournant décisif : l’Europe ne cherche pas à brider l’innovation, mais à lui offrir un cadre de confiance solide. Pour les entreprises, la conformité devient un véritable avantage compétitif. Alors, prêts à relever le défi ? Mieux vaut anticiper dès maintenant, car vu le montant des amendes, l’addition risque d’être salée

FAQ

C’est quoi exactement, l’AI Act ?

Pour faire simple, c’est la toute première loi complète au monde visant à encadrer l’intelligence artificielle. Porté par l’Union Européenne, ce règlement ne cherche pas à interdire la technologie, mais à fixer des règles du jeu claires. L’idée est de classer les IA selon leur dangerosité : plus le risque pour les citoyens est élevé, plus les contraintes sont fortes. C’est un peu le « code de la route » des algorithmes pour garantir notre sécurité et nos droits.

Quand est-ce que cette loi entre vraiment en vigueur ?

Ce n’est pas un « big bang » immédiat, mais plutôt une mise en place progressive pour laisser le temps à tout le monde de s’adapter. Les pratiques totalement interdites (les lignes rouges) sont bannies dès 2024. Les règles concernant les IA génératives (comme les modèles derrière ChatGPT) arrivent en 2025. Enfin, le gros du morceau concernant les systèmes à haut risque sera pleinement applicable vers 2026 ou 2027.

Quels sont les niveaux de risque définis par l’IA Act ?

L’Europe a choisi une approche pyramidale très pragmatique. On distingue principalement quatre niveaux : le risque inacceptable (systèmes interdits, comme la notation sociale), le risque élevé (strictement encadré, pour la santé ou la justice par exemple), le risque limité (qui demande juste de la transparence, comme pour les chatbots) et enfin le risque minimal (aucune contrainte, pour les filtres anti-spam ou les jeux vidéo).

Qui est à l’origine de l’adoption de l’IA Act ?

C’est une initiative de l’Union Européenne. Le texte a été débattu et adopté par les institutions européennes (Parlement et Conseil) pour s’appliquer uniformément dans les 27 États membres. Petit détail qui a son importance : grâce à sa portée extraterritoriale, peu importe que l’entreprise soit américaine ou chinoise, c’est l’UE qui impose ses règles dès lors que le système est utilisé sur le sol européen.

Qu’entend-on par « déployeur » dans le texte ?

Attention à la nuance ! Le « déployeur » n’est pas celui qui code l’IA (ça, c’est le fournisseur), mais l’entité qui l’utilise dans un cadre professionnel. Si votre entreprise installe un logiciel d’IA pour trier des CV, elle est considérée comme « déployeur ». À ce titre, elle a des responsabilités précises, comme s’assurer qu’un humain garde un œil sur les décisions de la machine.

Que signifie le mot « Act » dans ce contexte ?

C’est tout bête, c’est simplement le terme anglais juridique pour désigner une « loi ». En bon français, on parle de « Règlement sur l’Intelligence Artificielle », mais l’appellation « AI Act » est restée dans le langage courant, même chez nous. C’est plus court et ça sonne un peu plus moderne, il faut l’avouer.

Quelles sont les sanctions si on ne respecte pas les règles ?

L’Europe ne plaisante pas avec la conformité. Comme on l’a vu avec le RGPD, les sanctions sont faites pour être dissuasives. L’AI Act prévoit des amendes administratives très lourdes qui peuvent représenter un pourcentage significatif du chiffre d’affaires mondial de l’entreprise en infraction. Mieux vaut donc prendre le sujet au sérieux dès maintenant.