Lo que hay que recordar: el término «Dark GPT» abarca las IAs sin filtros éticos, que van desde las estafas de marketing hasta las auténticas armas de los ciberdelincuentes, como FraudGPT. Al facilitar la creación de malware y phishing selectivo, estas herramientas democratizan los ciberataques. Comprender claramente estos riesgos es la mejor manera de reforzar la seguridad digital frente a estas amenazas automatizadas.

¿Te da escalofríos el rumor de una gpt oscura capaz de piratear tus datos en cuestión de segundos? Vamos a desentrañar la verdad sobre estas inteligencias artificiales maliciosas, distinguiendo entre las simples estafas de marketing y las verdaderas herramientas utilizadas por los ciberdelincuentes. Quédate con nosotros para averiguar cómo funcionan realmente estos modelos y descubrir las contramedidas esenciales para evitar convertirte en el próximo objetivo de estos algoritmos desenfrenados.

Desmitificando el término GPT Oscuro: ¿de qué estamos hablando realmente?

Más de una definición

La «GPT oscura» no es un producto único, sino un término comodín que a menudo se malinterpreta. En general, se refiere a la IA que opera sin las garantías éticas habituales, lo que crea una enorme confusión.

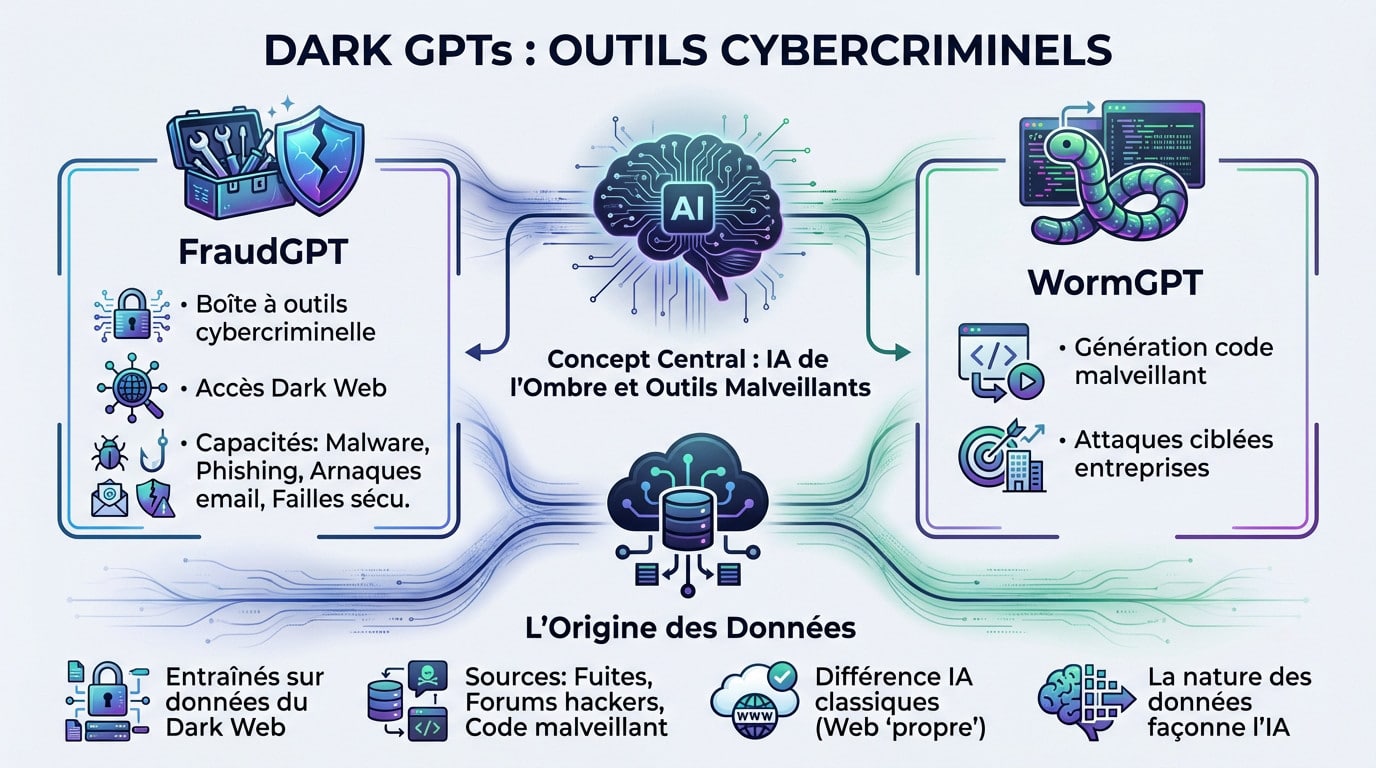

Hay tres familias principales detrás de este nombre. Por un lado, auténticas herramientas de la ciberdelincuencia, como WormGPT. Por otro, versiones «desenfrenadas» de IA de consumo. Y por último, productos comerciales comercializados agresivamente como FraudGPT, que se venden en la web oscura.

Es esencial diferenciarlos para comprender los verdaderos problemas y peligros.

La diferencia con el consumidor ia

Ponlo en contraste directo con ChatGPT o Google Gemini. La distinción fundamental radica en laausencia total de filtros de contenido y restricciones éticas.

Empresas como OpenAI están invirtiendo mucho para restringir su IA y evitar que se descarríe. Las GPT oscuras, por otra parte, están diseñadas precisamente para ignorar o eludir estas barreras, un proceso que a veces se denomina «jailbreaking».

Esta falta de límites es lo que los hace a la vez atractivos para algunos y extremadamente peligrosos.

El verdadero GPT Oscuro: las herramientas de los ciberdelincuentes

¿Crees que la inteligencia artificial se limita a escribir poemas o resumir reuniones? Piénsalo otra vez. Una amenaza mucho más insidiosa está creciendo a la sombra de las redes encriptadas. Las GPT oscuras no son simples anomalías o versiones «desenfrenadas» por adolescentes curiosos; son armas de guerra digital, calibradas para el ataque. A diferencia de los modelos del mercado de masas sujetos a salvaguardas éticas, estas IAs funcionan en modo rueda libre, sin conciencia ni moralidad.

El peligro es real e inmediato. Estas herramientas permiten a cualquier novato lanzar ciberataques terroríficamente sofisticados que antes eran patrimonio de expertos curtidos. Explotan los datos robados para maximizar el daño, convirtiendo la ciberdelincuencia en una industria automatizada basada en suscripciones. Las implicaciones éticas son asombrosas: estamos ante una tecnología capaz de amplificar el caos a escala industrial. Si no tomas la medida de esta evolución, tus sistemas de defensa corren el riesgo de quedarse obsoletos antes incluso de detectar la intrusión.

Ahora que la distinción está más clara, veamos la categoría más preocupante: la IA diseñada específicamente para causar daño.

FraudGPT y WormGPT, las puntas de lanza

FraudGPT se ha establecido como la referencia absoluta de este movimiento clandestino. Se vende exclusivamente en los mercados negros de la web oscura y es un completo conjunto de herramientas para cualquier ciberdelincuente que se precie.

Sus capacidades técnicas son nada menos que aterradoras: escribe malware complejo y genera páginas de phishing indetectables. Diseña estafas por correo electrónico engañosamente realistas mientras escanea activamente tus redes en busca de agujeros de seguridad. Esta es la verdadera cara de la IA maliciosa.

Su gemelo, WormGPT, se centra en generar código malicioso para ataques dirigidos.

El origen de los datos: la web oscura como campo de entrenamiento

El sorprendente poder de estos modelos reside en la propia fuente a partir de la cual se entrenan. Su formidable eficacia se debe a que se entrenan con datos de la web oscura: filtraciones masivas, discusiones en foros de hackers y vastas bases de código malicioso.

Esto dista mucho de las IA tradicionales entrenadas en la literatura o en la Web «limpia» y regulada. Aquí, la naturaleza tóxica de los datos de entrenamiento determina directamente la vocación ofensiva y dañina de la inteligencia artificial final.

Esto es lo que los hace radicalmente diferentes de un simple chatbot de IA conversacional diseñado para la atención al cliente.

GPT Oscuro «falso»: entre el marketing y la elusión

Pero no todas las GPT Oscuras son armas de ciberguerra. Otras son mucho más inofensivas, o incluso una estafa de marketing.

Las promesas de marketing de versiones «ilimitadas

En la web se anuncian productos como «Dark GPT». Es una estratagema de marketing para vender una IA supuestamente «sin censura». Pretenden atraer a quienes están frustrados con los modelos convencionales.

La realidad tras la fachada suele ser muy distinta. Estos servicios tienen una reputación desastrosa. Reseñas muy bajas en Trustpilot señalan problemas recurrentes de facturación y domiciliaciones abusivas. La calidad técnica suele ser mediocre.

Desconfía de estas promesas. Guarda tu dinero.

Jailbreak: obligar a la IA a desobedecer

El Jailbreaking es sencillo. Consiste en utilizar avisos inteligentes. Consigues que una IA estándar como ChatGPT se salte sus propias reglas de seguridad.

Es un juego del gato y el ratón. Los desarrolladores corrigen constantemente estos fallos técnicos.

Para navegar con seguridad, es esencial distinguir entre auténticas herramientas delictivas y simples trucos de elusión o trampas comerciales, como se detalla en esta tabla en la que se comparan los riesgos y objetivos de cada tipo.

| Tipo de GPT Oscuro | Objetivo principal | Acceder a | Riesgo asociado |

|---|---|---|---|

| Malware GPT Oscuro | Ciberdelincuencia (fraude, malware) | Dark web, foros especializados | Alta (ilegal, peligrosa) |

| Comercial GPT Oscuro | Comercial (venta de IA «sin censura») | Sitios web públicos, a menudo de pago | Media (estafas, mal servicio, problemas de facturación) |

| GPT oscuro (Jailbreak/Persona) | Eludiendo filtros legítimos de IA | Mediante avisos específicos en plataformas como ChatGPT | Bajo a medio (violación de las condiciones de uso, generación de contenido inapropiado) |

Riesgos concretos y cómo protegerse contra ellos

A menudo pensamos que la piratería informática es obra de genios encapuchados que teclean líneas verdes de código en un sótano oscuro. Con la aparición de modelos como FraudGPT y WormGPT, la ciberdelincuencia se ha «uberalizado» totalmente. Cualquiera con unos pocos dólares en el bolsillo puede ahora generar ataques aterradoramente sofisticados sin saber nada de código. Ahí es donde radica el problema: se ha roto la barrera técnica. No estamos hablando de escenarios de ciencia ficción, sino de una realidad inmediata en la que tu identidad digital está constantemente en el punto de mira. A estas IA sin filtrar, alimentadas con datos de la web oscura, no les preocupa la ética ni la moralidad. Simplemente lo hacen, y punto. Si crees que estás a salvo porque no eres una multinacional, piénsalo otra vez. Los objetivos somos todos nosotros. Tanto si se trata de una herramienta delictiva como de un simple truco, el fenómeno Dark GPT plantea algunos problemas reales de seguridad. Echemos un vistazo a las amenazas reales y, sobre todo, a cómo no convertirte en víctima.

Amenazas que no hay que subestimar

Olvida la teoría o los escenarios lejanos. Estos peligros no son teóricos, son ya muy reales y están en acción.

- Phishing y fraude de IA: Creación de correos electrónicos y mensajes de estafa ultrapersonalizados y creíbles.

- Desinformación y deepfakes: Generación masiva de noticias, imágenes o vídeos falsos para dañar o manipular la opinión.

- Desarrollo de malware: Asistencia en la creación de virus y otros códigos maliciosos, incluso para hackers inexpertos.

El verdadero problema es la facilidad de acceso. Estas IA reducen drásticamente el nivel de habilidad necesario para lanzar ciberataques sofisticados. Ése es el verdadero cambio.

Algunas precauciones básicas de seguridad

No podemos evitar que existan estas herramientas, eso es un hecho. Lo que podemos hacer, sin embargo, es adoptar una mejor higiene digital para convertirnos en un objetivo mucho más difícil.

- Comprueba siempre la fuente: Sé escéptico ante correos electrónicos, mensajes u ofertas inesperados, aunque parezcan bien escritos.

- Utiliza una seguridad robusta: las contraseñas complejas y únicas y la autenticación de dos factores (2FA) son tus mejores aliados.

- Limita tu huella digital: Cuanta menos información compartas públicamente, menos material tendrán los agentes maliciosos de la IA para atacarte.

Nunca bajes la guardia delante de la pantalla. La vigilancia y el sentido común son tu mejor defensa.

Básicamente, el término GPT Oscuro se refiere tanto a formidables herramientas de pirateo como a simples señuelos de marketing. La IA no es más que un amplificador de intenciones, buenas o malas. Ante esta nueva situación, que no cunda el pánico: tu espíritu crítico y una buena higiene digital son la clave. Mantén los ojos abiertos